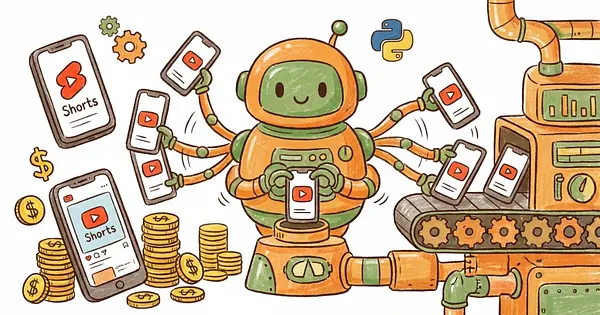

YouTube Shortsの自動生成、気になりませんか?

「Shortsを量産したいけど、1本作るのに3時間もかかる」「外注すると1本5,000円以上で、月に何十本も頼めない」――そんなフラストレーション、めちゃくちゃわかります。

自分もまさにそうでした。

で、先日GitHubを巡回していたら、とんでもないOSSを見つけてしまったんです。

トピックを1行入力するだけで、リサーチから脚本作成、AI映像生成、ナレーション、字幕、BGM、YouTubeへのアップロードまで全部自動。

しかも1本あたりのコストが 約16円。

正直、最初は「嘘でしょ?」と思いました。

でも中身を読めば読むほど、設計がしっかりしていて驚きました。

この記事では、YouTube Shorts自動生成の決定版とも言えるOSS「youtube-shorts-pipeline」の仕組みから使い方まで、徹底的に解説します。

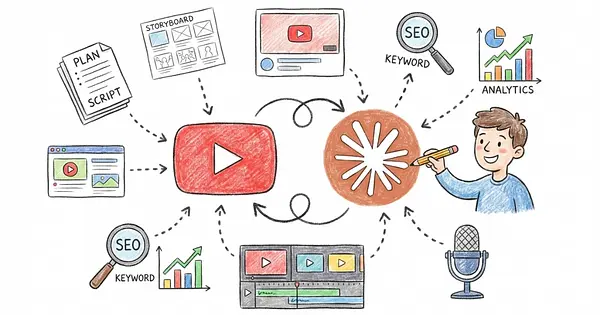

youtube-shorts-pipelineとは何か

1行入力から公開まで、何が自動化されるのか

youtube-shorts-pipeline は、Pythonで書かれたオープンソースのYouTube Shorts全自動生成ツールです。

やることは本当にシンプルで、こんなコマンドを1行打つだけです。

python -m pipeline run --news "Claude Code hits $1B ARR"たったこれだけで、以下のすべてが自動実行されます。

- DuckDuckGoでトピックのリサーチ

- Claude Sonnetで脚本を自動生成

- Gemini Imagenで映像素材(B-roll)を4枚生成

- Ken Burnsエフェクトで映像に動きを追加

- ElevenLabs(またはmacOS音声)でナレーション合成

- Whisperで単語単位のタイムスタンプ付き字幕を生成

- BGMの自動選定と音声ダッキング

- FFmpegで最終動画を合成

- YouTube Data APIで動画・字幕・サムネイルをアップロード

入力から出力まで、人間が手を動かすポイントはゼロです。

つまり、「今日の話題ニュース」を1行打ち込んで席を立てば、コーヒーを飲んで戻ってきたころにはYouTubeに動画がアップされている、という世界観です。

Xでもブックマーク267件を記録していて、注目度の高さがうかがえます。

誰が作ったOSSで、どう使うのか

開発者はDr. Rushindra Sinha氏(Global Esports CEO)。

GitHubリポジトリには78のテストケースが含まれており、個人の趣味プロジェクトとは思えない本格的な設計になっています。

ライセンスはOSSとして公開されているため、誰でも無料でクローンして使えます。

必要なのはPython環境と、いくつかのAPIキーだけ。

セットアップ手順は後半で詳しく解説しますので、まずは「どうやって1本16円が実現できているのか」、その仕組みを見ていきましょう。

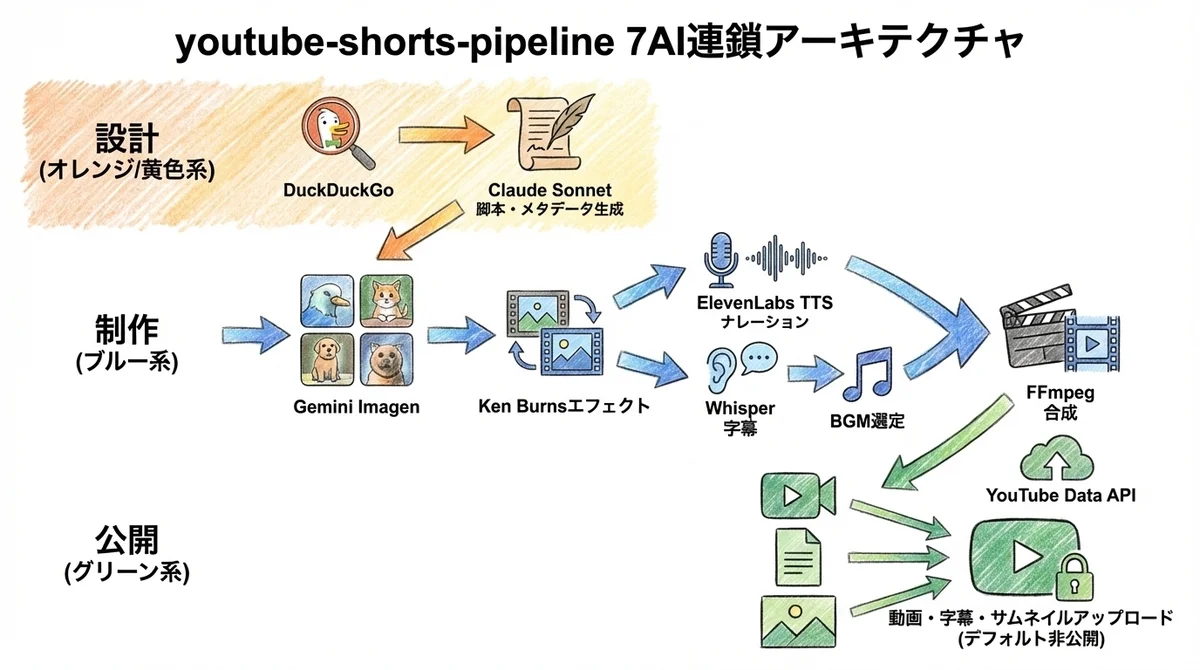

7AI連鎖アーキテクチャの全貌

ここが個人的に一番アツいポイントです。

このAI動画自動生成の仕組みは、3つのステージに分かれた7つのAI・ツールの連鎖で構成されています。

全体の流れを一言で言うと「DuckDuckGo → Claude → Gemini Imagen → ElevenLabs → Whisper → FFmpeg → YouTube Data API」です。

「え、そんなにいろんなAIが動いてるの?」と思いますよね。

順番に見ていきましょう。

Stage 1(Draft): リサーチ → 脚本 → メタデータ

最初のステージでは、動画の「設計図」を作ります。

- DuckDuckGoでライブ検索: 入力されたトピックについて、最新の検索結果を取得します。

ここが非常に重要なポイントで、Claudeの学習データではなく「今この瞬間の検索結果」だけを使います。

- Claude Sonnetで脚本生成: 検索結果だけを参照して、60〜90秒のショート動画用脚本を生成します。

同時にB-roll(映像素材)のプロンプト、動画のメタデータ(タイトル・説明文・タグ)、サムネイルの記述も出力されます。

つまりStage 1の出力は、動画制作に必要な「全指示書」です。

Claudeがいわばディレクターとして、後続の全工程に指示を出すイメージです。

Stage 2(Produce): 映像 → 音声 → 字幕 → BGM → 合成

ここが一番ボリュームのあるステージです。

- Gemini Imagenで映像素材を生成: B-rollプロンプトをもとに4枚の画像を生成します。

- Ken Burnsエフェクトの適用: 静止画にズーム・パンの動きを加えて、映像として成立させます。

- ElevenLabs TTSでナレーション合成: 脚本をもとに、自然な音声ナレーションを生成します。

macOSを使っている場合はシステム音声でも代用可能で、その場合はElevenLabsの費用(約7円)が不要になります。

- Whisperで字幕生成: ナレーション音声から、単語単位のタイムスタンプ付き字幕を自動生成します。

フォーマットはASS形式で、動画にバーンイン(焼き付け)されます。

- BGM自動選定 + 音声ダッキング: BGMを自動で選び、ナレーションが聞こえやすいように自動で音量調整(ダッキング)します。

- FFmpegで最終合成: 映像、ナレーション、字幕、BGMをすべて合わせて、1本の動画ファイルを生成します。

Stage 3(Upload): YouTube自動アップロード

最後のステージでは、YouTube Data APIを使って以下をまとめてアップロードします。

- 動画ファイル

- 字幕ファイル

- サムネイル画像

デフォルトは非公開(private)アップロードです。

いきなり公開されるわけではないので、まず内容を確認してから公開するかどうかを判断できます。

この設計、地味ですが安心感があってすごく好きです。

3ステージの仕組みがわかったところで、次は「このツールが普通のAI動画ツールと根本的に違う理由」を解説します。

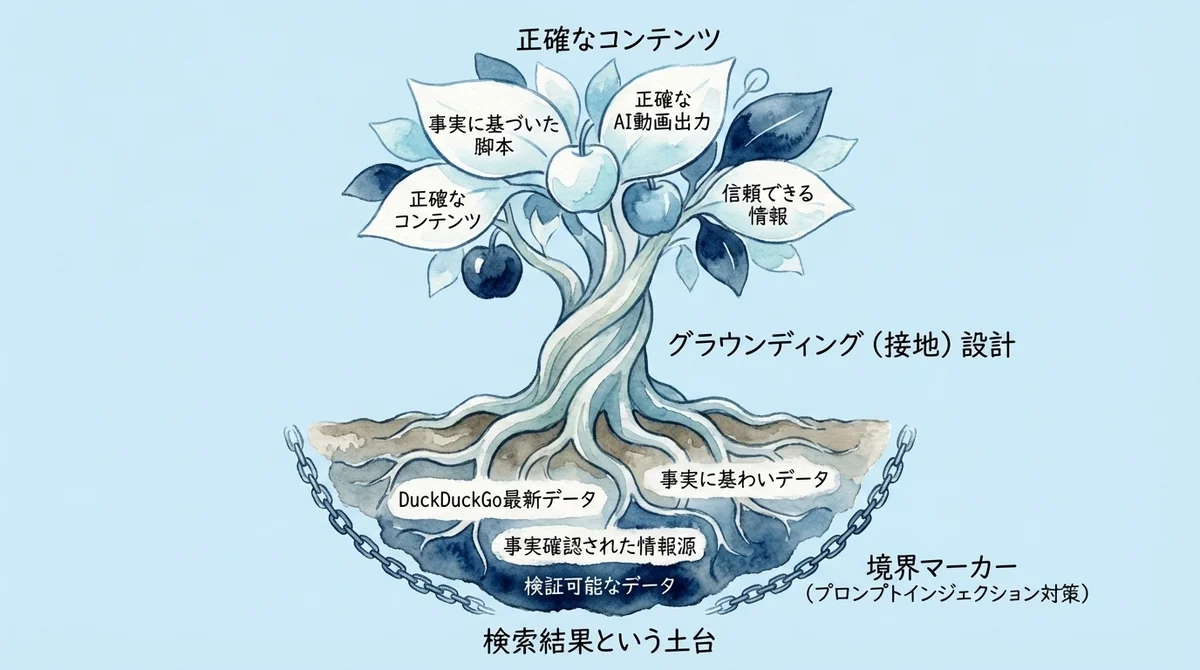

反ハルシネーション設計:なぜ事実誤りが起きにくいのか

AI動画の自動生成で一番怖いのは「嘘の情報を含む動画が量産される」ことですよね。

ハルシネーション対策としてこのツールが採用しているアプローチは、かなり本格的です。

DuckDuckGoグラウンディングとは何か

通常、LLMに「〇〇について脚本を書いて」と指示すると、学習データに含まれる古い情報や、存在しない事実を混ぜ込んでしまうリスクがあります。

youtube-shorts-pipelineでは、まずDuckDuckGoで最新の検索結果を取得し、その検索結果だけをClaudeに渡す設計になっています。

Claudeは自分の学習データを参照せず、渡された検索結果の範囲内でのみ脚本を書きます。

これを「グラウンディング(接地)」と呼びます。

AIの出力を、検証可能な情報源に「接地」させることで、事実誤りの発生を設計レベルで抑えているわけです。

Claudeへの制約付きプロンプト設計

さらに、検索結果をClaudeに渡す際には境界マーカーで囲むというテクニックが使われています。

これはプロンプトインジェクション対策です。

検索結果の中に悪意あるプロンプトが紛れ込んでいた場合でも、Claudeがそれを「指示」として解釈しないように設計されています。

正直、ここまで考えて設計されたOSSツールはなかなかありません。

「全自動=品質が低い」というイメージを覆す、非常に丁寧なエンジニアリングだと思います。

さて、設計の凄さがわかったところで、次はみなさんが一番気になっているであろう「お金の話」です。

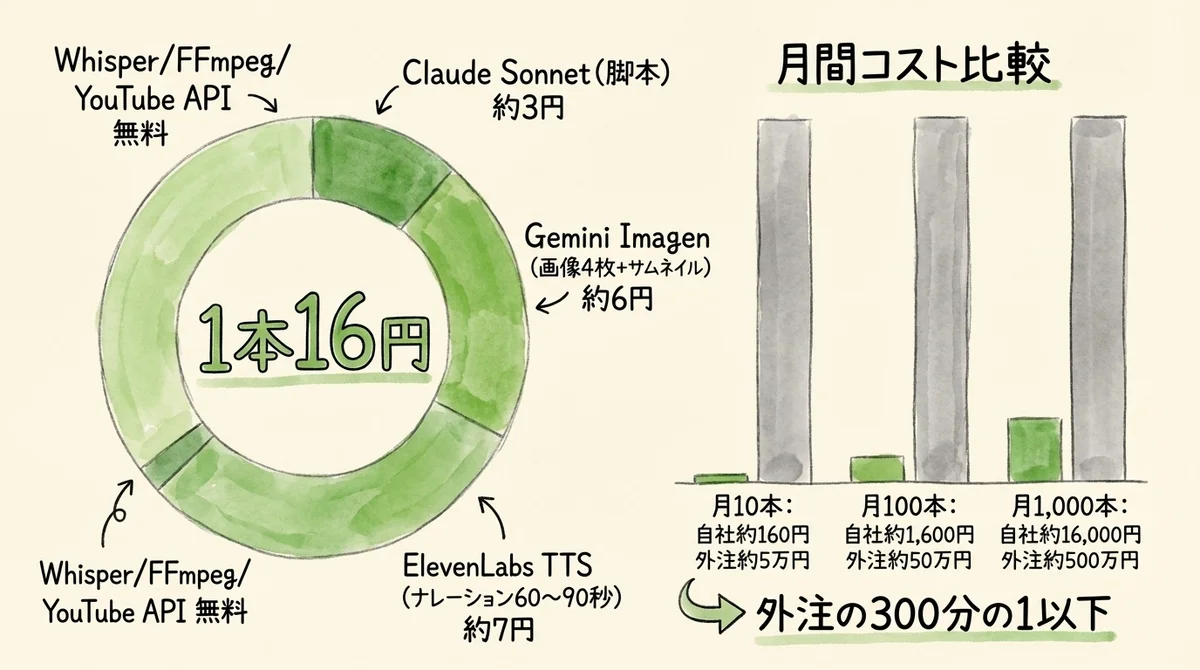

コスト構造を徹底解説(1本16円の内訳)

API別コスト内訳

1本のYouTube Shortsを生成するのにかかるコストの内訳はこちらです。

macOSのシステム音声を使えば、ElevenLabsが不要になるため約$0.09(約9円)まで下がります。

月100本・月1,000本でのコストシミュレーション

月1,000本作っても16,000円。

外注なら500万円かかるところが、300分の1以下です。

もちろん品質は人間が作ったものとまったく同じとは言えませんが、「量産してテストする」というYouTube Shortsの戦略には非常にフィットするコスト構造です。

商用ツール(2short.ai・Klap・ShortGPT)との比較表

注目してほしいのは、youtube-shorts-pipelineだけがリサーチからアップロードまで全工程をカバーしている点です。

他のツールは「脚本から動画まで」や「既存動画の切り出し」など、一部の工程に限定されています。

「コストは最安、カバー範囲は最広」というのがこのツールの強みです。

では次に、「でも本番で使って大丈夫?」という疑問に答えていきます。

技術的な強度:プロダクション品質の根拠

「OSSだから不安定では?」と思う方もいるかもしれません。

でもこのツール、プロダクション運用を明確に意識した設計になっています。

78テストが示す安定性

リポジトリには78のテストケースが含まれています。

個人開発のOSSでここまでテストが書かれているのは珍しく、コードの品質に対する開発者のこだわりが伝わってきます。

ステートマシンによる中断再開設計

3つのステージ(Draft → Produce → Upload)は、ステートマシンで進捗が管理されています。

つまり、Stage 2の途中でエラーが発生しても、最初からやり直す必要はありません。

# Stage 1だけ実行

python -m pipeline draft --news "トピック"

# Stage 2を個別実行(途中から再開も可能)

python -m pipeline produce --draft ~/.youtube-shorts-pipeline/drafts/<id>.json

# Stage 3だけ実行

python -m pipeline upload --draft <パス>このステージ分割設計のおかげで、API障害やネットワークエラーが起きても安心です。

指数バックオフによる耐障害性

すべてのAPI呼び出しに指数バックオフリトライが実装されています。

一時的なAPIエラーで処理が止まることなく、自動的にリトライしてくれます。

さらに、APIキーはファイルパーミッション0600(所有者のみ読み書き可能)で保護されるなど、セキュリティ面にも気が配られています。

「個人開発にしては本気すぎる」というのが正直な感想です。

ここまで読んで「よし、使ってみよう」と思った方に、さらに嬉しいニュースがあります。

トレンドトピック自動発見機能

ここからがさらに面白いところです。

「トピックを1行入力する」と説明してきましたが、実はそのトピック選定すら自動化できます。

Reddit・RSS・Google Trends・X・TikTokからの収集

youtube-shorts-pipelineには、以下の5つのソースからトレンドトピックを自動収集する機能が搭載されています。

- RSSフィード

- Google Trends

- Twitter / X

- TikTok

# トレンドトピック一覧を表示

python -m pipeline topics --limit 20これで「今何が話題になっているか」を一覧で確認できます。

cronやGitHub Actionsで完全無人運用

さらに --discover --auto-pick オプションを使えば、トレンドトピックの中から自動でテーマを選び、動画生成からアップロードまで全自動で実行できます。

# トレンドから自動選択 → 生成 → アップロード

python -m pipeline run --discover --auto-pickこれをcronジョブやGitHub Actionsに登録すれば、文字通り完全無人でYouTubeチャンネルを運用できます。

月1,000本のYouTube Shortsを16,000円で、しかも完全放置で回す。

そんなことが技術的に可能になっているわけです。

「やってみたい!」という気持ちが高まってきたところで、実際のセットアップ手順に移りましょう。

セットアップ手順(クイックスタート)

ここからは実際にyoutube-shorts-pipelineをインストールして使うまでの手順を解説します。

必要なAPIキー3つと事前準備

事前に以下のAPIキーを取得しておきましょう。

- Anthropic API Key(Claude Sonnet用): Anthropic Console から取得

- Google Gemini API Key(Imagen用): Google AI Studio から取得

- ElevenLabs API Key(TTS用・任意): ElevenLabs から取得

ElevenLabsは任意です。

macOSを使っている場合はシステム音声で代用できるため、なくても動きます。

YouTubeへのアップロードを使う場合は、YouTube Data APIのOAuth認証も必要です。

インストールから最初の動画生成まで

# リポジトリをクローン

git clone https://github.com/rushindrasinha/youtube-shorts-pipeline.git

cd youtube-shorts-pipeline

# 依存関係をインストール

pip install -r requirements.txt

# APIキーを環境変数にセット

export ANTHROPIC_API_KEY="sk-ant-..."

export GEMINI_API_KEY="..."

export ELEVENLABS_API_KEY="..." # 任意

# YouTube OAuth設定(アップロード機能を使う場合)

python scripts/setup_youtube_oauth.py準備ができたら、まずはドライランで試してみましょう。

# ドライラン(Stage 1のドラフト生成のみ実行。映像制作・アップロードはスキップ)

python -m pipeline run --news "AI agents in 2026" --dry-run--dry-run は脚本・メタデータ・B-rollプロンプトの生成(Stage 1)だけを実行します。

映像制作(Stage 2)もアップロード(Stage 3)もスキップされるため、APIコストを最小限に抑えてまず脚本の品質を確認できます。

脚本の内容に問題がなければ --dry-run を外してフル実行すれば、映像生成からYouTubeへの非公開アップロードまで自動で完了します。

YouTube収益化ポリシーとの整合性

「で、これで作った動画って収益化できるの?」

一番気になるポイントですよね。

「量産型コンテンツ」規制との関係

YouTubeは「大量に自動生成されたコンテンツ」に対して厳しい姿勢を示しています。

特に、内容が薄い動画を大量にアップロードするチャンネルは収益化が停止されるリスクがあります。

このツールで作った動画は収益化できるのか?

結論から言うと、ツールの使い方次第です。

youtube-shorts-pipelineには、収益化を考える上で有利な特徴がいくつかあります。

- 反ハルシネーション設計: 事実に基づいたコンテンツが生成されるため、「でたらめな動画の量産」にはなりにくい

- 非公開アップロードがデフォルト: 人間が内容を確認してから公開するワークフローが自然に組み込まれている

- 脚本の品質がClaude Sonnet依存: 現時点でトップクラスのLLMが脚本を書くため、内容の品質は比較的高い

ただし、以下の点は注意が必要です。

- 完全無人で月1,000本アップロードすれば、YouTubeのアルゴリズムにスパム判定されるリスクがある

- AI生成コンテンツであることの申告が求められる場合がある

- 収益化の最終判断はYouTube側の審査に委ねられる

おすすめの使い方は、全自動で生成した動画を人間がチェックし、質の高いものだけを公開するというハイブリッド運用です。

「16円で下書きを量産し、人間がキュレーションする」というスタイルなら、品質と量の両立が可能です。

収益化を目指すなら、完全自動よりもこのハイブリッド運用がおすすめです。

まとめ:どんな人にとって価値があるか

youtube-shorts-pipelineは、YouTube Shortsの自動生成を「設計レベルで真面目に」解決したOSSです。

改めて、このツールが特に価値を発揮するのは以下のような方です。

- YouTube Shortsを量産してチャンネルを育てたい個人クリエイター: 1本16円で大量の「下書き」を生成し、良いものだけ公開する戦略が取れます

- Python / API活用に慣れたエンジニア: OSSなのでカスタマイズ自由。脚本生成プロンプトを自分好みに調整したり、映像生成部分を差し替えたりできます

- 動画マーケティングのコストを下げたい事業者: 外注1本5,000円が16円に。テスト用の動画を大量に作って、反応の良いテーマだけに注力できます

7つのAIとツールが連鎖する設計、反ハルシネーションの思想、78テストのプロダクション品質。

個人開発のOSSとは思えない完成度です。

「まず試してみたい」という方は、APIキーを1つだけ(AnthropicだけでOK)用意して、ドライランから始めてみてください。

python -m pipeline run --news "好きなトピック" --dry-run脚本が生成されるまで数十秒。

「え、こんなクオリティの脚本がこれだけで?」と驚くはずです。

そこから先は、APIキーを追加していくだけで、映像→音声→アップロードと機能が広がっていきます。

💬 コメント

ログイン か 会員登録 するとコメントできます