AIへの指示、「たくさん書けばいい」と思っていませんか?

最近、X(旧Twitter)であるツイートが話題になっていました。

AIツールの設定について、こんな趣旨の投稿です。

これ、エンジニア向けの開発ツールについての話なんですが、読んでみたらChatGPTやCopilotを使っている人にも参考になる話だったんです。

「AIに詳しく指示すればするほど、いい結果が返ってくる」

こう思っている方、けっこう多いんじゃないでしょうか。私もそう思っていた時期がありました。

でも、実はこれ、半分正解で半分不正解なんです。

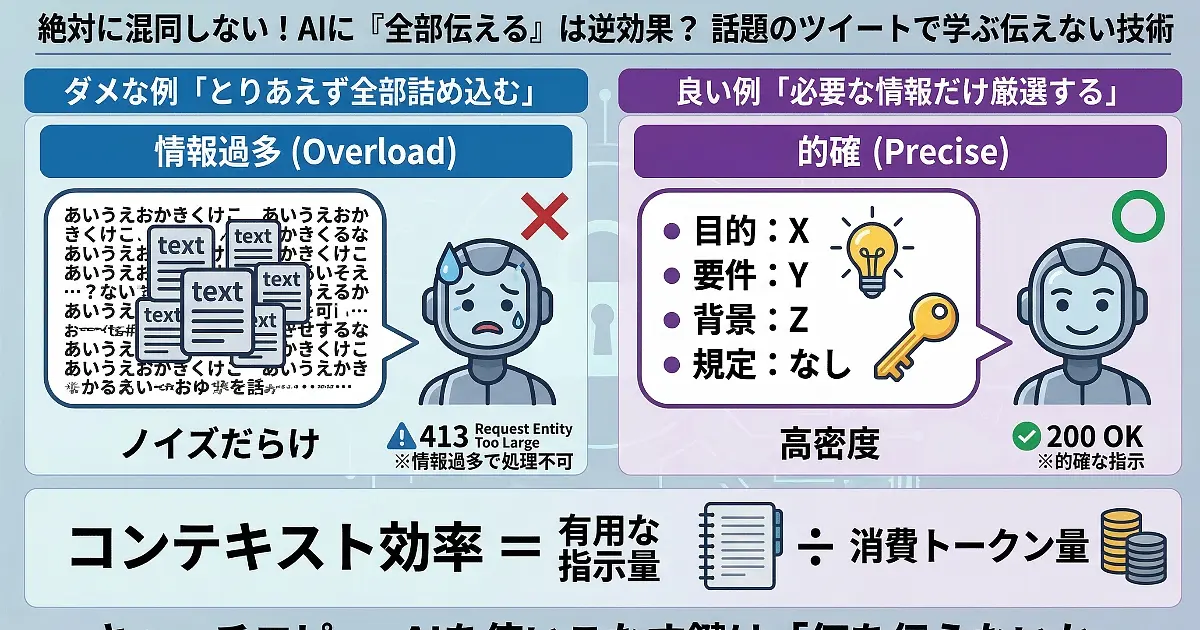

大事なのは「情報を減らせ」ではなく、「不要な情報を減らして、本当に必要な情報の密度を上げよう」ということ。AIに追加情報を与えて精度が上がるケースはたくさんあります。問題は「とりあえず全部詰め込む」というやり方なんです。

話題のツイートを「非エンジニア語」に翻訳してみる

元のツイートは、Anthropic社(ChatGPTの競合であるClaudeを作っている会社)の開発者向けツールの設定についてのものでした。

要点をざっくり翻訳すると、こうなります。

ポイント1: 「コンテキスト効率」を意識せよ

AIには「コンテキストウィンドウ」という、一度に読める情報量の上限があります。これはChatGPTでもClaudeでも同じです。

この上限の中で、いかに無駄な情報を減らして、本当に必要な情報だけを伝えるか。それが「コンテキスト効率」という考え方です。

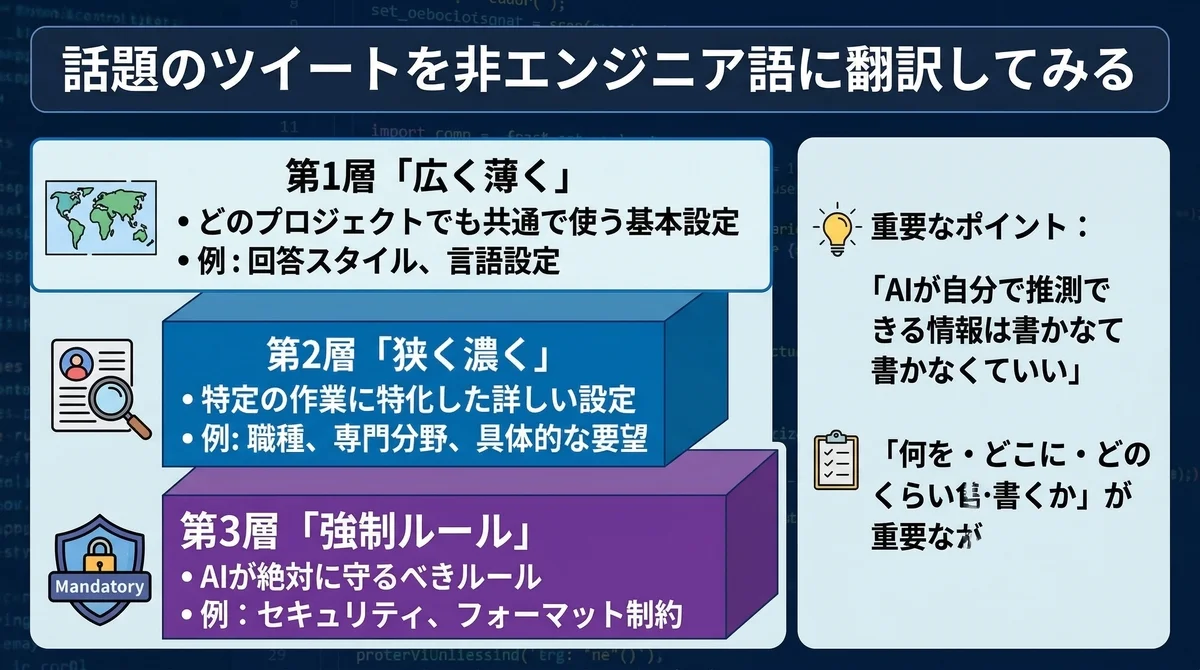

ポイント2: 設定には「役割分担」がある

元のツイートでは、設定を3つの層に分けて管理することを推奨していました。

- 広く薄く: どのプロジェクトでも共通で使う基本設定

- 狭く濃く: 特定の作業に特化した詳しい設定

- 強制ルール: AIが絶対に守るべきルール

この考え方の本質は、ChatGPTの「カスタム指示」にも共通しています。全部を1つの設定にゴチャゴチャ書くのではなく、何を・どこに・どのくらい書くかを意識するだけで、結果が変わるんです。

ポイント3: AIが自分で読み取れる情報は書かなくていい

Anthropicの公式ドキュメントには、こう書かれています。

「Claudeがコードを読むことで理解できるものは除外してください」

つまり、AIが文脈から推測できることをわざわざ指示に書くのは、限られた情報枠のムダ遣いだということです。

このツイートの内容は、思いつきやポエムではありません。

Anthropicの公式ドキュメントには、はっきりとこう書かれています。

「あなたのコンテキストウィンドウは、管理すべき最も重要なリソースです」

さらに、設定ファイルは簡潔に保つことが推奨されていて、膨れ上がった設定は「指示が無視される原因になる」とまで書かれています。

これはChatGPTにも通じる話です。「カスタム指示」の欄にあれもこれもと詰め込んでいる方、いませんか?

実は、ある研究(AI応答に対する文脈の影響を調べた実験)では、会話履歴やコンテキストを必要な情報だけに絞った場合のほうが、大量の情報をそのまま渡した場合よりも回答品質が高かったという結果が出ています。情報量にして数百倍の差があるケースでも、「量より質」のほうが勝ったんです。

短く、的確に。これがAI時代の「伝える技術」の核心です。

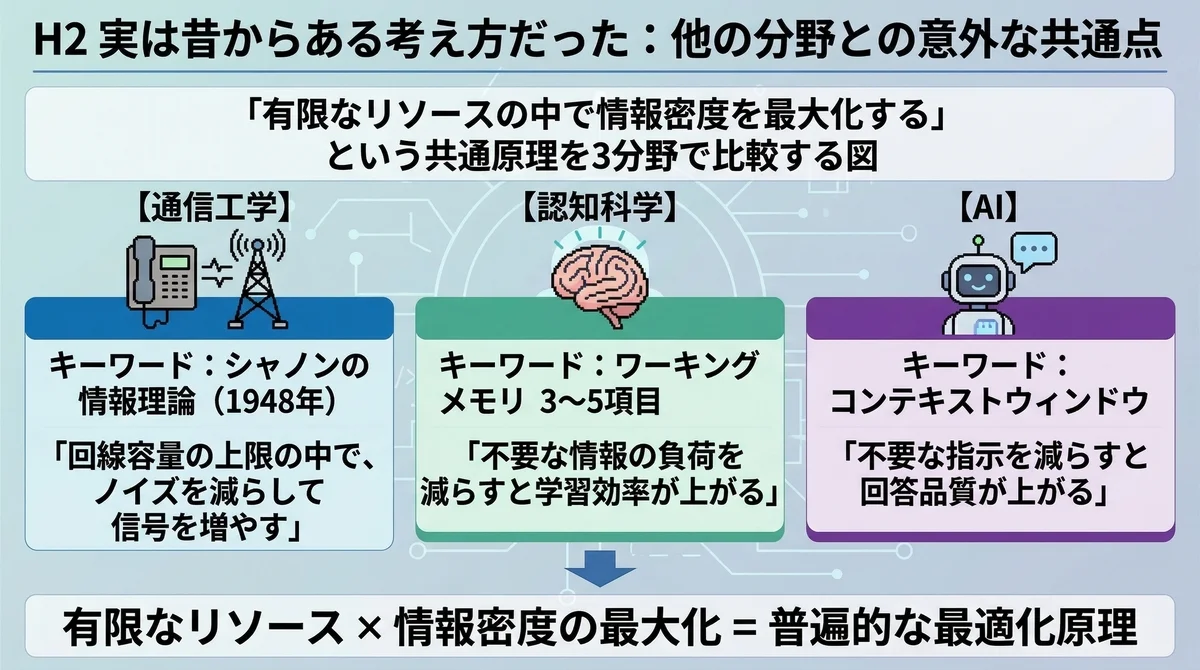

実は昔からある考え方だった: 他の分野との意外な共通点

「有限なリソースの中で、情報の密度を最大化する」

実はこの考え方、AI特有のものではありません。昔からいろんな分野で研究されてきた、普遍的な考え方なんです。

通信工学: 「回線容量」とAIの意外な共通点

1948年にクロード・シャノンという数学者が、情報理論という分野を切り開きました。

ざっくり言うと、「電話線やネット回線には容量の上限がある。その中でいかに多くの情報を正確に送るかが勝負」という理論です。

AIのコンテキストウィンドウにも、この「回線容量」と似ている部分があります。上限がある以上、ノイズ(不要な情報)を減らして信号(本当に伝えたいこと)を増やすのが合理的、という発想ですね。

認知科学: 人間の脳にも「容量制限」がある

人間の脳の「ワーキングメモリ」(一度に処理できる情報量)は、わずか3〜5項目と言われています。

会議で10個の議題を一気に出されても頭に入らないですよね。でも3つに絞れば集中できる。

AIにも似たような現象があります。仕組みは人間の脳とは違うのですが、結果として指示が多すぎると「どれを優先すればいいかわからない」状態になるんです。認知科学では、不要な情報による負荷を「外在的認知負荷」と呼びます。この負荷を減らすことが、人間の学習でもAIの回答品質でも、効果を上げるポイントだとされています。

共通する本質: 「ムダを減らすと、本質が伝わる」

通信工学でも認知科学でも、結局たどり着くのは同じ結論です。

「有限なリソースの中で、いかに情報密度を上げるか」

コードでもドキュメントでも、本質的な情報と余計な情報の比率が高いほど品質が良い。AIへの指示も、この原則がそのまま当てはまるんです。

2025年以降の流れ: 「プロンプトエンジニアリング」から「コンテキストエンジニアリング」へ

AIの使い方のトレンドも、まさにこの方向に進んでいます。

2025年、AI業界で「コンテキストエンジニアリング」という概念が注目を集めました。Shopifyのトビアス・リュトケ(Tobi Lutke)CEOやAI研究者のアンドレイ・カルパシー(Andrej Karpathy)が言及し、Anthropicもブログで詳しく解説しています。

これまでは「プロンプトエンジニアリング」、つまり「AIへの質問文をいかに上手に書くか」が注目されていました。

でも今は、それだけでは足りなくなっています。AIに渡す情報全体(前提条件、設定、過去のやりとり、参考資料)をどう設計するか。この全体設計こそが、AIの性能を引き出す鍵だという考え方です。

もう1つの大きな流れが「マルチエージェント」です。1つのAIにすべてを任せるのではなく、複数のAIエージェントがそれぞれ専門分野を担当する。各エージェントが自分の仕事に必要な情報だけを持つことで、コンテキスト効率が自然と最適化される仕組みです。

さらに面白いのが、JetBrains(開発ツールの大手企業)が発表した研究です。AI関連の学術会議で発表されたこの研究によると、AIエージェントの作業過程で生まれる不要な出力を単純に非表示にするだけで、高コストなAI要約と同等の効果が得られたそうです。

つまり、「足す」よりも「引く」ほうが効果的だった、ということです。

ChatGPTユーザーのあなたが今すぐできること

「エンジニア向けのツールの話でしょ?」と思った方、ちょっと待ってください。

ChatGPTには「カスタム指示」という機能があります。ここに自分の情報や希望する回答スタイルを設定できるのですが、これも会話のたびにコンテキストウィンドウを消費する仕組みになっています(技術的な仕組み上、設定内容が毎回の会話に含まれるためです)。

Copilotにも同様の設定がありますし、Geminiにも類似の機能があります。

つまり、どのAIツールを使っていても、この「コンテキスト効率」の考え方は共通しているんです。

ChatGPTのカスタム指示は1つの入力欄あたり最大1,500文字(2つの欄があるので合計3,000文字)。この限られた文字数の中で「何を優先するか」が重要です。

カスタム指示のBefore / After 例

Before(よくある詰め込みパターン):

私は30代の会社員です。マーケティング部門で働いています。AIに詳しくないので丁寧に教えてください。あなたはAIアシスタントです。常に丁寧で正確な回答を心がけてください。回答は日本語でお願いします。長すぎず短すぎない回答をしてください。必要に応じて箇条書きを使ってください。わからないことはわからないと言ってください。

After(優先度を絞ったパターン):

マーケティング担当。専門用語は避け、具体例つきで説明してほしい。回答は箇条書き+要約で構成。

Afterのポイント:

- 「AIアシスタントです」「日本語で」→ AIが既に知っている情報なので不要

- 「丁寧に」「正確に」→ デフォルト動作なので書かなくても同じ

- 「30代の会社員」などの属性情報 → 回答に影響するなら残してOK。ここでは「マーケティング担当」に集約

- 職種と回答形式の希望だけに絞ったことで、1,500文字の「枠」に余裕ができる

見直しのポイントをまとめると、こうなります。

- AIが推測できることは書かない: 「あなたはAIアシスタントです」「日本語で回答して」のような自明なことは不要

- 毎回使う情報だけを設定に入れる: たまにしか使わない情報はその都度伝える

- 具体的で短い指示にする: 「わかりやすく書いて」より「中学生が理解できる表現で」のほうが効果的

- 定期的に見直す: 使っているうちに不要になった設定は削除する

まとめ: AIを使いこなす鍵は「何を伝えないか」

今回のツイートが教えてくれたこと。それは、AIへの指示は「とりあえず全部」ではなく「必要な情報を厳選する」のが大事だということです。

- AIのコンテキストウィンドウには上限がある

- その上限の中で、情報密度を最大化するのが合理的

- これは通信工学でも認知科学でも、昔から知られている考え方と共通している

- 「プロンプトエンジニアリング」から「コンテキストエンジニアリング」へ、業界全体が進化している

AIツールは日々進化していますが、「有限なリソースをどう使うか」という根本的な課題は変わりません。

AIに「何を伝えるか」を考えるのと同じくらい、「何を伝えないか」を考えてみてください。

それだけで、AIの回答品質がグッと変わるはずです

💬 コメント

ログイン か 会員登録 するとコメントできます