ChatGPTでPRDの壁打ちをしていて、最初は的確な回答が返ってきていたのに、会話が50往復を超えたあたりから急に的外れな提案が増えた――そんな経験、ありませんか。

「あれ、さっき合意したターゲットユーザーの定義、変わってない?」って二度見する瞬間。

あの地味にストレスたまる現象、実は偶然でもAIの気分でもなく、「context rot(文脈腐敗)」という技術的に説明できるメカニズムが原因なんです。

そしてここが大事なんですが、このcontext rot、コンテキストウィンドウが1Mトークンになっても解決しません。

この記事では、AIチャットのコンテキスト管理不足で会話品質が劣化するメカニズムと、その原因・対策を徹底解説します。

今すぐ実践できる7つのコンテキスト管理テクニック、そしてコピペで使える引き継ぎテンプレートまで、2026年の最新情報をもとに紹介します。

AIチャットが途中から「使えなくなる」現象の正体――品質低下の原因と対策

context rot(文脈腐敗)って知ってますか?

「context rot」は、2025年にベクトルDB開発のChromaがテクニカルレポートとして発表し、注目を集めた概念です。

日本語にすると「文脈腐敗」。

コンテキストウィンドウに情報が蓄積されるにつれて、LLM(大規模言語モデル)の応答品質が段階的に劣化していく現象を指します。

具体的には、こんな症状が出ます。

- 会話の前半で伝えた前提条件を無視し始める

- 同じ質問をしたのに、以前と矛盾する回答が返ってくる

- 回答が抽象的になり、具体性が失われる

- 指示したフォーマットを守らなくなる

- 「さっき言いましたよね?」と突っ込みたくなる場面が増える

PMの仕事でいえば、PRDの要件定義を相談しているうちに、序盤で合意した「ターゲットユーザー」の定義がすり替わっている、みたいな状況ですね。

「あるある」と思った方、安心してください。

これ、AIが「忘れている」わけではないんです。

技術的にはもっと厄介な話で、ここを理解すると対策の打ち方がガラッと変わります。

コンテキストウィンドウの仕組みをざっくり理解する

コンテキストウィンドウを一言で説明すると、「AIが一度に見渡せる情報の範囲」です。

イメージとしては、会議室のホワイトボードを想像してください。

ホワイトボードの面積には限りがあります。

書き込みが増えるにつれて、文字は小さくなり、古い情報は隅に追いやられ、全体を俯瞰して判断するのが難しくなっていく。

AIのコンテキストウィンドウもこれと同じです。

200Kトークンや1Mトークンといった公称値は「ホワイトボードの面積」にあたりますが、面積が広ければ書き込みが整理されるわけではありません。

ここがミソなんですが、多くのモデルでは公称コンテキストの60〜70%程度が実用的な上限とされており、それを超えると応答品質が不安定になりやすいとされています。

つまり、200Kトークンを謳うモデルでも、130Kトークンあたりで応答が怪しくなることが珍しくないんです。

「え、3割も使えないの?」って思いますよね。

そうなんです。

だからこそ「管理」が必要になるわけですが、その前に「じゃあウィンドウを広げればいいんじゃない?」という疑問に答えておきます。

「広いコンテキスト=安心」ではない理由

「じゃあ1Mトークンのモデルを使えば解決するのでは?」と思うかもしれません。

結論から言うと、解決しません。

コンテキストウィンドウが広がっても、context rotの根本原因は変わらないからです。

LLMのAttentionメカニズム(どの情報に注目するかを決める仕組み)は、情報量が増えるほど1つ1つの情報への注目度が分散します。

いわば、100ページの議事録を一気に渡されたPMみたいなものです。

全ページ均等に覚えているのは無理ですよね。

AIも同じで、量が増えれば増えるほど、古い情報や文脈の重みが相対的に薄れていくんです。

つまり、コンテキストウィンドウの大きさに頼るのではなく、「中に入れる情報をどう設計するか」が本質的な解決策になります。

では、2026年の主要モデルは実際どれくらいのコンテキストを持っているのか、現状を確認してみましょう。

2026年の主要AIモデル、コンテキストウィンドウ比較

まず、2026年3月時点の主要モデルのスペックを整理しておきます。

数字だけ見ると「1Mトークンもあれば十分でしょ」と思いますよね。

でも、先ほど説明したとおり、数字の大きさと品質維持は別の話なんです。

各モデルの実力と限界を見ていきましょう。

GPT-5(400K〜1Mトークン)の実力と限界

GPT-5.4は1Mトークンという巨大なコンテキストウィンドウを持っています。

書籍にして約3〜4冊分の情報を一度に処理できる計算です。

ただし、実際に1Mトークンをフルに使い切るユースケースでは、後半の応答品質が明らかに落ちるという報告が多く上がっています。

特にPMの業務で多い「長い議論のログを全部渡して分析させる」ような使い方では、序盤のコンテキストが薄まりやすい傾向があります。

「全部入るから全部渡そう」は、実は逆効果になりがちなんですよね。

PMの業務でいえば、ブレスト用途なら向いていますが、精度が求められるPRD作成では早めに新チャットへ切り替えることを意識したほうが安全です。

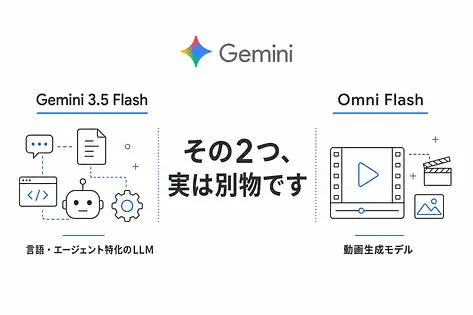

Claude(200K〜1M)の特徴

Claudeは標準200Kトークンですが、最新のOpus 4.6/Sonnet 4.6では1Mトークンも一般提供されています。

ここが面白いところなんですが、Anthropicはcontext rotへの対策にかなり力を入れていて、「コンテキスト圧縮(compaction)」という仕組みをAPIやClaude Codeに実装しています。

つまり、ウィンドウを広げるだけでなく「ウィンドウの中身を整理する」方向にも投資しているんです。

また、2026年3月に全ユーザーへメモリ機能が開放されたことで、コンテキストウィンドウだけに頼らない文脈管理が可能になりました。

コンテキストウィンドウが拡大した一方で、200Kの範囲内で効率よく使うほうが品質は安定しやすい、というのが正直な実感です。

PMの業務でいえば、「何を記憶させるか」をコントロールしたい仕様書作成や要件定義の壁打ちに特に向いています。

Gemini(1Mトークン)の実用性

Gemini 2.5 Proは1Mトークンをネイティブでサポートしています。

マルチモーダル対応で、テキスト以外に画像や動画もコンテキストに含められるのが強みです。

ただし、1Mトークンの大半をマルチモーダルデータで消費すると、テキスト部分の文脈維持は当然弱くなります。

PMの業務でいえば、画面モックやユーザーインタビュー動画を一緒に渡して分析させるような「テキスト+ビジュアル」のユースケースで力を発揮するモデルです。

どのモデルを使っても、「コンテキストウィンドウが大きい=品質が維持される」ではないことがお分かりいただけたと思います。

大事なのは、コンテキストをどう管理するか。

ここからがいよいよ本題です。

今すぐ使えるコンテキスト管理7つのテクニック

正直、ここからの内容が一番伝えたかったパートです。

PM業務で実際に使っている7つのテクニックを、優先度の高い順に紹介します。

「これ全部やらなきゃダメ?」と思うかもしれませんが、最初の2つだけでも劇的に変わるので、まずはそこから試してみてください。

1.「60%ルール」で新チャットに切り替える

最もシンプルで効果が大きいのが、この「60%ルール」です。

コンテキストウィンドウの60%を使い切ったら、そこで新しいチャットに切り替える。

「え、それだけ?」って思いますよね。

それだけなんです。

でもこれを意識するだけで、応答品質の劣化を体感レベルで防げます。

正確な使用量は分からなくても、目安として「会話が30〜40往復を超えたら切り替え時」と覚えておけば十分です。

ChatGPTの場合、会話が長くなると右上に「この会話は長くなっています」的な警告が出ることがあります。

それが出たらもう遅い、くらいの感覚で先手を打つのがコツですね。

「でも、途中で切り替えたら文脈が失われるのでは?」

その問題を解決するのが、次のテクニックです。

2.「要約」ではなく「構造化引き継ぎ」で渡す

新チャットに切り替えるとき、よくやりがちなのが「ここまでの会話を要約して」というプロンプトです。

これ、実はかなり情報が落ちます。

要約は「何が重要か」をAI側が判断するため、あなたにとって重要な文脈が省略されることが多いんです。

代わりに使うべきなのが「構造化引き継ぎ」です。

具体的には、以下の項目を明示的に整理して新チャットに渡します。

- 目的: このチャットで達成したいゴール

- 背景・前提: 共有すべきコンテキスト

- ここまでの決定事項: 合意済みのポイント

- 未解決事項: まだ結論が出ていないこと

- 次のアクション: 新チャットで最初にやること

PMの仕事に例えると、これはまさに「議事録」のフォーマットなんですよね。

会議の引き継ぎと同じで、構造化された情報は文脈の損失が最小限になります。

このテクニック、知ってるだけで会話の引き継ぎ精度が全然違ってきます。

テンプレートは後のセクションで紹介するので、コピペして使ってください。

3. コンテキスト圧縮(compaction)を使う

「コンテキスト圧縮(compaction)」は、AnthropicがClaude APIやClaude Codeに実装している機能です。

会話の内容を要約して、新しいコンテキストとして再スタートする仕組みです。

これが嬉しいのは、さっき「要約はダメ」と言いましたが、compactionはAIが文脈保持に最適化した圧縮をしてくれるので、手動の要約とは精度が段違いなんです。

Claude APIやClaude Codeではコンテキストが上限に近づくと自動的にcompactionが行われるため、長い会話でも文脈が整理されます。

開発者向けのClaude Codeでは/compactコマンドとして明示的に実行することもできます。

ChatGPTでも、プロンプトで「この会話の重要なポイントを構造化してまとめてください。次の会話の冒頭に貼り付けて使います」と指示すれば、似たことができます。

ポイントは、「要約」ではなく「次の会話で使うための構造化データ」として出力させることです。

用途が明確なほど、AIの出力品質も上がります。

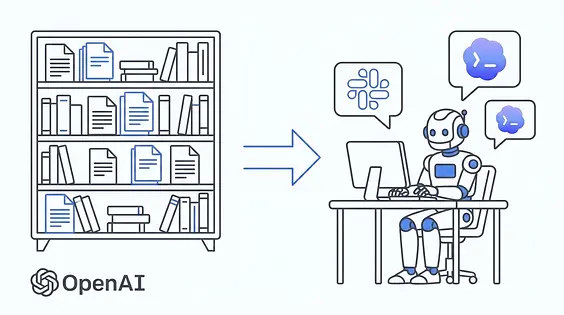

4. ChatGPTのプロジェクト機能でコンテキストを永続化する

ChatGPTのプロジェクト機能は、コンテキスト管理の強い味方です。

トピックごとにワークスペースを作成でき、プロジェクト内のメモリは他のプロジェクトに影響しません。

PRDの作成、競合分析、ユーザーインタビュー分析など、PMの業務テーマごとにプロジェクトを分けておくと、文脈の混在を防げます。

いわば、プロジェクトごとに専用の会議室を持つようなイメージです。

隣の会議の話が混入してこないから、議論の質が保たれる。

さらに、プロジェクトにはファイルをアップロードできるので、関連資料をナレッジベースとして常に参照させることも可能です。

2025年に無料ユーザーにも開放されているので、使わない手はないですね。

5. Claudeのメモリ&プロジェクト機能を活用する

Claudeは2026年3月に、メモリ機能を全ユーザーに開放しました。

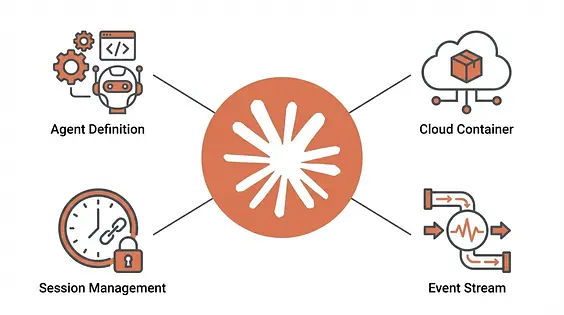

ここで注目してほしいのが、Claudeのメモリは3層構造になっている点です。

- Chat Memory(チャットメモリ): 全チャット共通で記憶される情報(あなたの役割、好みなど)

- Project Memory: 特定のプロジェクト内でのみ有効な記憶

- Conversation Context: 現在の会話のコンテキスト

「常に共有したい前提」と「このプロジェクト固有の文脈」と「今の会話の流れ」を分離できるんです。

これ、PMの情報管理に例えると、「社内Wiki」「プロジェクトのConfluence」「今日の議事録」みたいな階層化と同じですよね。

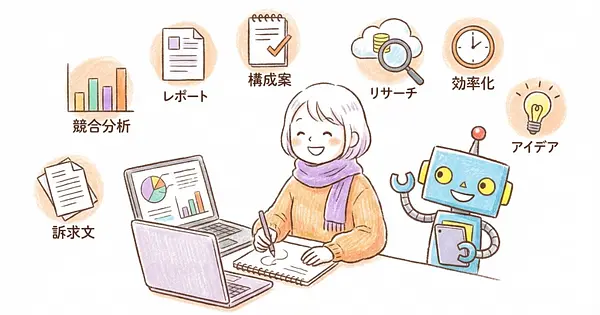

PMの業務でいえば、Chat Memoryに「自分はtoB SaaSのPMで、アジャイル開発を採用している」と記憶させておけば、毎回説明する必要がなくなります。

さらに、ChatGPTからのメモリインポート機能も追加されているので、ChatGPTで蓄積した文脈をClaudeに移行することもできます。

6. カスタム指示で前提を外部化する

これは地味ですが、効果がめちゃくちゃ大きいテクニックです。

ChatGPTの「Custom Instructions」や、Claudeの「Project Instructions」に、常に共有したい前提情報を書いておきます。

例えば、PMであれば以下のような内容です。

あなたはtoB SaaS プロダクトのPM業務を支援するアシスタントです。

前提条件:

- 開発手法: アジャイル(2週間スプリント)

- チーム構成: PM1名、エンジニア5名、デザイナー1名

- 重視する指標: NPS、チャーンレート、MRR

- 対象ユーザー: 従業員100〜500名の中堅企業の情報システム部門

回答時のルール:

- フレームワーク(RICE、ICE等)を使って優先順位を示す

- ユーザーストーリー形式で要件を整理する

- 根拠のない推測は避け、「情報不足」と明示する何が嬉しいかというと、この情報は会話のコンテキストを消費しないんです。

つまり、コンテキストウィンドウの節約と品質維持を同時に実現できる。

毎回「私はPMで〜」と自己紹介する手間も省けるので、コスパの良さでいえば7つの中でもトップクラスですね。

7. 会話の「設計」を先にやる

最後のテクニックは、テクニックというよりマインドセットに近い話です。

AIとのチャットを始める前に、3つだけ決めておいてください。

- この会話のゴール: 何を達成したら終わりか

- 必要な情報: AIに何を渡すべきか

- 終了条件: どうなったら新チャットに切り替えるか

これ、PMなら普段やっていることですよね。

スプリントプランニングで「このスプリントのゴール」「必要なインプット」「完了条件」を定義するのと同じです。

目的が明確な会話は無関係な情報が混入しにくく、context rotを遅らせる効果が期待できます。

ダラダラと用途を変えながら同じチャットを続けるのが、一番context rotを加速させるパターンです。

それ、AIに壁打ちした? ではなく、「壁打ちの設計をした?」が正しい問いかもしれません。

さて、ここまで7つのテクニックを紹介しましたが、「構造化引き継ぎって具体的にどう書けばいいの?」と思った方も多いはずです。

コピペOK!構造化引き継ぎプロンプトテンプレート集

ここからは、実際にコピペして使えるテンプレートを3種類紹介します。

難しいことは何もありません。

新チャットに切り替えるタイミングで、現在のチャットにこのプロンプトを貼り付けて実行する。

出力された内容を、新しいチャットの最初のメッセージとして貼り付ける。

たったこれだけです。

30秒の手間で、会話の引き継ぎ精度が劇的に変わります。

汎用テンプレート(どんな作業にも使える)

迷ったらまずこれを使ってください。

以下のフォーマットで、この会話の引き継ぎ情報を整理してください。

新しいチャットの冒頭に貼り付けて使います。

---

## 会話の引き継ぎ情報

### 1. 目的

(この会話で達成しようとしていたゴールを1〜2文で)

### 2. 背景と前提

(共有すべき前提条件を箇条書きで)

### 3. これまでの経緯

(議論の流れを時系列で簡潔に)

### 4. 決定事項

(合意に至ったポイントを箇条書きで)

### 5. 未解決事項

(まだ結論が出ていない論点を箇条書きで)

### 6. 次のアクション

(新しいチャットで最初に取り組むべきことを明記)

---

注意: 抽象的な要約ではなく、新しいチャットで作業を再開できる

レベルの具体性で書いてください。ビフォーアフターで実感してください。

引き継ぎなしで新チャットを開くと、「えっ、そのターゲットユーザーの定義、もう話しましたよね?」とゼロから説明し直す羽目になります。

構造化引き継ぎを貼り付けると、最初のメッセージから前回の決定事項を踏まえた回答が返ってきます。

「続きをやってる感」がある、その体験の違いは大きいですよ。

PRD・企画作業向けテンプレート

PRDや仕様書の壁打ちをしているなら、こちらのほうがフィットします。

以下のフォーマットで、この企画作業の引き継ぎ情報を整理してください。

新しいチャットの冒頭に貼り付けて使います。

---

## 企画作業の引き継ぎ情報

### 1. プロダクト/機能の概要

(何を作ろうとしているのかを1〜3文で)

### 2. ターゲットユーザー

(ペルソナまたはユーザーセグメントの定義)

### 3. ユーザーストーリーと受入基準

(確定済みのストーリーと基準を列挙)

### 4. 技術的な制約・前提

(開発チームとの合意事項、技術スタック等)

### 5. KPI・成功指標

(この機能で追う数値目標)

### 6. ステークホルダー合意事項

(誰と何を合意したか)

### 7. 未決定事項と論点

(まだ議論が必要なポイント)

### 8. 次のステップ

(新しいチャットで進めるべき作業)

---

注意: 意思決定の根拠も含めてください。

「なぜその結論に至ったか」が分からないと引き継ぎの意味がありません。リサーチ・調査作業向けテンプレート

競合調査やユーザーリサーチの途中で切り替える場合はこちらです。

以下のフォーマットで、この調査作業の引き継ぎ情報を整理してください。

新しいチャットの冒頭に貼り付けて使います。

---

## 調査作業の引き継ぎ情報

### 1. 調査の目的

(何を明らかにしようとしているのか)

### 2. 調査済みソースと要点

(確認した情報源と、そこから得られた重要な知見)

### 3. 主要な発見事項

(ここまでの調査で分かったことを箇条書きで)

### 4. 未調査領域

(まだカバーできていない範囲)

### 5. 暫定結論

(現時点での仮説や結論)

### 6. 信頼度の評価

(各発見事項の確度: 高/中/低)

### 7. 次に調べるべきこと

(新しいチャットで優先的に調査すべきポイント)

---

注意: 情報源のURLや参照先がある場合は必ず含めてください。3つのテンプレート、用途に合わせて使い分けてみてください。

「テンプレートを使うのすら面倒」という方は、汎用テンプレートだけブックマークしておけばOKです。

ChatGPT vs Claude:コンテキスト管理機能の比較【2026年最新】

ここまでテクニックとテンプレートを紹介してきましたが、「結局ChatGPTとClaudeのどっちがコンテキスト管理に強いの?」という疑問もあると思います。

2026年3月時点の機能を比較してみましょう。

メモリ機能の違い

ChatGPTは「勝手に覚えてくれる」のが便利な反面、意図しない情報が記憶されることもあります。

Claudeは明示的な管理が前提なので、PMのように「何を記憶させるか」をコントロールしたい人に向いています。

ここ、PMの方には結構重要なポイントだと思ってて、「勝手に覚えられる」のと「自分で管理する」のでは、情報の信頼性が全く違うんですよね。

プロジェクト機能の違い

機能的にはほぼ横並びですが、Claudeはチーム利用での共有機能が充実しています。

複数人でプロジェクトの文脈を共有したい場合はClaudeのほうが使いやすい印象です。

PMの仕事別おすすめ使い分け

ただし、これは2026年3月時点の話です。

両方のモデルとも進化が速いので、半年後には状況が変わっている可能性もあります。

大事なのはツールの優劣ではなく、コンテキスト管理の「考え方」を身につけることですね。

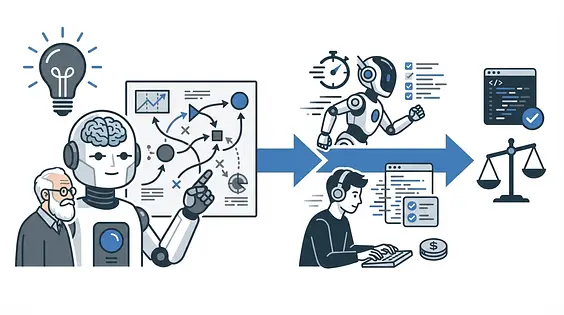

まとめ:コンテキスト管理はAI活用の「設計力」

この記事で伝えたかったのは、AIチャットの品質維持は「良いモデルを選ぶ」ことではなく「コンテキストを設計する」ことで実現できるということです。

改めて、7つのテクニックを振り返ります。

- 60%ルール: コンテキストの60%で新チャットに切り替える

- 構造化引き継ぎ: 要約ではなく、構造化されたフォーマットで渡す

- コンテキスト圧縮: Anthropicのcompaction機能を活用する

- ChatGPTプロジェクト機能: トピック別のワークスペースで文脈を分離する

- Claudeメモリ&プロジェクト: 3層構造のメモリで前提を永続化する

- カスタム指示の外部化: Custom InstructionsやProject Instructionsに前提を記述する

- 会話の設計: ゴール・必要情報・終了条件を事前に定義する

PMの仕事の本質が「意思決定」であるように、AI活用の本質は「コンテキストの設計」だと思っています。

どのAIを使うかより、AIにどんな情報を、どんな構造で、どのタイミングで渡すか。

この「設計力」を磨くことが、AI活用のレベルを一段上げる鍵です。

まずは明日のPRD壁打ちで「60%ルール」を使ってみてください。

引き継ぎテンプレートを貼った瞬間、AIが前回の決定事項を踏まえた回答を最初から返してくる体験は、ちょっと感動しますよ。

💬 コメント

ログイン か 会員登録 するとコメントできます