はじめまして、もるふぉ@コードをかかないAIエンジニアです。

エンジニアをやりながら、今はほぼコードを書かない開発スタイルに移行しました。

「書けないから書かない」じゃなくて、「書けるから書かなくていい」という話です。

実案件ベースで気づいたことだけ書いています。

GitHub Copilot、今も使ってますか?

2026年4月24日以降、Free/Pro/Pro+プランのユーザーがCopilotに送ったプロンプトやコードが、AIモデルの学習データとして使われます。

デフォルトON、つまり何もしなければ自動的に有効になります。

この記事では、変更の正確な内容、オプトアウトの具体的な手順、そしてCursor・Cline・Claude Code・Tabnineとのデータポリシー比較をまとめています。

「自分には関係ない」と思った方こそ、一度設定画面を確認してみてください。

何が変わったのか — 2026年3月25日の発表内容

2026年3月25日、GitHubは公式ブログでCopilotのインタラクションデータ利用ポリシーの変更を発表しました。

施行日は2026年4月24日です。

ひとことで言えば、「Copilotとのやりとりを、AIモデルの改善に使わせてもらいます」という内容です。

これまでGitHubは、CopilotのインタラクションデータをサードパーティのAIモデルトレーニングに使用しないことを基本方針としていました。

それが今回、個人向けプランに限って方針転換されたわけです。

学習に使われるデータの範囲

具体的に何が収集されるのか、整理しておきます。

正直、自分も改めて読んで「これだけ広いのか」と思いましたね。

- ユーザーが承諾・修正したコード出力(Copilotの提案を受け入れた/編集したコード)

- Copilotに送信されたインプット(コードスニペット含む)

- カーソル位置周辺のコードコンテキスト

- コメントおよびドキュメンテーション

- ファイル名、リポジトリ構造、ナビゲーションパターン

- Copilotとのチャット、インライン提案、コードレビューのインタラクション

- 提案に対するフィードバック(サムズアップ/ダウン)

これ、結構な範囲ですよね。

コードの中身だけでなく、ファイル名やリポジトリの構造まで含まれています。

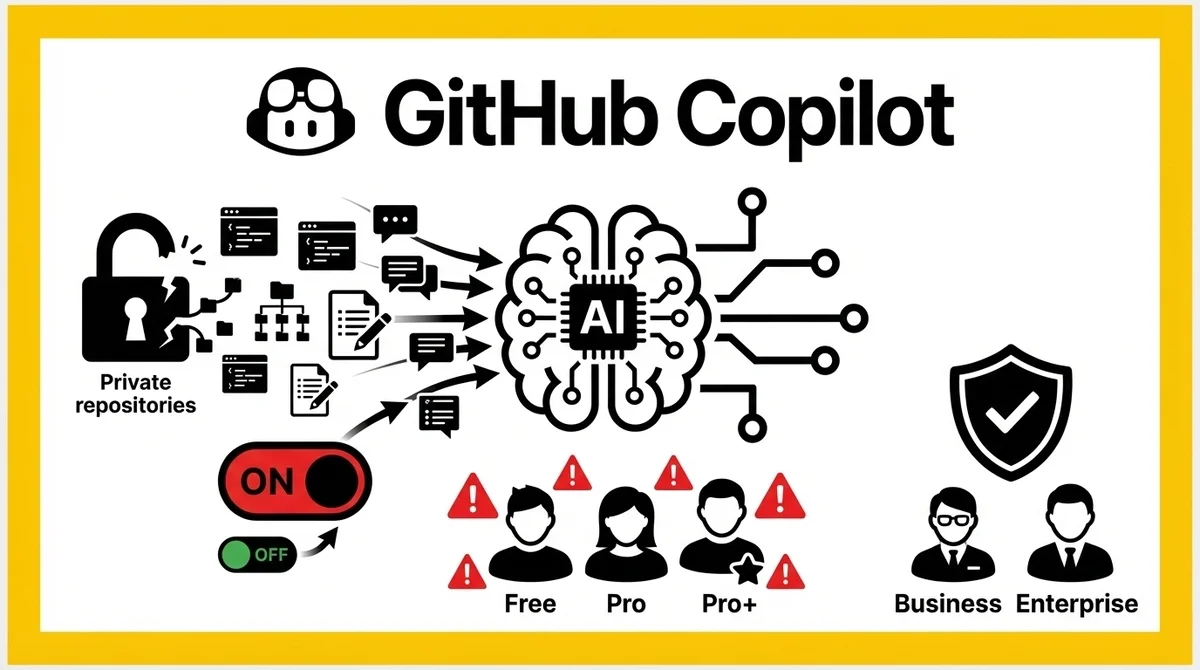

ここで重要なのは、プライベートリポジトリの「保存されたコンテンツ(at rest)」自体は対象外だという点です。

ただし、Copilotをアクティブに使用しているセッション中のプロンプト・提案・コンテキストは、オプトアウトしない限り収集対象になります。

つまり、プライベートリポジトリだから安心というわけではないんですよね。

Copilotを開いてコードを書いている間に送信されるデータは、すべて対象になり得ます。

GitHubはAPIキーやパスワードは自動フィルタリングで除去されると主張していますが、これがどこまで完璧に機能するかは未知数です。

また、GitHubの公式FAQでは「収集されたデータはMicrosoftを含むアフィリエイト企業と共有される可能性がある」と明記されている点も、頭に入れておく必要があります。

対象プランと対象外プラン(Free/Pro/Pro+ vs Business/Enterprise)

影響を受けるプランを明確にしておきます。

Business/Enterpriseが対象外なのは、法人契約にはデータ保護に関する明確な契約条件があるからです。

逆に言えば、個人ユーザーにはそうした保護が適用されないということです。

なぜ「デフォルトON」なのか — GitHubの意図

GitHub CPOのMario Rodriguez氏は、Microsoft社員のインタラクションデータでCopilotの改善が確認されたことを正当化の根拠として挙げています。

「データが増えればモデルが良くなる、良くなれば全ユーザーに恩恵がある」という論理です。

技術的にはその通りなんですよ。

ただ、ここで問題になるのは「同意の取り方」です。

オプトインではなくオプトアウト方式、つまり「知らなければ自動的にデータが使われる」という設計に対して、コミュニティからは強い批判が集まっています。

この批判の中身については、後半で詳しく取り上げます。

【所要2分】GitHub Copilotのオプトアウト手順

難しい操作は一切ありません。

設定自体はすぐ終わります。

手順1: 設定ページを開く

以下のURLにアクセスします。

https://github.com/settings/copilotGitHubにログインした状態でアクセスしてください。

手順2: Privacy設定を変更する

ページ内の「Privacy」セクションを探します。

直接URLで開く場合はこちらです。

https://github.com/settings/copilot/features「Allow GitHub to use my data for AI model training」という項目を見つけて、Disabled に変更します。

手順3: 変更が保存されたか確認する

設定を変更したら、ページをリロードして設定が「Disabled」のまま保持されていることを確認してください。

これで完了です。

注意: 以前オプトアウト済みの場合も再確認

GitHubの公式見解では、以前にオプトアウトした設定は保持されるとしています。

ただし、GitHub Community Discussionでは「再度有効になっていた」という報告も一部あるため、念のため確認しておくことをおすすめします。

4月24日が施行日なので、それまでにオプトアウトしないとデフォルトで有効のまま運用されます。

ケース別チェックリスト — あなたはどうすべきか

「で、結局自分はどうすればいいの?」という方向けに、ケース別に整理しました。

個人でFree/Proを使っている場合

- 上記の手順でオプトアウト設定を確認する

- 個人プロジェクトのコードでも、学習データに使われたくないなら必ずDisabledにする

- オプトアウトしてもCopilotの機能自体は引き続き利用可能

趣味のプロジェクトだから別にいいや、という判断もありです。

ただ、設定を知った上で判断するのと、知らずにデフォルトのままにしておくのは全然違います。

フリーランスで業務コードを扱っている場合

- クライアントのコードをCopilotに通している場合、データ収集は契約違反やNDA抵触のリスクがある

- 即座にオプトアウト設定を確認する

- クライアントに確認を取るか、業務コードではCopilotの使用自体を見直す

- Business/Enterpriseプランへのアップグレードも検討する

フリーランスの方にとっては、これが一番シビアなポイントです。

他社のコードを扱っている以上、「知らなかった」では済まされない可能性があります。

チームのテックリードの場合

- チームメンバーが個人アカウントのFree/ProプランでCopilotを使っていないか確認する

- 組織としてBusiness/Enterpriseプランを導入しているなら対象外(ただし確認は必要)

- 個人アカウントで業務コードにCopilotを使っているメンバーには、設定変更を周知する

- 必要に応じて組織のセキュリティポリシーを更新する

テックリードの方は、自分だけでなくチーム全体の設定を確認する必要があります。

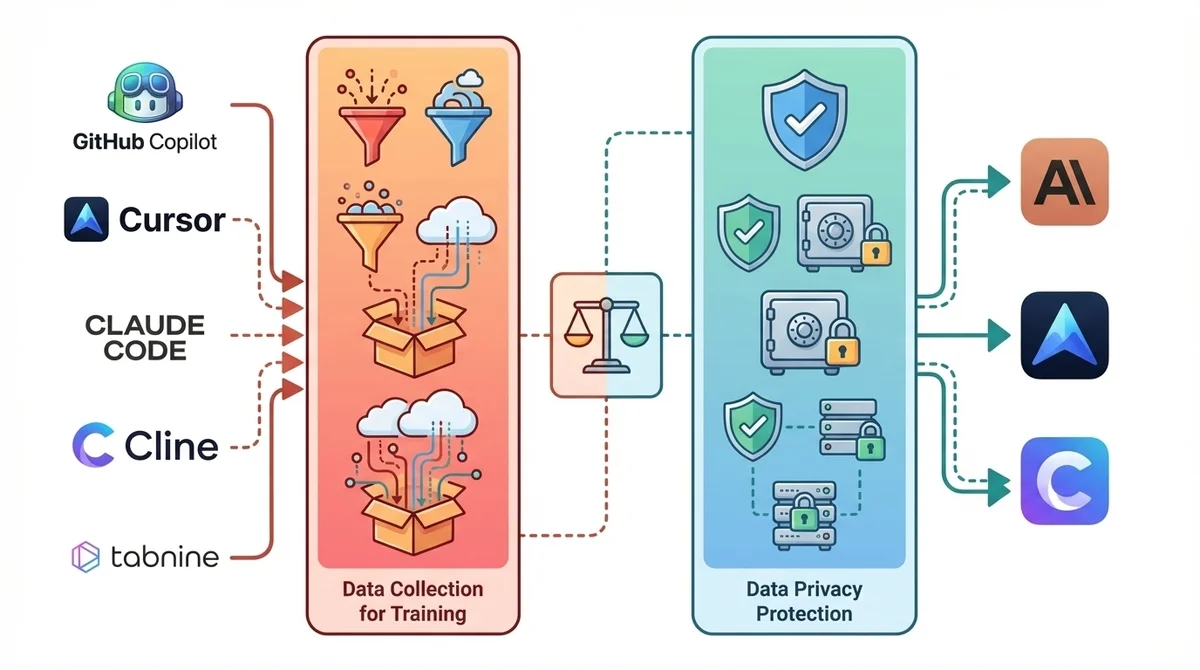

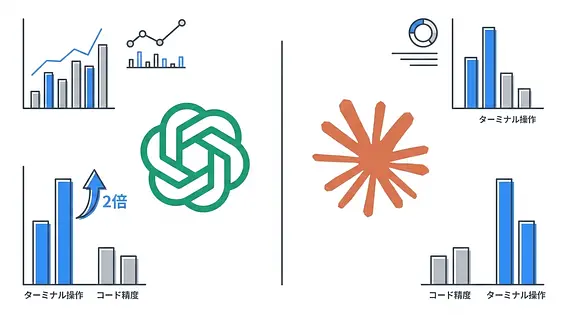

Cursor・Cline・Claude Code・Tabnineはどうなのか — ツール別データポリシー比較

今回の変更をきっかけに、「他のAIコーディングツールはどうなってるの?」と気になった方も多いと思います。

自分も改めて各ツールのポリシーを調べ直したんですが、これが結構違っていて驚きましたね。

同じ「AIコーディングツール」でも、データの扱い方はツールによってかなり差があります。

各ツールのデータポリシー比較表

プライバシー最優先ならどれを選ぶべきか

データが一切外部に出ないことを最優先にするなら、Clineが現時点で最も堅い選択です。

オープンソースで、自前のAPIキーを使ってローカルで動くため、コードがサードパーティのサーバーに保存される心配がありません。

次点でTabnine。

「no-train / no-retain」を明確に打ち出しており、ユーザーのコードを学習にも保存にも使わないと宣言しています。

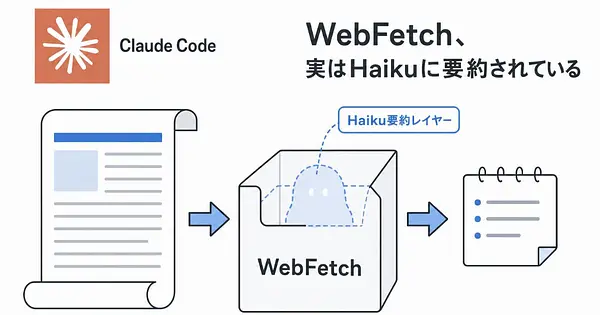

Claude Codeについては、プランによって扱いが異なります。

API・Team・Enterpriseプランではデータを学習に使用しませんが、コンシューマープラン(Free/Pro/Max)では2025年9月よりデフォルトで学習利用がONになっています。

オプトアウトは可能ですが、利用プランによって設定確認が必要です。

CursorはPrivacy ModeをONにすれば学習利用をオプトアウトできますが、デフォルトではOFFです。

Copilotと同様に「デフォルトでオプトアウトされていない」点には注意が必要です。

ただし、ツール選定はプライバシーだけで決めるものではありません。

補完精度、エディタ統合、チャット機能、コスト、チームでの導入しやすさ。

総合的に判断した上で、プライバシー設定を適切にコントロールするのが現実的な落としどころだと思っています。

コミュニティの反応 — なぜエンジニアは怒っているのか

今回のポリシー変更に対する開発者コミュニティの反応は、かなり激しいものでした。

数字と熱量の両面から見てみます。

GitHub Discussionsの反応

GitHub公式のCommunity Discussionでは、サムズダウンが220件以上(記事執筆時点)に達しています。

GitHub VP Martin Woodward氏が公式の立場で擁護コメントを投稿しましたが、コミュニティからの支持はほとんど得られませんでした。

Hacker Newsでも160件以上のコメントが付き、大多数が批判的な論調でした。

「オプトアウト方式」への批判が本質

批判の多くは、データ収集そのものではなく「同意の取り方」に集中しています。

主な批判ポイントを整理すると、こうなります。

- ダークパターンの指摘: データ提供を「機能へのアクセス」として言い換えている

- オプトインであるべき: デフォルトONは不誠実だという意見が大多数

- 企業と個人の非対称性: Business/Enterpriseは保護されるのに、個人開発者は対象になるという構造的な不公平

- GDPR違反の可能性: EU圏のユーザーからは法的な問題を指摘する声も

- 独自コードやシークレットの漏洩リスク: フィルタリングの完全性を疑問視する意見

これだけ広範な批判が出ている背景には、「AIツールを使うことで自分のコードが学習に使われる」という問題意識がエンジニアの間に確実に広がっていることがあると思っています。

自分の率直な感想としては、データ収集自体はAI改善のために理解できる判断です。

ただ、「オプトインではなくオプトアウトにした」という設計判断は、ユーザーへの信頼を損なうやり方だと思います。

また、2025年ごろから著名な開発者たちが「Copilotに渡したコードがトレーニングデータとして使用されないことをGitHubは本当に保証できるのか」という懸念を表明していた経緯を考えると、今回の変更は「その懸念が現実になった」と受け取られても仕方ないですね。

まとめ — エンジニアとして今すぐ取るべき3つのアクション

最後に、この記事を読んだ方が今すぐやるべきことをまとめます。

1. 設定を確認する(1分)

https://github.com/settings/copilot にアクセスして、「Allow GitHub to use my data for AI model training」をDisabledにする。

以前設定済みの方も再確認してください。

2. チームに周知する(5分)

個人アカウントのFree/ProプランでCopilotを使っているチームメンバーがいれば、この記事のURLを共有してください。

特にフリーランスや業務委託のメンバーには必ず伝えておくべきです。

3. ツールのデータポリシーを定期的に確認する(習慣化)

今回のケースが示しているのは、「サービスのポリシーは事前通告なく変わり得る」という事実です。

Copilotに限らず、CursorやCline、Claude Codeなど、自分が使っているツールのデータポリシーは定期的にチェックする習慣をつけておいた方がいいですね。

AIコーディングツールは開発効率を劇的に上げてくれる優れた道具ですが、自分のコードがどう扱われるかは、自分で管理する必要があります。

設定ひとつで済む話なので、まだの方は今すぐ確認してみてください。

よければXもフォローしてもらえると嬉しいです → X(@morphox_ai)

💬 コメント

ログイン か 会員登録 するとコメントできます