こんにちは、もるふぉ@morphox_ai です。

「Claude Codeの請求額、今月もエグいな......」と思ったこと、ありませんか。

自分もまさにそのクチで、毎月のAPI費用を見てはため息をついてたんですが、そこに飛び込んできたのが Qwen3.6-Plus です。

2026年4月2日にAlibaba Cloudからリリースされたこのモデル、Terminal-Bench 2.0でClaude Opus 4.5を超え、しかもコストはClaude Opus 4.6の5分の1以下。

「いや、さすがに話がうますぎるだろ」と思いますよね。

自分もそう思いました。

だからこそ、コスト、ベンチマーク、実際の使い方まで正直にレビューしていきます。

コスト比較 -- Claude Opus 4.6の5分の1以下で使える現実

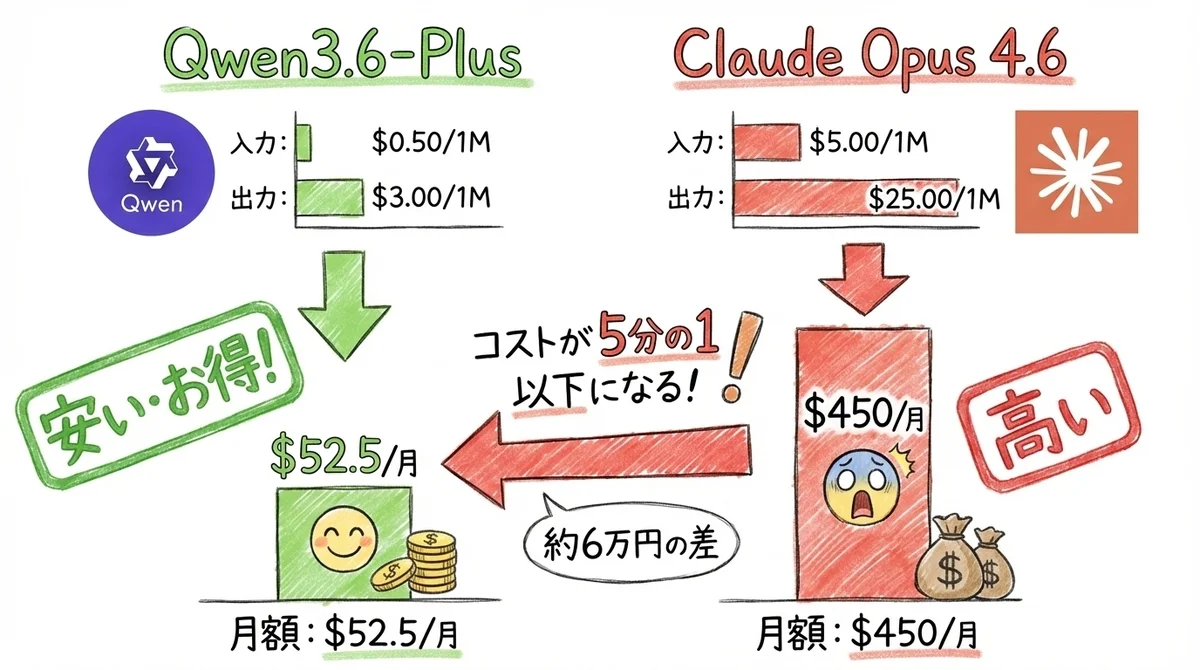

入出力トークン料金の計算例

これを見てください。

出力トークンの差がエグいです。

Claude Opus 4.6の$25.00に対して、Qwen3.6-Plusは$3.00〜$6.00。

「いやそれ、規模が小さいとたいした差じゃないでしょ」と思った人、具体的に計算してみます。

1日あたり入力50万トークン・出力50万トークンを使うエンジニアの場合、月額はこうなります。

- Claude Opus 4.6: (0.5M × $5.00 + 0.5M × $25.00) × 30日 = $450/月

- Qwen3.6-Plus: (0.5M × $0.50 + 0.5M × $3.00) × 30日 = $52.5/月

月額で約$400の差。

日本円にして約6万円。

個人開発者なら年間70万円以上の削減になる計算です。

スタートアップのチームで複数人が使っていれば、その差はさらに広がります。

「10倍とまではいかないけど、それでも十分すぎる差じゃないか」と思いませんか。

OpenRouterでの無料プレビュー期間の活用法

さらに嬉しいことに、OpenRouterでは現在Qwen3.6-Plusのプレビュー期間中で完全無料で使えます。

Alibaba Cloudのアカウントすら不要です。

OpenRouterのアカウントさえあれば、今すぐAPIを叩けます。

「まず試してみたい」という人にとっては、これ以上ない入り口ですよね。

コストゼロのプレビュー期間がいつ終わるかは明言されていないので、気になる人は早めに触っておくことをおすすめします。

コストの話をしたところで、「そもそも性能はどうなの?」という疑問が出てきますよね。

次は正直にベンチマークを見ていきます。

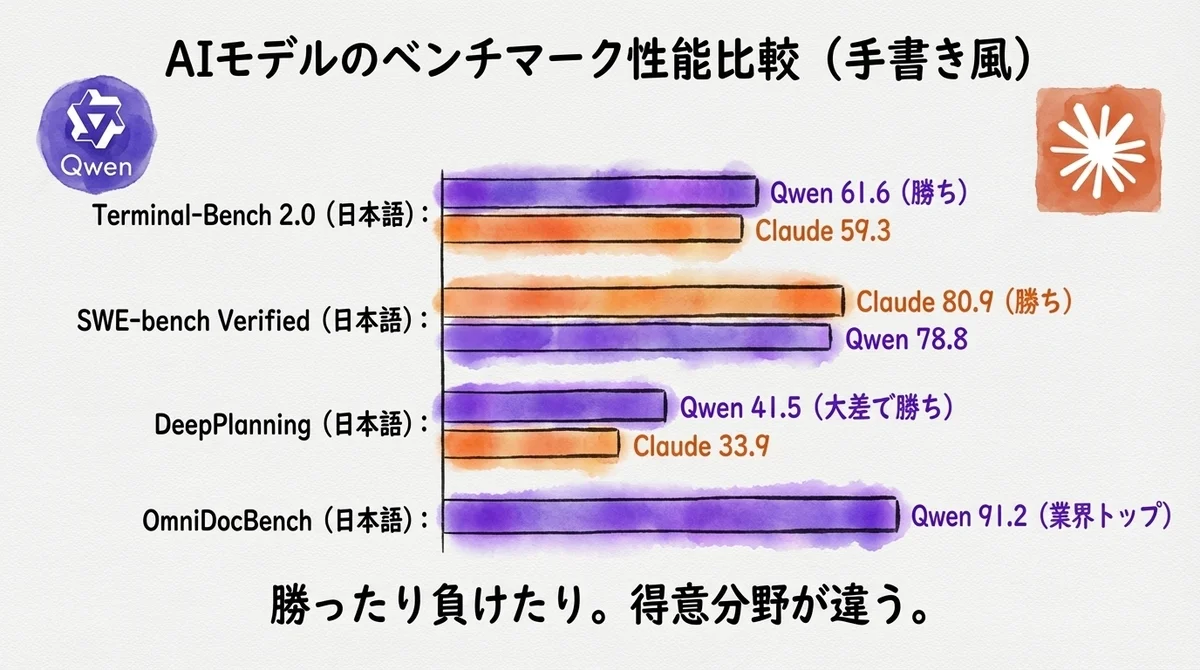

ベンチマーク比較 -- Claude・Geminiとの差分を正直に見る

コーディングエージェント系(Terminal-Bench / SWE-bench)

エンジニアが一番気になるコーディング性能の比較です。

※Alibabaが公式発表したもので比較対象がOpus4.5 であることに注意してください。

ここが面白いところで、Terminal-Bench 2.0でClaudeを2.3ptリードしている一方、SWE-bench VerifiedではClaudeに2.1pt負けています。

DeepPlanning(長期計画タスク)では7.6ptの大差をつけている点も、エージェント用途で使いたい人には注目の数字ですね。

つまり、「ターミナル操作を含むエージェントタスク」ではQwen3.6-Plusが強く、「既存コードのバグ修正」ではClaudeがまだ上、という棲み分けが見えてきます。

マルチモーダル・ドキュメント理解系

コーディング以外のベンチマークも見ておきます。

- MMMU: 86.0(Gemini 3 Proの87.2に次ぐ2位)

- OmniDocBench v1.5: 91.2(業界トップ)

- GPQA: 90.4

- IFEval strict: 94.3

「OmniDocBench v1.5で業界トップ」というのは、数値だけだとピンとこないかもしれませんが、要は仕様書やAPIドキュメントを読み込ませてコードを書かせるユースケースで特に強いということです。

「PDF仕様書を食わせて実装して」というタスクをよくやる人にとっては、かなり魅力的なスコアですね。

弱い点も正直に

ここは正直に書きます。

SWE-bench VerifiedでClaudeに2pt差で負けています。

既存コードベースのバグ修正タスクでは、Claudeの方がまだ精度が高いということです。

GPT-5.4にはTerminal-Benchで14ptの大差をつけられてもいます。

「全勝です!乗り換えましょう!」なんて言うつもりはありません。

勝ったり負けたりが正確な現状で、得意分野が違うんです。

ただ、この性能差でコストが5分の1以下なら、使い所の設計次第で十分戦えます。

次はそのスペックを支えるアーキテクチャの話です。

Qwen3.6-Plusとは何か -- 2分で把握できるスペックと特徴

AlibabaのAIモデルが「3.6-Plus」になった意味

Qwen(通義千問)はAlibaba Cloudが開発するLLMシリーズで、Qwen3.5からの正統進化版がこのQwen3.6-Plusです。

主な進化ポイントを整理すると、こうなります。

- MoE(Mixture of Experts)アーキテクチャ採用 -- パラメータ効率が劇的に改善

- 常時CoT(Chain of Thought)推論 -- 思考プロセスが常にオン

- マルチモーダル対応 -- 画像、動画、ドキュメントを理解

- 多言語対応 -- MMLU-ProXベンチマークで29言語を評価した広範な多言語サポート

- 100万トークンのコンテキストウィンドウ -- 巨大リポジトリもまるごと投入可能

ここが面白いところなんですが、Qwen3.5で問題になっていた「overthinking(考えすぎ)」が3.6-Plusでは解消されています。

思考トークンが際限なく膨張して遅くなる問題、3.5を触ったことがある人なら「あー、あれね」ってなるはずです。

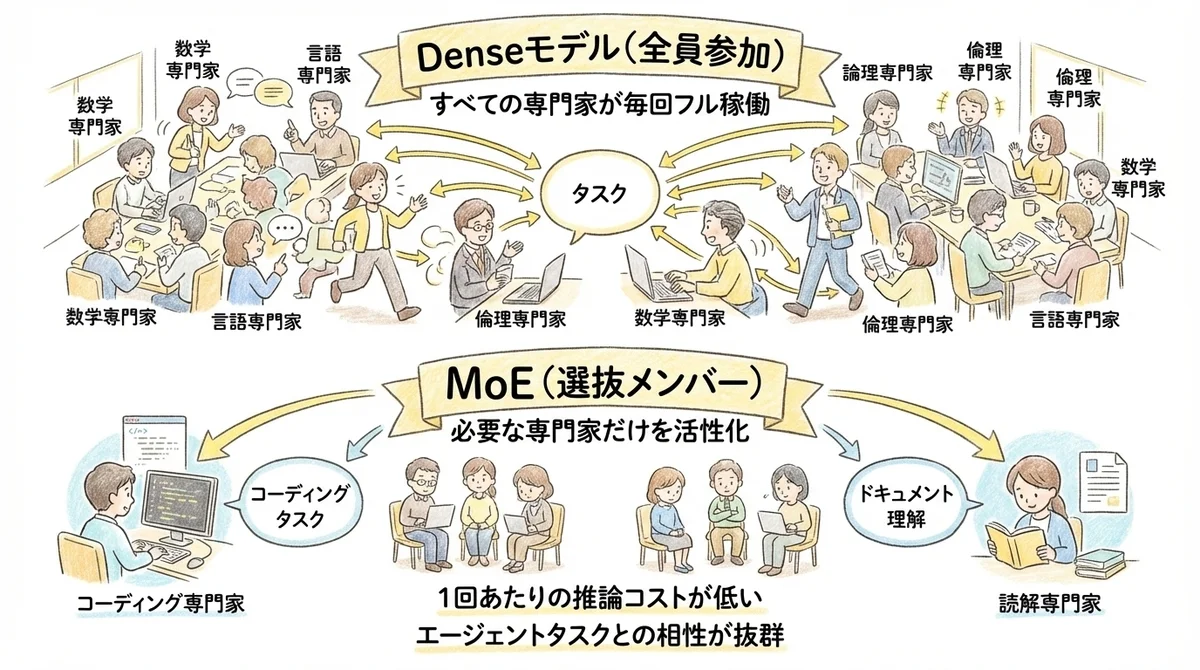

MoEアーキテクチャで「思考しながら動く」仕組み

MoE(Mixture of Experts)を簡単にエンジニア向けに説明します。

通常のDenseモデル(GPT-4やClaudeなど)は、すべてのパラメータを毎回フル稼働させます。

これに対してMoEは、タスクの種類に応じて「専門家(Expert)」モジュールを選択的に活性化させます。

いわばチームのプロジェクトアサインと同じ発想で、コーディングタスクならコーディングが得意なExpertが、ドキュメント理解なら読解が得意なExpertが前面に出てくる仕組みです。

全員総動員ではなく、必要な専門家だけ呼ぶ。

この設計が効いてくるのがエージェントタスクです。

エージェントは「計画→実行→検証→修正」のループを何十回も回すので、1回あたりの推論コストが低いMoEは相性が抜群なんですよ。

つまり、コストが安いのは「手を抜いているから」ではなく、「賢く設計されているから」というわけです。

100万トークンのコンテキストウィンドウが実務でどう変わるか

100万トークンは、おおよそ2,000ページのテキストに相当します。

Railsプロジェクトで言えば、中規模のリポジトリ(app/配下のモデル・コントローラー・ビュー一式)をまるごと読み込める計算です。

これが地味にすごいんですよ。

「このファイルも読んで」「あのファイルも追加で」とコンテキストを小分けに渡していたストレスから解放されます。

リポジトリ全体を食わせて「このプロジェクトのアーキテクチャを理解した上でリファクタリングして」と一発で投げられる。

ではこのスペックを活かす新機能、preserve_thinkingについて解説します。

新機能「preserve_thinking」でQwen3.6-Plusを使いこなす

マルチターンのエージェントループで推論が引き継がれる仕組み

通常のLLMは、APIのターン(リクエスト)ごとに思考プロセスがリセットされます。

前のターンで「Aの方針でいこう」と推論しても、次のターンでは白紙からやり直しです。

「え、さっきの判断、もう忘れたの?」ってなること、エージェントを使い込んでいる人は経験があると思います。

preserve_thinkingをオンにすると、前ターンの推論プロセスが次のターンに引き継がれます。

つまり、エージェントの「計画→実行→検証→修正」ループで文脈が途切れないんです。

APIでの設定はこうなります。

response = client.chat.completions.create(

model="qwen3.6-plus",

messages=messages,

stream=True,

extra_body={

"enable_thinking": True,

"preserve_thinking": True

}

)OpenAI互換のAPIフォーマットなので、既存のコードベースにほぼそのまま組み込めます。

これが実務でどう効くかというと、マルチファイルにまたがるリファクタリングで「さっき決めた方針」を覚えたまま次のファイルに取り掛かれるんですよ。

「Aパターンで統一する」と決めたら、5ファイル目でもブレずにAパターンで書いてくる。これが嬉しいんです。

Qwen3.5の「overthinking問題」との比較

Qwen3.5では、思考トークンが膨張して推論が遅くなる「overthinking問題」がありました。

簡単なタスクでも延々と考え込んで、レスポンスが返ってこない。

思考トークン分のコストも無駄に膨らむ。

「考えたのに遅いし高い」という二重苦だったわけです。

3.6-Plusではこの推論効率が大幅に改善されています。

「考えすぎない」モデルになったことで、速度とコストの両面で恩恵を受けられます。

どんなタスクでONにすべきか

preserve_thinkingを使うべきタスクと、不要なタスクを整理しておきます。

ONにすべきタスク:

- マルチファイルにまたがる修正

- 大規模リファクタリング

- テスト生成→実行→修正のループ

- リポジトリレベルの設計タスク

- DeepPlanningスコアが活きる長期計画タスク

不要なタスク:

- 単純な質問への回答

- 1ショットのコード生成

- コード補完

- 定型的なボイラープレート生成

基本的に「複数ターンにわたるエージェントループ」が発生するタスクでONにする、と覚えておけばOKです。

次は、実際にClineで使うための設定手順を見ていきます。

Clineへの接続手順 -- Qwen3.6-Plus APIの実際の設定方法

Alibaba Cloud Model StudioでAPIキーを取得する

まずはAlibaba Cloud Model Studioでアカウントを作成してAPIキーを発行します。

5分もあれば完了します。

- Alibaba Cloud Model Studio にアクセス

- アカウントを作成(Google認証で簡単に登録可能)

- ダッシュボードからAPIキーを発行

Qwen Codeの無料ティアでは1日1,000回のAPI呼び出しが可能です。

「とりあえず試したい」段階なら、クレジットカードを登録しなくても使い始められるので、まずは無料枠で感触を掴むのがおすすめです。

ClineでOpenAI互換エンドポイントを設定する

ClineでQwen3.6-Plusを使うための設定です。

Clineの設定画面で以下を入力します。

- Provider: OpenAI Compatible

- API Base URL:

https://dashscope-intl.aliyuncs.com/compatible-mode/v1 - Model:

qwen3.6-plus - API Key: Model Studioで発行したキー

{

"provider": "openai-compatible",

"apiBase": "https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

"model": "qwen3.6-plus",

"apiKey": "sk-xxxxxxxxxxxxxxxxxxxxxxxx"

}OpenAI互換のエンドポイントなので、Cline側の特別な対応は不要です。

設定したらすぐに使い始められます。

OpenRouterを経由して使う場合の設定

「Alibaba Cloudのアカウントを作るのが面倒」という人は、OpenRouter経由がおすすめです。

- Provider: OpenRouter

- API Base URL:

https://openrouter.ai/api/v1 - Model:

qwen/qwen3.6-plus-preview - API Key: OpenRouterのAPIキー

{

"provider": "openrouter",

"apiBase": "https://openrouter.ai/api/v1",

"model": "qwen/qwen3.6-plus-preview",

"apiKey": "sk-or-xxxxxxxxxxxxxxxxxxxxxxxx"

}OpenRouter経由なら、プレビュー期間中は無料で使えます。

Alibaba Cloudのアカウントも不要なので、アカウント登録ゼロで今すぐ試せるのが最大のメリットですね。

「まずはコピペで動かしてみる」なら、OpenRouter経由が最速です。

まとめ -- 誰が使うべきか・誰はまだ待った方が良いか

Qwen3.6-Plusは「Claudeキラー」ではなく「Claudeの代替選択肢」というのが正直な評価です。

使うべき人:

- Claude Codeの月額コストが気になっているエンジニア

- ドキュメント理解タスク(仕様書→実装)が多い人

- 100万トークンのコンテキストウィンドウを活かしたい人

- 新しいモデルを試したいアーリーアダプター

- OpenRouterの無料プレビュー期間を活用したい人

待った方が良い人:

- SWE-bench的なバグ修正精度を最重視する人

- Claude Codeで安定運用できていて不満がない人

- 中国系クラウドサービスのデータポリシーが気になる人

自分の使い方としては、「メインはClaude Code、コストを抑えたいタスクやドキュメント理解系はQwen3.6-Plus」という二刀流が現時点でのベストプラクティスだと考えています。

Claudeと比べてコストは5分の1以下、ベンチマーク上は互角以上の性能。

まずOpenRouterでアカウント登録して、設定をコピペして、今日の開発タスクを1個投げてみてください。

それだけでいいです。「あ、使えるな」と思えれば、そこから自然に二刀流になっていきます。

よくある質問

Qwen3.6-PlusはClineで使えますか?

使えます。Clineの「OpenAI Compatible」プロバイダーとして設定するだけで、すぐに利用を開始できます。エンドポイントは https://dashscope-intl.aliyuncs.com/compatible-mode/v1、モデル名は qwen3.6-plus です。OpenRouter経由ならAlibaba Cloudのアカウントすら不要です。

Qwen3.6-PlusはOpenRouterで無料で使えますか?

2026年4月時点のプレビュー期間中は、OpenRouterで無料で利用できます。ただしプレビュー終了のタイミングは明示されていないため、早めに試すことをおすすめします。Alibaba Cloud Model Studio直接接続の場合は、無料ティアで1日1,000回のAPI呼び出しが可能です。

preserve_thinkingとは何ですか?

Qwen3.6-Plusのマルチターンエージェント向け機能で、前のAPIターンの推論プロセスを次のターンに引き継ぐ仕組みです。エージェントの「計画→実行→検証→修正」ループで文脈が途切れないため、マルチファイルにまたがるリファクタリングや大規模タスクで特に効果を発揮します。APIパラメータで "preserve_thinking": true を設定するだけで有効になります。

Qwen3.6-PlusはClaude Codeの代替になりますか?

完全な代替というよりは「使い分け」の選択肢です。ターミナル操作を含むエージェントタスクやドキュメント理解系ではQwen3.6-Plusが優位ですが、既存コードのバグ修正精度ではClaudeがまだ上という結果が出ています。コストはClaude Opus 4.6の5分の1以下なので、「メインはClaude Code、コスト最適化したいタスクはQwen3.6-Plus」という二刀流が現実的なアプローチです。

💬 コメント

ログイン か 会員登録 するとコメントできます