Runway Charactersとは何か?一言で言うと「AIと顔を見ながら会話できるシステム」

「Runway Characters」という名前、Xのタイムラインで見かけた方も多いのではないでしょうか。

「なんかすごそうだけどよくわからない」「流れてきたデモ動画を見たら衝撃だったけど、自分に関係ある技術なのかよくわからない」──そんな感じで、スクロールしながら微妙に気になってませんでしたか。

わかります、私も最初そうでした。

先に結論だけお伝えすると、これは1枚の写真から、リアルタイムで会話できるAIキャラクターを生成する技術です。

しかも、ただの動画生成ではありません。

こちらの声に反応して、表情を変え、目を動かし、口の動きを合わせて話し返してくる。

映画の中のAIが、かなり現実に近づいてきたなと感じる技術です。

Runway Charactersは2026年3月に登場した新しいタイプのAI

Runway Charactersは、AI動画生成で知られるRunway MLが2026年3月に発表したサービスです。

同社が2025年12月に発表した「GWM-1(General World Model)」という技術をベースにしていて、写真1枚を入力するだけで、その人物やキャラクターがリアルタイムに動いて喋るAIエージェントを作れます。

ファインチューニング(追加学習)は不要。

フォトリアルな人間だけでなく、アニメキャラクターやブランドマスコットなど、多様なスタイルに対応しています。

Runway Charactersと従来の動画生成AIの決定的な違い

「AI動画生成」と聞くと、RunwayのGen-4やSoraのような「テキストから動画を作る」ツールを思い浮かべるかもしれません。

でもRunway Charactersはまったく別物です。

従来のAI動画生成は「完成した動画を出力する」一方通行のツール。

Runway Charactersはリアルタイムで双方向にやり取りできるという点が根本的に違います。

ここで「リアルタイム」ってどのくらい速いか気になりますよね。

遅延はわずか100ミリ秒以下です。

つまり、人と会話しているのとほぼ変わらないスピードでAIキャラクターが反応するわけです。

「録画メッセージを受け取る」のではなく「ビデオ通話で話す」くらいの違いがある。

この感覚のギャップは、記事を読むだけではなかなか伝わらないくらいです。

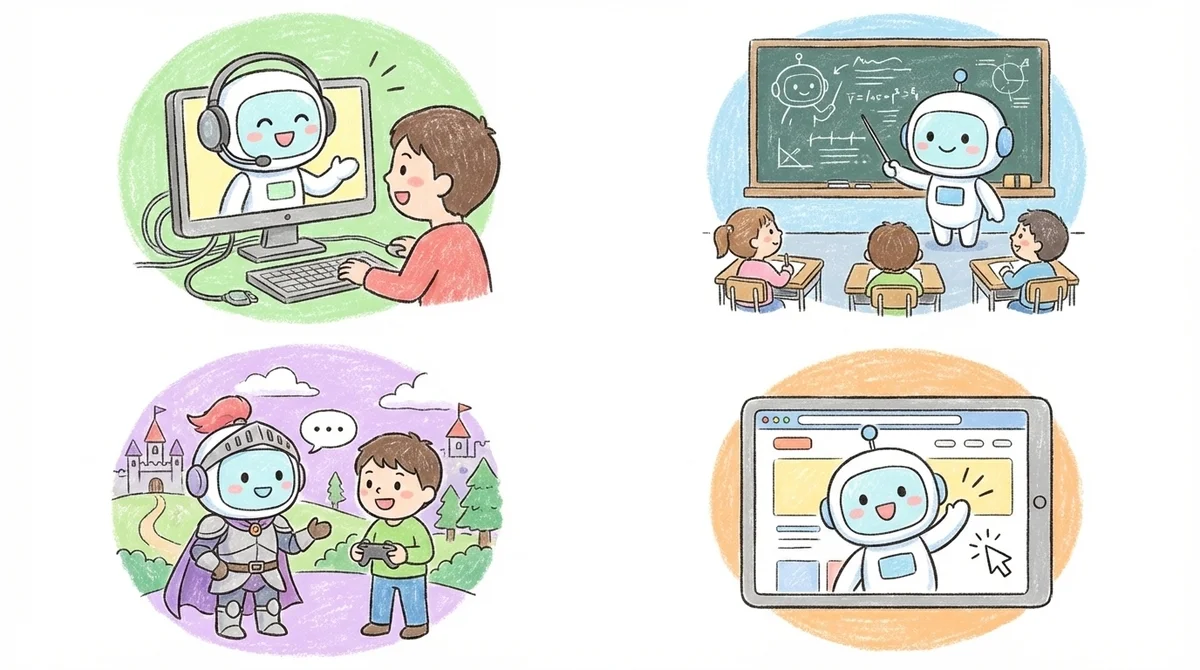

Runway Charactersでできること──4つの活用シーン

「技術としてすごいのはわかった。でも何に使えるの?」

これが一番気になるポイントですよね。

現時点で想定されている活用シーンを4つ紹介します。

これが意外と「あ、自分の仕事でも使えそう」と感じるものが多いんです。

24時間対応のAIカスタマーサポートキャラクター

チャットボットって、テキストだけだとどうしても「機械的で冷たい」印象がありませんか。

Runway Charactersなら、自社のブランドイメージに合ったキャラクターが顔を見せて、声で対応してくれます。

24時間365日、疲れることなく、感情豊かに。

しかもツール呼び出し機能があるので、在庫確認や予約システムなど外部ツールとの連携も可能です。

つまり「顔のある、頭の賢いカスタマーサポートスタッフ」が夜中の2時でも待機してくれるイメージです。

たとえば自分の会社で問い合わせ対応を担当している方なら、深夜や休日のメール対応がそのままAIキャラクターに代替される未来が、かなりリアルに想像できるのではないでしょうか。

リアルタイムで答えてくれるAI講師・コーチ

社内研修やスキルトレーニングで、「動画を見て終わり」になっていませんか。

Runway Charactersを使えば、質問に答えてくれるインタラクティブな講師を作れます。

受講者の理解度に合わせてリアルタイムで対話できるので、一方的な動画視聴とは学習効果がまるで違うはずです。

「わからないところで質問できる」という、これだけで従来のeラーニングとは別物の体験になります。

これって要するに「研修担当者がいなくてもインタラクティブな研修が24時間回せる」ということで、人事・教育担当の方には特に刺さるポイントではないでしょうか。

ゲームや体験コンテンツのインタラクティブNPC

ゲーム開発の世界では、プレイヤーの行動に応じて反応する動的なNPC(ノンプレイヤーキャラクター)が長年の課題でした。

Runway Charactersなら、1枚のキャラクターイラストから、プレイヤーと自然に会話できるNPCを実現できます。

「台本通りにしか動かないモブキャラ」が「本当に会話できる住人」になる、と言えばゲームをやる方には伝わるでしょうか。

たとえばゲーム会社や体験型コンテンツを扱う事業者なら、これまで膨大なスクリプトで管理していたNPCの会話設計が根本から変わる話です。

企業のブランドキャラクターを"会話できる存在"に

すでにマスコットキャラクターを持っている企業にとって、これは大きなチャンスです。

静止画やアニメーションでしか存在しなかったキャラクターが、ユーザーと直接会話できるようになる。

これが何を意味するかっていうと、ブランドの「顔」がそのままAIアシスタントになれるということです。

BBCやクリエイティブエージェンシーのSilversideといった有力パートナーがすでに採用しているのも、この可能性に賭けているからでしょう。

自社キャラクターが眠っている企業のマーケ担当からすると、「キャラクターがそのままウェブ接客できる」という発想転換は、かなりインパクトがあるはずです。

技術の仕組みをざっくり理解する──GWM-1って何?

「仕組みはいいから使い方を教えてくれ」という気持ちもわかるのですが、Runway Charactersがなぜ「別物」なのかを理解するために、技術の核心だけ簡単に押さえておきましょう。

ここを知っておくと、「料金が適正かどうか」「他ツールと何が違うか」も自分で判断できるようになります。

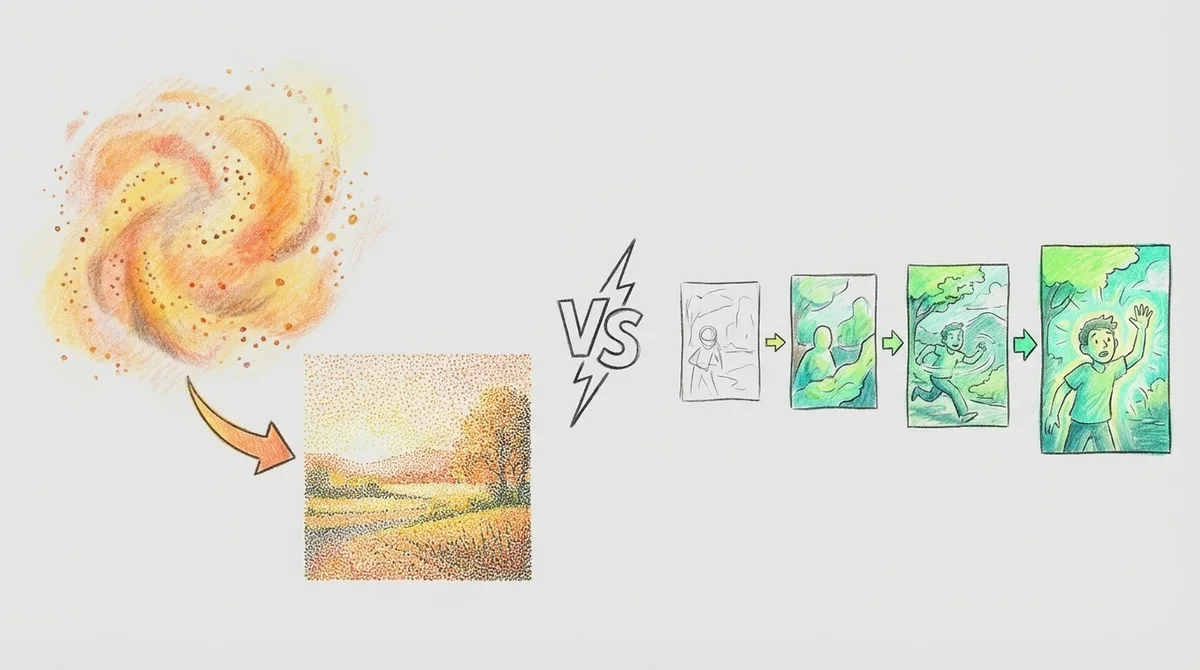

「世界モデル」という概念──AIが"世界を理解する"ということ

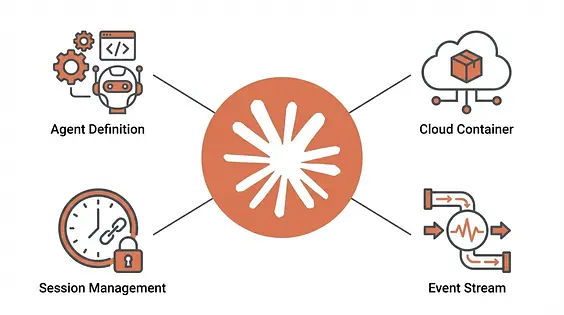

Runway Charactersの基盤技術は「GWM-1(General World Model)」と呼ばれています。

「世界モデル」というのは、AIが映像の中の物理法則や因果関係を"理解"した上で、次に何が起きるかを予測する仕組みのことです。

ちょっとわかりにくいですよね。

比喩で説明します。

従来のAI動画生成(拡散モデル)は、いわば「点描画を描くような作り方」です。

画像全体をぼんやり作ってから徐々に鮮明にしていく。

完成品を一発で出力する一方向の仕組みです。

GWM-1はまったく違います。

1フレームずつ、前のフレームを見て「次はこうなるはず」と予測しながら順番に映像を生成していきます。

漫画で例えると、4コマ漫画を「完成品を一気に描く」のではなく「1コマ目を描いて、それを見ながら2コマ目を描いて……」という順番で作っているイメージです。

この「前を見て次を予測する」という動きが、会話のリアルタイム性を生んでいます。

リアルタイムで反応できる理由(遅延100ms以下の意味)

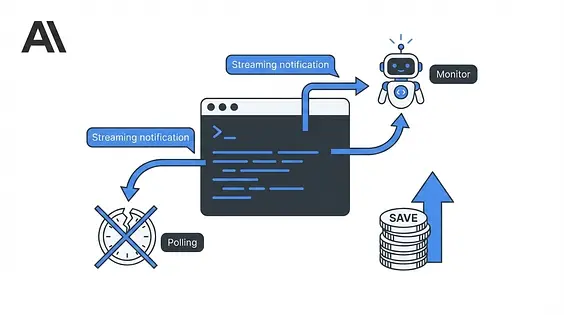

この「1フレームずつ順番に生成する」仕組みが、リアルタイム対応を可能にしています。

イメージとしては、ゲームのリアルタイムレンダリングに近いです。

ゲームも1秒間に60フレームの映像をリアルタイムで生成していますよね。

GWM-1もNVIDIA GPUを使って同じようなことをやっていて、音声入力やカメラ制御といった外部からの指示にその場で反応しながら映像を作り続けます。

だから遅延が100ミリ秒以下、つまりほぼ「会話のテンポ」で映像が返ってくるんです。

Runway Charactersの料金・提供状況──今すぐ使える?

ここが一番聞きたいところだと思います。

正直に書きます。

現在はEnterprise向け先行提供

2026年4月時点で、Runway CharactersのフルAPI機能はEnterprise(企業向け)の先行提供が中心です。

個人ユーザーがRunwayのウェブアプリからプリセットアバターにアクセスすることは可能ですが、カスタムキャラクターの作成やAPI連携といった本格的な機能はまだ限定的です。

「え、じゃあまだ早い?」と思いましたよね。

でも、完全にクローズドというわけでもないんです。

個人向けの展開予定と「Builders Program」

Runwayは「Builders Program」という、1,000万ドル(約15億円)規模のファンドを立ち上げて、初期段階のスタートアップや開発者を支援しています。

2026年4月2日にはニューヨークでCharacters Hackathonも開催されました。

個人開発者向けには dev.runwayml.com でドキュメントやReact SDKが公開されていて、開発を始めること自体は可能です。

つまり、「今すぐ個人で全機能を使い倒す」は難しいけれど、「動向を追う・触れてみる」は十分できる段階です。

試してみたい人が今できること

「とりあえず雰囲気を知りたい」という方は、以下の方法があります。

- Runwayアカウントを作成する: 無料でアカウントを作ると125クレジット(一回限り)がもらえます

- プリセットアバターを試す: ウェブアプリ上で用意されたキャラクターとのインタラクションが体験できます

- 開発者ドキュメントを眺める: dev.runwayml.com で技術的な全体像を確認できます

料金体系はクレジットベースで、1クレジットあたり$0.01。

リアルタイムアバターの利用は初期2クレジット + 6秒ごとに2クレジットかかります。

つまり1時間の会話で約1,200クレジット、日本円にして約1,800円です。

この価格をどう見るかですが、24時間対応のカスタマーサポートスタッフの人件費と比べれば、ビジネス利用としてはかなりリーズナブルと言えます。

HeyGen・Synthesiaとの比較──Runway Charactersが"別物"な理由

AIアバターツールと聞くと、HeyGenやSynthesia、D-IDなどを思い浮かべる方もいるでしょう。

「結局何が違うの?」を整理します。

既存のAIアバターツールとの根本的な差

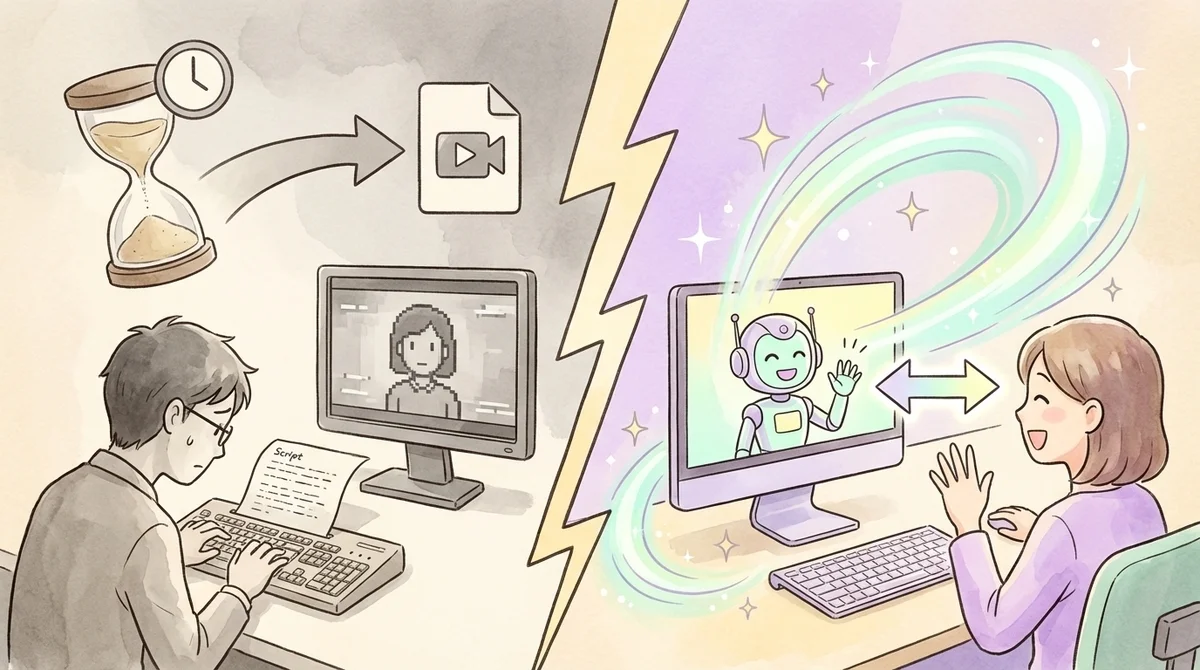

「リアルタイム」が変えるユーザー体験

この表で最も重要なのは「リアルタイム対応」の行です。

HeyGenやSynthesiaは基本的に「動画を事前に作る」ツール。

台本を入力して、完成した動画を受け取る、という流れです。

Runway Charactersは会話しながらその場で映像が生成される。

この違い、言葉で読むと小さく感じるかもしれませんが、体験としてはまるで別物です。

HeyGenが「プレゼン動画を作るツール」だとしたら、Runway Charactersは「AIがリアルタイムでプレゼンをしてくれるツール」です。

用途がまったく違うので、どちらが優れているという話でもないですが、「新しいカテゴリが生まれた」と理解するのが一番正確です。

非エンジニアの会社員にとっての現実的な活用シナリオ

ここまで全体像を見てきましたが、もう少し具体的に"自分の職場で何が起きるか"を想像してみましょう。

「すごい技術なのはわかったけど、自分の仕事に関係ある?」

正直に言います。

今日この瞬間から業務に組み込める段階ではありません。

でも、「知っておく価値がある」技術か?というと、これは間違いなくYESです。

自社サービスのFAQ対応に使えるか?

正直なところ、今すぐ導入するのは現実的ではありません。

Enterprise向け提供が中心で、日本語対応もまだ発展途上だからです。

ただし、半年から1年後を見据えると話は変わります。

自社のFAQページに、テキストチャットボットの代わりに「顔のあるAIキャラクター」が常駐する未来は、かなり現実味を帯びてきています。

今のうちにRunway Charactersの動向を追っておけば、社内で「こういう技術があるんですが」と提案できるネタになります。

「情報を知っていた人」と「知らなかった人」の差は、半年後に意外なほど大きくなるものです。

社内研修・ロールプレイングへの応用

個人的に一番「これは来る」と感じているのが、社内研修での活用です。

たとえば営業トレーニングで、AIキャラクターが「難しい顧客」役を演じてくれる。

表情も声もリアルで、こちらの言葉にリアルタイムで反応する。

従来のeラーニングとはまったく違う、実践に近い練習環境が作れるはずです。

「何度失敗してもいい練習相手」が、コスト1,800円/時間で用意できる時代が来る。

これ、なかなかインパクトのある変化だと思いませんか。

まとめ──Runway Charactersが示す「AIとの関わり方」の未来

Runway Charactersは、AIとの付き合い方を根本から変える可能性を持った技術です。

ポイントを振り返ると、以下の通りです。

- 1枚の写真からリアルタイムで会話できるAIキャラクターを生成できる

- 遅延100ms以下のストリーミング生成で、自然な対話体験を実現

- カスタマーサポート、教育、ゲーム、ブランドなど活用シーンが幅広い

- 現時点ではEnterprise向け中心だが、個人向けの道筋も見えている

- 1時間の会話で約1,800円という、ビジネス利用にはリーズナブルな価格設定

正直に言うと、今日この瞬間に個人で使い倒せる段階ではありません。

でも、この技術が示している方向性──AIが「テキスト」から「映像と対話」へ進化している──は、間違いなく今後のトレンドです。

半年後、1年後に「あのとき情報を追っていてよかった」と思える可能性が高い技術だと私は感じています。

今日すぐできる最初の一歩は、Runwayのアカウントを作って、プリセットアバターを触ってみることです。

無料で125クレジットもらえます。

登録してプリセットアバターと一言話してみるだけでいい。

「AIってここまで来たのか」という体験を、まず自分の目で確かめてみてください。

それだけで、この技術への解像度がぐっと上がるはずです。

💬 コメント

ログイン か 会員登録 するとコメントできます