Seedance 2.0は、HiggsfieldというAI動画プラットフォームで使えるByteDance製の最新動画生成モデルです。

画像生成AIでキャラやイラストを作るのはもう日常になったけど、「これ、動かせたらなあ...」って思ったこと、ありませんか。

自分もずっとそう思ってました。

Midjourneyで作ったキャラが静止画のまま眠ってるフォルダ、数百枚。

で、ついに見つけたのがByteDanceのAI動画生成モデル「Seedance 2.0」と、その機能を最大限に活かせるプラットフォームHiggsfieldの組み合わせです。

この記事では、Seedance 2.0の基本から、Higgsfieldでの登録手順、そして「自分の絵を実際に動かす」ためのプロンプト設計まで、全手順を解説していきます。

ちなみに今回の記事は、Xで大きな反響があったMikoさん(@Mho_23)のSeedance 2.0ガイドに触発されて、日本語で実践してみた記録でもあります。

日本からの利用について(2026年4月時点)

HiggsfieldのSeedance 2.0は、現時点で日本および米国からは利用できない状態です。

日本ユーザーは以下の代替手段でSeedance 2.0を使えます。

- Dreamina(CapCut): ByteDance公式プラットフォーム。Text-to-VideoとImage-to-Videoが利用可能

- Runway: 同モデルをサードパーティモデルとして提供

- API経由(fal.ai等): 開発者向けにAPIでSeedance 2.0を直接呼び出せる

この記事ではHiggsfieldの操作手順を中心に解説しますが、プロンプトの設計思想はDreaminaやRunwayでも共通です。

Higgsfieldは世界的に最も機能が充実したプラットフォームであり、地域制限が解除された際にすぐ使えるよう、仕組みをしっかり理解しておくことをおすすめします。

Seedance 2.0とは?ByteDance発のAI動画生成モデル

「またあたらしいAI動画ツールか」——正直そう思いませんでしたか。

自分もそうでした。

でも、Seedance 2.0はちょっと違います。

Seedance 2.0は、TikTokの親会社ByteDanceが開発したAI動画生成モデルです。

2026年4月にHiggsfieldで一般公開され、テキスト・画像・動画・音声をまとめて入力して1本の動画を生成できる「マルチモーダル入力」に対応しています。

1回の生成で最大15秒のクリップが作れます。

他のAI動画ツール(Kling・Runway・Sora)との違い

正直、AI動画生成ツールって今たくさんあるので混乱しますよね。

ここがミソなんですよ。どれを使っても似たようなものじゃないかって思いがちですが、比べてみると個性がはっきり出てきます。

つまり、このモデルは「同じキャラを複数の素材を使って動かす」ことに特化した設計になっています。

最大の武器は「キャラクターの一貫性」と「ネイティブ音声生成」、そして「マルチモーダル入力」です。

画像・動画・音声を同時に参照しながら生成できる仕組みは、他のツールにはない強みです。

顔、服装、スタイルを複数シーンにわたって維持してくれるので、「同じキャラが別カットで別人になる」問題が起きにくい。

しかもByteDanceはTikTokを作った会社なので、カット割りやアングル切替、ズームといった「映像の文法」を理解している感じがすごくあります。

生成された動画を見ると、AI動画にありがちな「カメラが微動だにしない棒立ち映像」じゃなくて、自然にアングルが変わるんですよ。

なぜHiggsfieldが最適な選択肢なのか

「どのプラットフォームでもSeedance 2.0が使えるなら、どれでもいいじゃん」——そう思うかもしれません。

ところがどっこい、Higgsfieldを推す理由は明確です。

ここが他のプラットフォームと一線を画すポイントです。

- 最大12個のアセット(画像9枚+動画3本+音声3本)を同時にアップロードできる

- アップロードしたファイルに自動で@ラベルが付与され、プロンプト内で直接参照できる

- Seedance 2.0以外にもSora 2、Kling 3.0、Veo 3.1など15以上のモデルを同一プラットフォーム上で切り替え可能

- Topaz Video AI(Topaz Labs製)の技術を統合したアップスケール機能が内蔵されており、生成後のアップスケール・フレームレート変換がワンクリック

要するに「動画生成から後処理まで、Higgsfieldの中だけで完結する」のが最大のメリットです。

日本ユーザーへの代替手段: 前述の通り、2026年4月時点でHiggsfieldのSeedance 2.0は日本から利用できません。

日本からすぐに試したい場合は、Dreamina(CapCut) か Runway 経由でSeedance 2.0を使うのがおすすめです。

プロンプトの書き方やタイムスタンプ手法など、この記事で紹介するテクニックはどちらのプラットフォームでもそのまま活用できます。

ではまず、使い始める前の登録手順から。これが意外とあっさり終わります。

Higgsfieldの登録とSeedance 2.0の初期設定

注意: Higgsfieldは2026年4月時点で日本からの利用に一部制限があります。

日本からアクセスする場合、一部機能が制限される可能性があることをご承知おきください。

Seedance 2.0の使い方は、思ったよりずっとシンプルです。

「なんか難しそう」と思うかもしれませんが、5分で終わります。

本当に5分なんだよ、これが。

アカウント作成からモデル選択まで

- Higgsfield公式サイトにアクセス

- 「Sign Up」からGoogleアカウントまたはメールアドレスで登録

- ダッシュボードに入ったら、動画生成画面でモデル選択メニューからSeedance 2.0を選択

- テキストプロンプト欄が表示されたら準備完了

ここまで、本当に5分かかりません。

無料クレジットと料金の仕組み

料金が心配なのはわかります。「試したいけど、いきなりお金かかるのは...」ってイライラしますよね。

安心してください。まず無料クレジットで試せます。

まずは無料クレジットでSeedance 2.0を試して、気に入ったらプランをアップグレードするのがおすすめです。

ちなみに、追加購入したクレジットパックは90日で失効します(月額プランのクレジットは月末リセット)。

買い溜めはしない方がいいです。

登録が済んだら、いよいよSeedance 2.0の核心部分に進みましょう。ここからが本当に面白いです。

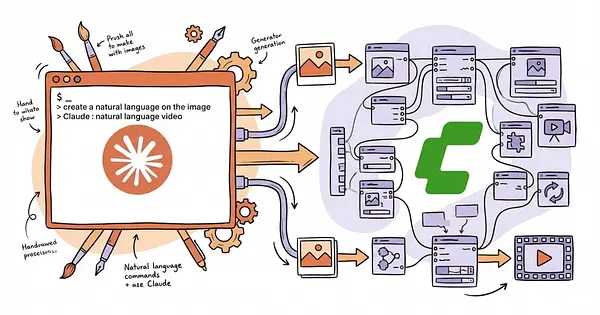

Seedance 2.0の@参照システムを理解する

ここからが真骨頂です。

他のAI動画ツールにはない、Higgsfield上での特殊機能が「@参照システム」。

これ何が嬉しいかっていうと、いわば映像監督が素材を指定しながら撮影指示を出すのと同じことができるんですよ。

「この俳優を使って、このBGMに乗せて、このロケ地で撮る」——そういう細かい指示が、AIに対してそのまま出せる。

これがあるだけで、動画の完成度が激変します。

@Image・@Video・@Audioの役割と使い分け

「@って何?」ってなりますよね。仕組みはシンプルです。

Higgsfieldに画像・動画・音声ファイルをアップロードすると、自動的に以下のラベルが振られます。

- @Image1, @Image2... : アップロードした画像(最大9枚)

- @Video1, @Video2... : アップロードした動画クリップ(最大3本、各15秒以内)

- @Audio1, @Audio2... : アップロードした音声ファイル(最大3本、各15秒以内)

で、これらをプロンプトの中で直接呼び出せます。

たとえば、こんな感じです。

A young woman (@Image1) walks through a neon-lit Tokyo street at night.

She turns toward the camera and speaks (@Audio1).

The scene transitions to a wide shot showing the full cityscape.「この画像の人物が、このセリフを喋りながら、こう動く」という指示が1つのプロンプトで書けるわけです。

従来のAI動画ツールだと「テキストだけで全部説明する」か「画像を1枚参照する」かの二択でしたが、Seedance 2.0は複数の素材を組み合わせて使える。

この違いは本当に大きいです。

自分の絵(画像生成AIの出力)を参照画像として使うコツ

「自分がMidjourneyで作ったキャラを動かせるの?」——そうです、まさにそれができます。

ここが自分みたいな画像生成AI勢にとって一番気になるところだと思います。

MidjourneyやStable Diffusionで作ったキャラ画像を@Image1としてアップロードし、Seedance 2.0に動かしてもらう。

ただし、いくつかコツがあります。

解像度は高めに: 参照画像の品質がそのまま出力品質に直結します。

最低でも1024x1024以上を推奨。

AIっぽさを消す: 画像生成AIの出力はどうしてもAIっぽい「ツルッとした質感」が出がちです。

参照画像にする前に、カラーグレーディングやテクスチャの追加を施すと動画の質がグッと上がります。

Mikoさんのガイドで紹介されていたテクニックですが、Nano Banana ProでJSON形式のプロンプトを使ってカラーグレーディングを指定する方法が特に有効です。

顔がはっきり見える画像を選ぶ: キャラクター一貫性を保つためには、正面〜やや斜めの顔がしっかり写った画像が最も安定します。

後ろ姿やシルエットだけの画像だと、動画内で顔が別人になるリスクが高いです。

@参照の仕組みがわかったところで、次がいよいよ本題です。プロンプトをどう書くか——これで動画のクオリティが天と地ほど変わります。

プロンプトの書き方マスター講座

Seedance 2.0のプロンプトの使い方は「普通の文章を書く」だけですが、ちゃんとした書き方があります。

「プロンプトって、なんとなく書けばいいんじゃないの?」——ってイライラするくらい、最初の出力がしょぼかったりしますよね。

自分もそうでした。

でも「センスじゃない、言語化だ」——これは画像生成でも動画生成でも同じ。

書き方ひとつで動画のクオリティは天と地ほど変わります。

基本構造:被写体+動作+環境+カメラ+スタイル

Seedance 2.0のプロンプトは、以下の5要素で組み立てるとうまくいきます。

- 被写体(Subject): 誰が/何が映るか

- 動作(Action): 何をしているか

- 環境(Environment): どこで、どんな背景か

- カメラ(Camera): アングル、動き、レンズ

- スタイル(Style): 映像のトーン、色味

具体例を出します。

Subject: A young anime-style girl with silver hair and blue eyes (@Image1)

Action: She slowly raises her hand and reaches toward a glowing butterfly

Environment: A misty forest with soft morning light filtering through the trees

Camera: Medium close-up, slow dolly forward, shallow depth of field

Style: Studio Ghibli-inspired, warm color palette, soft film grainこれが基本形です。

ここで重要なのは「具体的に書く」こと。

「女の子が森にいる」じゃダメで、「銀髪碧眼のアニメ調の少女が、朝もやの森で光る蝶に手を伸ばす」まで言語化する。

センスじゃない、言語化だ——という信条はここでも生きてきます。

タイムスタンプ手法で秒単位のシーン指定を行う方法

これ、正直鳥肌が立ちました。

Seedance 2.0の強力な機能のひとつが「タイムスタンプ手法」です。

15秒の動画を秒単位で区切って、各パートの内容を指定できます。

0-3s: Close-up of @Image1's face. She opens her eyes slowly.

Soft ambient music begins (@Audio1).

4-8s: Camera pulls back to reveal a full body shot.

She stands up from a wooden chair in a cozy cafe.

Warm afternoon light streams through the window.

9-12s: She walks toward the door, reaching for the handle.

Camera follows from behind in a tracking shot.

13-15s: Cut to exterior. She steps outside into bright sunlight.

Wide establishing shot of a European street.これ何が嬉しいかっていうと、映画のシナリオや絵コンテと同じ発想で動画を作れるんですよ。

たとえば「0〜3秒はクローズアップ、4〜8秒は引きのショット」みたいに、自分が映像監督になったつもりで指示を書く。

従来のAI動画ツールでは「こういう動画を作って」としか指定できなかったのが、Seedance 2.0では「この秒数でこのカメラアングルでこう動いて」まで指定できる。

想像してみてください。今まで「なんとなくいい感じに動かして」とお願いしていたのが、「3秒でクローズアップ、次の5秒で引いて、ラストはパン」と細かく指示できる。

この差は本当に革命的です。

コピペで使えるプロンプトテンプレート5選

ここが一番使える部分なんで、ちゃんと読んでほしいです。

そのまま使えるテンプレートを5パターン用意しました。

@Image1の部分は自分の画像に置き換えるだけで、コピペでOKです。

テンプレート1: キャラクターの振り向き(アニメ調)

A beautiful anime character (@Image1) stands on a rooftop at sunset.

0-5s: Back view of the character looking at the city skyline.

Wind gently blows through her hair. Golden hour lighting.

Camera: Static wide shot.

6-10s: She slowly turns around to face the camera.

A gentle smile appears on her face.

Camera: Slow zoom in to medium shot.

11-15s: Close-up of her face. She tilts her head slightly.

Cherry blossom petals drift across the frame.

Camera: Shallow depth of field, soft focus on background.

Style: Anime aesthetic, warm sunset tones, cinematic lighting.テンプレート2: 製品紹介風(実写調)

A sleek product (@Image1) sits on a marble surface in a minimalist studio.

0-4s: Dramatic reveal. Camera slowly orbits around the product.

Soft directional lighting creates elegant shadows.

Camera: 360-degree orbit, slow and smooth.

5-10s: Camera zooms into product details.

Highlights catch the surface texture.

Camera: Macro close-up with rack focus.

11-15s: Camera pulls back to show the full product in context.

A hand reaches in and picks it up.

Camera: Pull-back to medium shot.

Style: Commercial photography aesthetic, clean white studio, premium feel.テンプレート3: ファンタジー風景(イラスト動画化)

A vast fantasy landscape (@Image1) stretches across the frame.

0-5s: Slow aerial establishing shot flying over floating islands.

Clouds drift below. Volumetric god rays pierce through.

Camera: Drone-style forward movement.

6-10s: Camera descends toward a crystal lake on one of the islands.

Reflections shimmer on the water surface.

Camera: Descending crane shot.

11-15s: Camera skims across the lake surface, approaching a waterfall.

Mist rises from the impact. Rainbow appears in the spray.

Camera: Low-angle tracking shot across water.

Style: Fantasy art, vibrant saturated colors, epic scale, Makoto Shinkai inspired.テンプレート4: キャラクター会話(音声付き)

A character (@Image1) sits at a desk in a modern office.

Voice-over plays throughout (@Audio1).

0-5s: Medium shot. Character speaks directly to camera.

Natural hand gestures while explaining.

Camera: Slight handheld movement for authenticity.

6-10s: Cut to over-the-shoulder angle showing a computer screen.

Character points at something on the screen.

Camera: OTS shot, shallow DOF.

11-15s: Return to frontal medium shot. Character nods and smiles.

Leans back in chair with a satisfied expression.

Camera: Subtle push-in.

Style: Corporate video aesthetic, natural office lighting, professional tone.テンプレート5: ダイナミックアクション(短尺)

A warrior character (@Image1) stands in a dark arena.

0-3s: Dramatic low-angle shot. Character draws a sword.

Sparks fly as the blade catches light.

Camera: Low angle, slight dutch tilt.

4-8s: Quick cuts of combat moves. Slash, dodge, counter.

Motion blur on fast movements.

Camera: Rapid angle changes, action movie style.

9-12s: Slow-motion moment. Character leaps into the air.

Cape billows dramatically behind.

Camera: Slow-mo tracking shot from side.

13-15s: Landing impact. Dust cloud rises. Character poses.

Camera settles to eye-level static shot.

Camera: Quick zoom out to reveal full pose.

Style: Dark fantasy, dramatic chiaroscuro lighting, cinematic action movie.やりがちな失敗と修正のコツ

「なんか思ってたのと違う」ってなりませんでしたか。

大丈夫、みんな最初はそうです。

50回以上試行錯誤して気づいた「やりがちなミス」をまとめます。

失敗1: プロンプトが抽象的すぎる

NG: 「A girl dances happily」

OK: 「A girl with long black hair in a red dress performs a slow waltz spin. Her dress fans out as she rotates 360 degrees. Camera circles around her at waist height.」

具体的な動作、衣装、カメラの動きまで書くのが鉄則です。

失敗2: 1つのプロンプトに詰め込みすぎ

15秒で映画1本分のストーリーを語ろうとしないでください。

1クリップ = 1〜3シーンが限界です。

詰め込みすぎると、どのシーンも中途半端になります。

失敗3: カメラ指示がない

カメラ指示を省略すると、AIが「なんとなく」のアングルを選びます。

これが意外と良くない結果になりがちです。

「static wide shot」「slow dolly forward」「handheld close-up」など、毎回カメラの動きを明記しましょう。

失敗4: 英語プロンプトを避ける

Seedance 2.0は英語プロンプトの方が精度が高い傾向があります。

日本語でも動作しますが、特にカメラワークやスタイル指示は英語で書いた方が安定します。

プロンプトの英語化にはChatGPTやClaudeを活用すると楽です。

プロンプトの基本が固まったところで、次は「15秒」の制限を超える話です。ここからがさらに面白いんです。

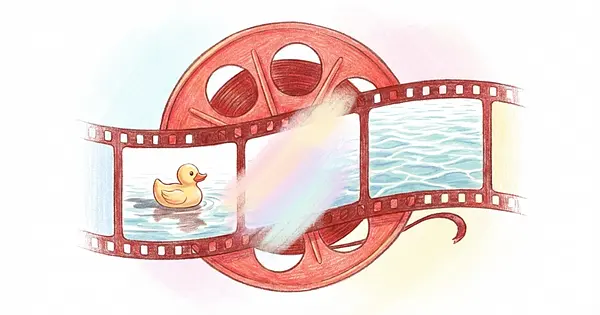

Seedance 2.0の動画を伸ばす・繋げるテクニック

15秒で終わりじゃありません。

「え、15秒だと短すぎる」ってイライラしますよね。でも大丈夫、ここからが応用編です。

15秒の壁を超える「ビデオ延長」の手順

Seedance 2.0の1回の生成は最大15秒ですが、「ビデオ延長」機能を使えば、さらに伸ばせます。

手順はシンプルです。

- 最初の15秒クリップを生成する

- 生成されたクリップをダウンロードし、Higgsfieldに@Video1として再アップロード

- プロンプトに「Continue from @Video1. Extend the scene...」と書いて、続きの内容を指示

- 新しい15秒クリップが生成される

- これを繰り返す

3回延長すれば約45〜60秒のコンテンツが作れます。

ポイントは「再生成より延長を優先する」こと。

最初の15秒が気に入らないからといって何度も再生成するよりも、まあまあの出力を延長して調整していく方が、結果的にクレジットも時間も節約できます。

2000文字制限を回避するCanva画像テクニック

「プロンプトが長すぎてエラーになった」って経験、たぶんします。

Seedance 2.0のプロンプトには2000〜2500文字程度のテキスト制限があります。

タイムスタンプ手法で詳細に指示を書くと、あっという間にこの制限に引っかかるんですよね。

そこで使えるのが「プロンプトの画像化」テクニックです。

たとえば、超詳細なプロンプトをCanvaで画像に変換してしまう方法があります。

- Canvaで新しいデザインを作成

- プロンプト全文をテキストとして配置(読みやすいフォント・サイズで)

- 画像として書き出し

- Higgsfieldに@Image参照としてアップロード

- テキストプロンプトには「Follow the detailed instructions in @Image2」と書く

Seedance 2.0は画像内のテキストを読み取れるため、文字制限を実質的に突破できます。

ただし、このテクニックはあくまで裏技的なものなので、まずは制限内で収まるプロンプトを書く練習をするのがおすすめです。

「実際にどんな動画が作れるの?」という気になる部分も、次のセクションで解説します。

Seedance 2.0で作れる動画の実例ギャラリー

「で、実際どんな動画が作れるの?」という声が聞こえてきそうなので、ユースケース別にまとめます。

ここ、具体的にイメージしながら読んでほしいです。

イラスト・アニメ調キャラの動画化

画像生成AIで作ったアニメ調のキャラクターをそのまま動画にできるのが、Seedance 2.0の大きな魅力です。

- キャラPV: キャラクターが振り向く、歩く、微笑む等のシンプルな動作

- ループアニメ: 髪や服が風になびく、瞬きする等の短いループ

- シーン動画: キャラクターが特定の場所で特定の行動をする一連のシーン

アニメ調を維持するには、プロンプトに「anime aesthetic」「2D animation style」「cel-shaded」等のスタイル指示を入れるのがコツです。

ポートレート・実写風のリアル動画

実写風の人物動画も得意分野です。

特にリップシンク(口の動きと音声の同期)の精度が高いので、「AIキャラクターが喋る」動画を作りたい場合はかなり強力。

ElevenLabsなどでボイスオーバーを先に作り、@Audio1として参照させれば、口の動きが音声に同期した動画が生成されます。

Mikoさんのガイドでも強調されていたのが「音声は映像より先に作る」という鉄則。

映像に後から音声を合わせるより、音声に合わせて映像を生成する方が自然な結果になります。

Seedance 2.0 よくある質問(FAQ)

Q. Seedance 2.0は日本語プロンプトで使えますか?

日本語でも動作しますが、カメラワークやスタイル指定は英語の方が精度が安定します。

ChatGPTやClaudeで日本語の指示を英語に変換してからSeedance 2.0に入力するのがおすすめです。

Q. 無料で使えますか?

Higgsfieldは新規登録時に無料クレジットが付与されます。

2026年4月時点では、ローンチ記念として期間限定の無制限生成特典も提供されていました。

まず無料クレジットで試して、使い続けるならプランを検討するのが現実的です。

Q. 日本からHiggsfieldのSeedance 2.0は使えますか?

2026年4月時点では、日本から直接利用できない制限があります。

代替手段として、Dreamina(CapCut)またはRunway経由でSeedance 2.0を使えます。

この記事のプロンプト設計やタイムスタンプ手法は、どちらのプラットフォームでも共通です。

Q. 1回の生成で何秒の動画が作れますか?

Seedance 2.0は1回の生成で最大15秒のクリップが作れます。

「ビデオ延長」機能を使えば同じキャラクターの一貫性を保ちながら動画を続けて伸ばせるので、実質45〜60秒程度のコンテンツを作ることも可能です。

Q. Seedance 2.0はKlingやRunwayと何が違いますか?

Seedance 2.0の最大の特徴はマルチモーダル入力(画像・動画・音声を同時参照)とキャラクター一貫性です。

「同じキャラが別カットで別人になる」問題が起きにくく、ネイティブ音声生成にも対応しています。

Klingは複雑なアクションや人体の動きに強く、Runwayは映像編集ワークフロー向けという棲み分けがあります。

Seedance 2.0 まとめ|まずは1本作ってみよう

Seedance 2.0×Higgsfieldの組み合わせは、AI画像生成を使っているクリエイターにとって「次のステップ」にぴったりのツールです。

この記事のポイントをおさらいします。

- 強みはマルチモーダル入力(画像+動画+音声の同時参照)とネイティブ音声生成、そしてキャラ一貫性

- Higgsfieldなら最大12アセットの@参照で、映像監督のようにきめ細かい指示が出せる

- プロンプトは「被写体+動作+環境+カメラ+スタイル」の5要素で組み立てる

- タイムスタンプ手法で秒単位のシーン設計ができる

- ビデオ延長で15秒の壁を超えられる

- 日本からはDreaminaやRunwayでSeedance 2.0を試せる。プロンプト設計の考え方は共通

まずはテキストプロンプトだけで1本、作ってみてください。

テンプレートをそのままコピペして@Image1に自分のキャラ画像を入れるだけでOKです。

5分で最初のクリップが完成します。

「あ、自分の絵が動いた」という瞬間は、画像生成AIとはまた違う感動があります。

そこから参照画像を追加して、タイムスタンプを使って、音声も付けて......と少しずつステップアップしていけば、気づいたら短編映像が作れるようになっています。

Seedance 2.0×Higgsfieldの使い方に慣れてきたら、ぜひ他のモデルとも組み合わせてみてください。

センスじゃない、言語化だ。

画像でも動画でも、その原則は変わりません。

💬 コメント

ログイン か 会員登録 するとコメントできます