こんにちは、プロンプト画伯です。

画像生成AIで作った絵を眺めて「これでゲーム作れたらな…」と思ったこと、ない?

僕はマジで何回もある。

Midjourneyで森のコンセプトアートを描いて、「この世界、Unityで歩き回りたいんだよな…」って溜息ついて閉じる、っていうのを何回繰り返したかわからない。

「絵は描ける。でも画像から3D生成するツールは難しすぎる」っていう人、相当多いと思う。

そんな絶望を一発でひっくり返してきたのが、今回紹介する image-blaster というツールなんだよね。

1枚の画像を放り込んで、Claude Codeに「blast it」って言うだけで、.glbの3Dメッシュ・.spzのガウシアンスプラット・.mp3の環境音が5分で生成される。

正直、最初に動画を見たときは「またデモ詐欺だろ」って疑ったんだけど、実際に試したら本当に動いた。

この記事を読めば、APIキーの取り方から実際の生成・Unityへの持ち込みまで、全工程コピペで再現できるようになる。

image-blasterは画像から3D環境をAIで自動生成するClaude Codeスキル

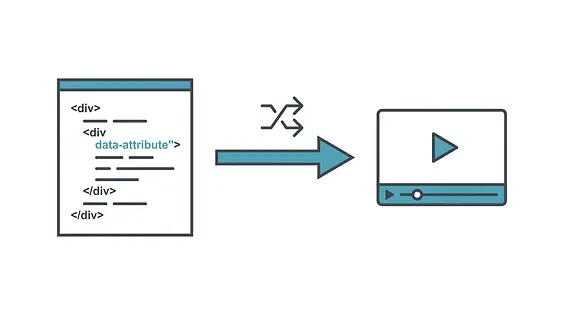

このツールを一言で説明すると「画像1枚を3Dゲーム環境一式に変換するClaude Code用のskillセット」になる。

ここでいうskillっていうのは、Claude Codeに「こういう手順で動いてね」っていうワークフローを教えるための仕組みのことで、要は専用のエージェント機能をプラグインみたいに追加できるんだよね。

公開されたのは2026年5月。

公開から数週間でGitHubスター2,000超え、MITライセンスで全部オープンソース、っていうとんでもない伸び方をしてる(2026年5月16日時点)。

1枚の画像から3Dワールド・メッシュ・SFXが揃う仕組み

中身がどうなってるかというと、裏で3つのAPIを連携させてる。

.mp3ガウシアンスプラットっていうのは、簡単に言うと「点群で空間を表現する3Dデータ」のこと。

メッシュみたいにポリゴンで形を作らずに、空間に光の粒を敷き詰めて見せる方式で、写真っぽいリアル感がめちゃくちゃ強い。

そして3Dメッシュは、UnityやBlenderで普通に扱える形式。

つまり、背景はリアル系のガウシアンスプラット、その中に置くオブジェクトはメッシュ、っていう役割分担になってる。

これが地味に賢くて、ゲームエンジンに持ち込んだときに「背景は重いけどキレイ、オブジェクトは軽くて触れる」っていう実用的な構成が最初から組まれるんだよね。

開発者Neilsonさんは何者か

image-blaster を作ったのは Neilson Koerner-Safrata さん。

肩書きは World Labs のデザインチーム。

World Labs っていうのは、AI研究で有名なFei-Fei Liさんが立ち上げた「空間知能(Spatial Intelligence)」を専門にしてるスタートアップで、ガウシアンスプラット系の生成AIではトップクラスの会社なんだよね。

つまり image-blaster は「World Labs の中の人が、自社APIを Claude Code で叩きやすくしたツール」っていう立ち位置で、信頼性も高い。

OSSとはいえ、本職のデザイナーが自分の作業フローを公開してくれてる、っていうのが個人的にめちゃくちゃアツい。

ツールの素性がわかったところで、次は実際に動かすまでの手順に入ろう。

image-blasterの使い方とAPIキー取得の手順

事前に必要なのは Claude Code のインストールだけ。

まだ入れてない人はこれを叩けば終わる。

curl -fsSL https://claude.ai/install.sh | bashWorld LabsとFALの2つのAPIキーを取る

image-blaster で必須なのは World Labs と FAL の2つのAPIキー。

ElevenLabs はオプションで、なくても静止画→3Dまでは動く。

World Labs のAPIキー取得は、公式サイトでアカウント作って、ダッシュボードから払い出すだけ。

料金は Marble 1.1 で環境生成1回あたり1,500クレジット(約180円)から。最初に5ドル分くらい入れておけば、何回も試せる範囲なんだよね。

FAL は Hunyuan 3D を含む各種AIモデルを叩けるホスティングサービスで、こちらもダッシュボードからAPIキーをコピーすればOK。

メッシュ1個あたり数十円〜数百円くらいで動くから、試すコストは想像してるより全然安い。

取得した2つのキーは、リポジトリの .env.example を .env にリネームして書き込めばClaude Codeが勝手に読み込んでくれる。

WORLD_LABS_API_KEY=wl_xxxxxxxxxxxx

FAL_KEY=fal_xxxxxxxxxxxxgit cloneしてClaude Codeで起動するまでのコピペ手順

APIキーが揃ったら、あとは3行で終わる。

git clone https://github.com/neilsonnn/image-blaster

cd image-blaster

claude最後の claude コマンドで Claude Code が起動して、リポジトリ内のskill定義を勝手に読み込んでくれる。

ここまで体感5分くらい。

「本当にこれで動くの?」って疑いながら進めてたんだけど、ちゃんと動いた。

ちなみにディレクトリ構造はこんな感じになってる。

image-blaster/

├── input/ ← ここに画像を置く

├── output/ ← 生成結果がここに溜まる

├── skills/ ← Claude Codeに読ませるskill定義

└── README.mdシンプル。

input/ に画像を入れて、Claude Codeに指示を出すだけ、っていう設計が美しい。

セットアップはこれだけ。次がいよいよ実演パートで、ここからが本番だよ。

Midjourneyの画像から3D生成を実際に試してみた

僕が普段画像生成で使ってるMidjourneyで「moss-covered ancient forest, soft morning light, fantasy game environment」みたいなプロンプトで森の絵を1枚作って、それを input/ フォルダに放り込んだ。

ファイル名は forest.png にしておいた。

ファイル名は何でもいいんだけど、出力時のフォルダ名に使われるから、自分でわかる名前にしとくのが吉。

元画像を input/ に置いて「blast it」と指示するだけ

画像を置いたら、Claude Codeにこう打つだけ。

blast it and confirm each step with meこれだけ。

「センスじゃない、言語化だ」がモットーの僕からすると、この一行のシンプルさが本気で美しい。

confirm each step を付けると、各ステップ(環境生成 → メッシュ抽出 → SFX生成)の前にClaudeが「これでいいですか?」って聞いてくれる。

僕みたいに最初の1回は中身を確認したい人にはこの指示が必須。

慣れたら just blast it, no confirmation で一気通貫もできる。

5分後に出力された.glb・.spz・.mp3の中身を確認

実際に走らせると、Claude Code が裏で順番にAPIを叩いていく。

ターミナル側にこんな感じのログが流れる。

[1/3] World Labs Marble: generating environment from forest.png ...

[2/3] Hunyuan 3D via FAL: extracting objects (3 detected) ...

[3/3] ElevenLabs SFX: generating ambient audio (forest, morning) ...待つこと約5分。

output/forest/ の中に、こういう感じでファイルが揃った。

output/forest/

├── environment.spz ← ガウシアンスプラットの森

├── objects/

│ ├── tree_01.glb ← 立体メッシュの木

│ ├── rock_01.glb ← 苔むした岩

│ └── log_01.glb ← 倒木

├── audio/

│ ├── ambient.mp3 ← 鳥の声・風・水音

│ └── footsteps.mp3 ← 落ち葉を踏む音

└── manifest.json ← 各ファイルの座標・物理設定ここで一番感動したのが manifest.json。

中を開いたとき、正直「え、ここまで入ってるの?」ってなった。

各オブジェクトの座標・回転・物理コライダーの種類まで全部記録されてるんだよね。

つまり、Unityに持ち込むときに「この木はここに、この岩はここに、当たり判定はこれで」って情報を全部持ってる状態で吐き出してくれる。

これがあるおかげで、後工程の3D配置作業がほぼゼロになる。

正直、ここがこのツール最大のキラーポイントだと思ってる。

ちなみに、最初に試したときは森じゃなくて夜の街のイラストをblastしたんだけど、看板の文字がぐにゃぐにゃに崩れて完全に異世界の異言語になった。

これはこれで味があるんだけど、文字が含まれる画像は苦手っぽい、っていうのは覚えておいたほうがいい。

生成まで動いたら、次はゲームエンジンに持ち込む手順。ここまでやってはじめて「画像→3Dゲーム」が本当につながる。

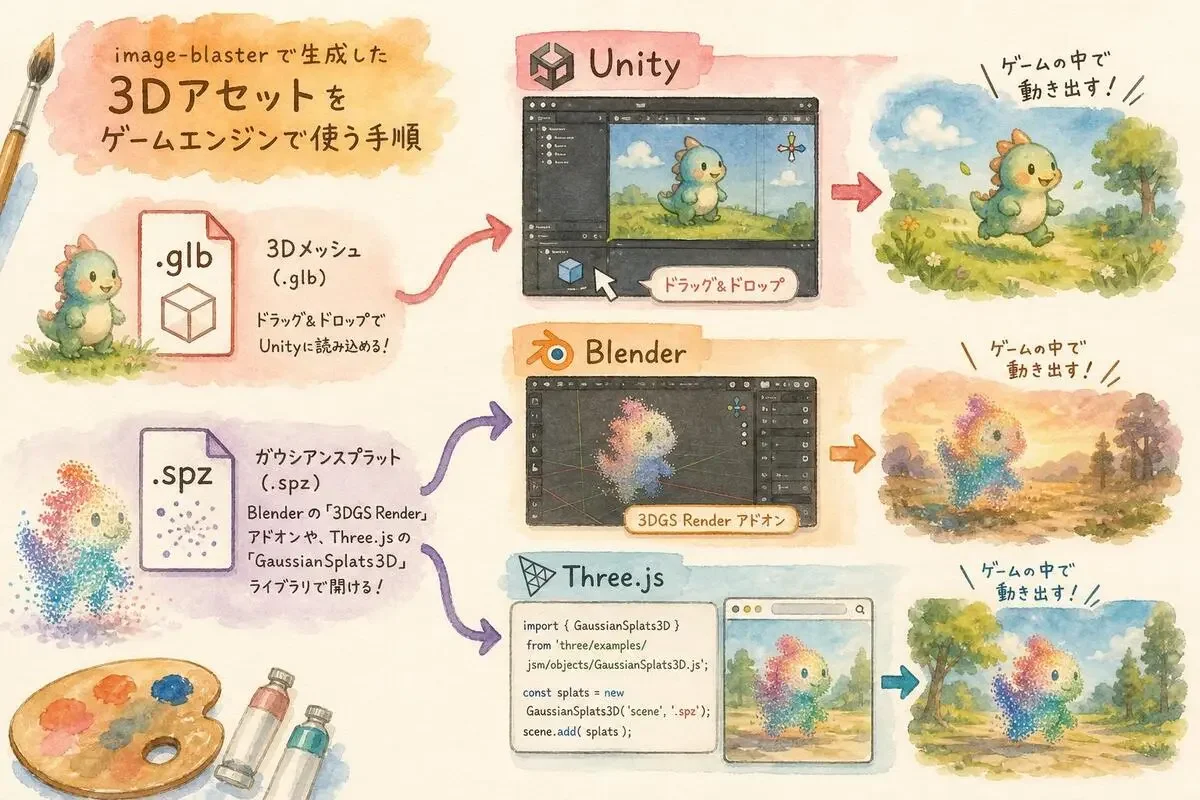

生成した3DアセットをUnity・Blender・Three.jsで使う方法

出力したファイルをどう活用するか、っていうところまで書いておく。

Unityに.glbをドラッグ&ドロップする最短手順

Unity は com.unity.cloud.gltfast(glTFast)パッケージを Package Manager から追加すれば .glb を読み込めるようになる。

パッケージを入れたら、output/forest/objects/ の中身を Assets フォルダにドラッグ&ドロップするだけで、テクスチャ付きのモデルとして取り込める。

manifest.json を読むエディタスクリプトを自分で書けば、座標まで自動で配置できる。座標・回転・スケールがJSONに揃ってるから、20〜30行のスクリプトで済む話なんだよね。

ガウシアンスプラットの .spz は、Unityの公式パッケージだとまだ標準対応してないんだけど、Aras-p/UnityGaussianSplatting のような外部パッケージを入れれば再生できる(Unity公式の対応も時間の問題かなと見てる)。

ガウシアンスプラット(.spz)をBlender・Three.jsで開く

Blenderの場合は、3DGS Render系のアドオンを入れれば .spz を直接インポートできる。

ガウシアンスプラットは編集できる対象じゃないけど、メッシュと並べて配置確認するくらいなら十分使える。

Three.js でウェブ上に表示したいなら、mkkellogg/GaussianSplats3D を使うのが一番ラクだった(このライブラリは現在メンテナンス終了アナウンス済み。World Labs公式の後継ライブラリ Spark への移行も視野に入れておくと安心)。

import * as GaussianSplats3D from '@mkkellogg/gaussian-splats-3d';

const viewer = new GaussianSplats3D.Viewer({

cameraUp: [0, 1, 0],

initialCameraPosition: [0, 1, 5],

});

viewer.addSplatScene('./environment.spz').then(() => {

viewer.start();

});これだけでブラウザに3D森が表示される。

最初にこれを動かしたとき、自分のMidjourney絵がブラウザの中で歩き回れる空間になってて、ちょっと震えたんだよね。

ここまで読んで「他のツールとどう違うの?」が気になってる人も多いと思う。次でそこを整理する。

Meshy・Tripo AI・Luma Genieとの違い

「他にも3D生成AIあるよね?」って思った人向けに、ちゃんと比較しておく。

要は、Meshy・Tripo・Luma は「3Dモデル1個」を作るツールで、image-blaster は「3D環境一式」をパッケージで作るツール、っていう住み分けになる。

個別の3Dアセットを高品質に作りたいなら Meshy か Tripo。

ゲーム1ステージ分の環境を素早くプロトタイプしたいならこちら。

この使い分けでだいたい正解だと思う。

ちなみに、本ツールはオブジェクト抽出にHunyuan 3Dを使ってるけど、Meshyほどの精密さは出ない。

そこは「一気通貫の便利さ」と「個別品質」のトレードオフだと割り切ってる。

強みと弱みが整理できたところで、最後にフェアな限界の話もしておく。

image-blasterの限界と今後どう使うか

ここまで褒めまくってきたから、フェアに限界も書いておく。

実際に何度か試して感じた弱点が3つある。

単一視点の壁——画像にない部分は崩れる

これが最大の制約。

入力画像は1枚なので、画像に写ってない部分(カメラの裏側、空の上、視野外)はAIが推測で埋めるしかない。

森のイラストなら裏側もそれっぽくなるけど、「特定の建物の正面」みたいな画像をblastすると、建物の裏側が大体崩れる。

このあたりはHacker Newsでも一番指摘されてた点なんだよね。

回避策としては「俯瞰視点の画像を使う」「広い空間を写した画像を使う」あたりが効く。

ElevenLabs SFXの精度と活用のコツ

音は正直、現状では「BGM下敷き」レベル。

足音や水音はそれっぽいけど、ループ感が強くてゲーム本番には差し替えが必要。

ただプロトタイプ段階で「とりあえず空気感ある音が鳴る」状態を5分で作れるのは本当に強い。

商品版に持っていくときは別途音響制作するつもりで、開発初期の手触り確認には完全にアリ。

ゲームに組み込む前に必要な後処理

Unity に持っていったあと、まだやることはある。

- ガウシアンスプラットの容量削減(重いとモバイル端末で動かない)

- メッシュのLOD設定(遠景用の軽量版を作る)

- 衝突判定の調整(自動生成だと微妙にズレることがある)

- ライティングの再設定(生成時の光と現場の光が違う場合)

このあたりは「自動生成された下地を、手で仕上げる」工程で、このskillsetだけでは完結しない。

それでも、ゼロから3D環境を作る労力に比べたら90%は省けてる、っていう体感。

つまり、これは「完成品を作るツール」じゃなくて「プロトタイプを爆速で作るツール」として捉えるのが正解なんだよね。

ハッカソンの48時間で1ステージ作る、とか、クライアントへの提案で「こういう世界観です」って動くデモを見せる、みたいな用途に最強。

まとめ:image-blasterで画像から3D生成AIを体験しよう

image-blaster は、画像生成AIで作ったコンセプトアートを、5分で歩き回れる3D空間に変換できるClaude Code用のskillセット。

仕組みは World Labs Marble・Hunyuan 3D(FAL経由)・ElevenLabs SFXの組み合わせで、.spz・.glb・.mp3 がワンコマンドで揃う。

必要なのは World Labs と FAL のAPIキー2つだけで、初期投資もほぼゼロ。

「画像生成は『センス』じゃなく『言語化スキル』」っていう僕の主張をずっと言ってきたけど、image-blaster はその先の世界をくれた。

絵を言葉で生み出せる人は、3D空間も言葉で生み出せる、っていう新しい時代。

正直、画像生成AIをやってる人が3Dに踏み出さないのはもったいなさすぎる。

このツールがあれば、Blenderの分厚いマニュアルを読まなくても、自分のMidjourney絵を歩き回れる空間に変えられる。

まずは git clone して、自分が一番気に入ってる生成画像1枚をblastしてみてほしい。

5分後、画面の中を自分の世界が歩き回ってる感動、味わってみる価値あるよ。

💬 コメント

ログイン か 会員登録 するとコメントできます