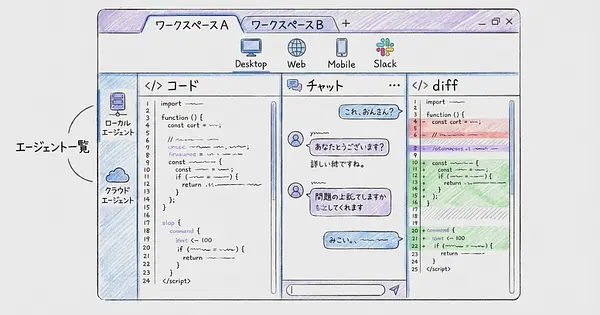

10年以上Railsを書いてきましたが、今はClaude Codeを使って「コードを書かない開発」を実践しています。

ChatGPT、Gemini、Claudeを毎日使い倒しているんですが、最近Xで見かけたある投稿が、自分のAIの使い方を根本から見直すきっかけになりました。

「AIへの質問の仕方を変えるだけで、回答の質がここまで変わるのか」と。

今回は、57万表示を集めたバズツイートをきっかけに、ChatGPT・Gemini・Claudeへの「質問設計」の本質について書いていきます。

はじめに:AIに何を聞いても「一般的な回答」しか返ってこない理由

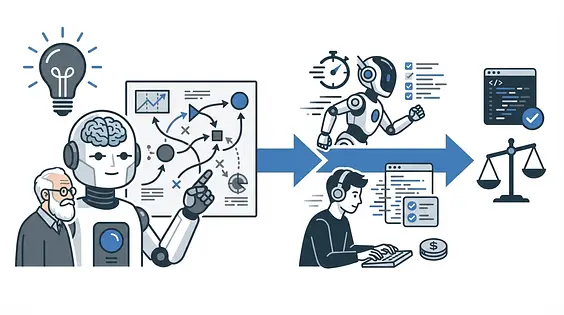

「検索エンジンとして使うAI」と「アナリストとして使うAI」の違い

「ChatGPTに聞いたけど、ググった方が早かった」

こんな経験、ありませんか。

自分もありました。

「それ、もう知ってるんだけど...」という回答が返ってくる時期が、正直けっこう長かったんです。

でもこれ、AIの性能の問題じゃなかったんですよ。

多くの人がAIを「高性能な検索エンジン」として使っています。

「〇〇のやり方を教えて」「〇〇とは何?」という質問ですね。

この使い方だと、AIは学習データの中から最も一般的で無難な回答を返します。

当然、ネットで検索した結果と大差ありません。

一方で、AIを「アナリスト」として使う人がいます。

「このデータの中で異常なパターンを見つけて」「この市場で実際に利益を出している人の行動パターンを分析して」という聞き方です。

同じAIでも、質問の角度を変えるだけで、まるで別のツールになります。

ここ、ちょっと注目してください。

「同じAI、同じテーマ、でも質問の仕方だけを変える」——これだけで回答の景色が変わるんです。

57万表示を集めたMIT留学生のエピソード

先日、Xで57万表示を超えるバズツイートがありました。

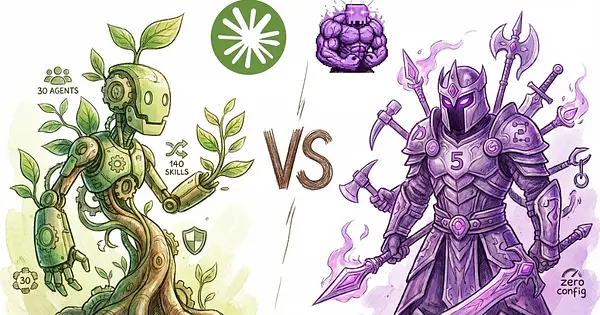

MIT(マサチューセッツ工科大学)の中国人留学生が、ChatGPT・Gemini・Claudeの3つのAIに同じテーマで質問を投げた、という内容です。

(スペイン語ですがxの機能で翻訳可能です)

テーマは「アジアとアメリカの時差を利用して、どうやってお金を稼げばいいか?」。

結果が面白かったんです。

- ChatGPT:外国為替(Forex)の取引時間の違いと、国際的なフリーランスの仕事を説明

- Gemini:アメリカに住みながら、アジアの企業向けにリモートワークすることを提案

この留学生の感想はこうでした。

「両方のタブを閉じた。100回聞いた標準的な回答だった」と。

ところが、次にClaudeを開いて質問の仕方を変えたところ、全く違う回答が返ってきた。

この「質問の仕方を変えた」という部分が、今回の記事のキモです。

ちなみにこの投稿は、予測市場アグリゲーター「fireplace.gg」(PolymarketやKalshiなど複数の予測市場を束ねたプラットフォーム)のプロモーション投稿と見られます。

この点は頭に入れておく必要があります。

ただ、それを差し引いても「質問設計で回答が変わる」という本質的な指摘は、自分の実体験と完全に一致していました。

では実際に、どんな質問をしたのか。次のセクションで見てみましょう。

ChatGPT・Gemini・Claudeに「同じテーマ」を聞いてみた

How型プロンプト:「時差を利用して稼ぐ方法は?」

まず、元ネタと同じ「How型」の質問を見てみましょう。

アジアとアメリカの時差を利用して、お金を稼ぐ方法を教えてください。これは典型的な「How型」の質問です。

「どうやって〇〇するか」を直接聞いています。

この質問に対して、ChatGPTとGeminiは以下のような回答を返しました。

- 外国為替(FX)で、東京市場とNY市場の時間差を利用する

- アジア圏のクライアント向けにフリーランスで働く

- 越境ECで時差を活かして仕入れ・販売する

- オンライン英語講師として時差のある国の生徒に教える

正直、どれも「まあそうですよね」という回答です。

これは悪い回答ではありません。

正確で、実行可能で、安全な回答です。

でも「100回聞いた標準的な回答」というMIT留学生の感想も、よく分かります。

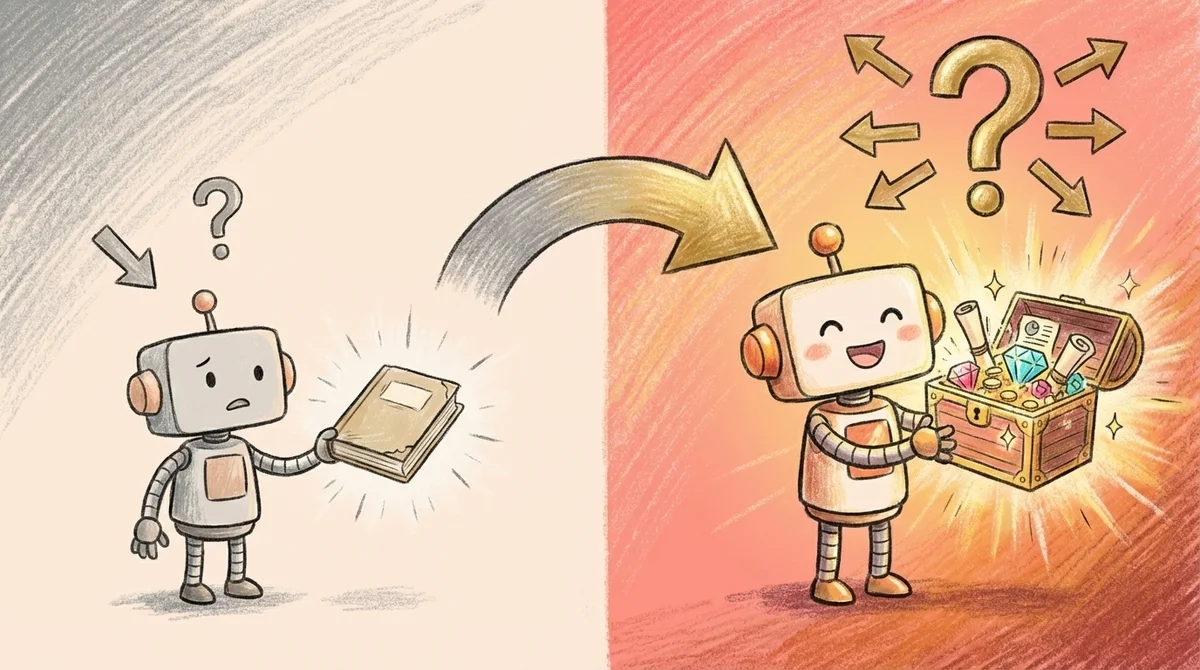

Who型プロンプト:「すでに稼いでいる人は誰か?」

次に、元ネタの留学生がClaudeに投げた質問です。

聞き方を変えています。

「アジアとアメリカの時差を利用してお金を稼ぐ方法」ではなく、

「すでにその方法で稼いでいる人たちは誰で、彼らを見つけることはできるか?」ここがポイントです。

「How(どうやるか)」ではなく「Who(誰がやっているか)」に質問の軸を変えています。

たったこれだけです。

「方法を教えて」から「やっている人を教えて」への言い換えだけで、AIが掘り出す情報の深さが変わるんですよ。

Claudeの回答は、ChatGPTやGeminiとは全く異質なものでした。

- 予測市場にタイムゾーンを利用したギャップが存在すること

- 元ネタツイートによると、アジアのブックメーカーのオッズがアメリカのプラットフォームより2〜3時間早く動くとされること

- この時間差を使ったアービトラージ(裁定取引)で利益を出しているトレーダーの存在

さらにClaudeに「北京の朝の時間帯だけに活動するデジタルウォレットを検索して」と依頼したところ、4,548件の取引で450万ドルの利益を上げているウォレットが見つかった、とされています。

3モデルのAI回答比較:何が違い、なぜ違うのか

ここで整理しましょう。

ここで重要なのは、「Claudeが優れている」という単純な結論ではありません。

元ネタのツイートでは、ChatGPTとGeminiにはHow型で聞き、ClaudeにはWho型で聞いています。

つまり質問の設計が違うのです。

もしChatGPTやGeminiにもWho型で聞いていたら、似たようなエッジの効いた回答が返ってきた可能性は十分あります。

このエピソードの本質は「どのAIが優れているか」ではなく、「質問の角度を変えるだけで、AIの回答品質が劇的に変わる」という事実です。

では、なぜ「Who」に変えると回答が変わるのか。その仕組みを次のセクションで説明します。

「How」から「Who」に変えるだけで回答が変わる── プロンプト設計の本質

なぜ「Who」で聞くと独自の回答が返ってくるのか

How型の質問は「方法」を求めています。

AIは最も確率の高い、つまり最も多くの人が知っている回答を返します。

学習データに頻出する情報が優先されるので、当然「一般的な回答」になります。

一方、Who型の質問は「人物や事例」を求めています。

これは検索空間が全く違うんですよ。

「どうやって稼ぐか」の回答パターンは限られていますが、「誰が稼いでいるか」の回答パターンは膨大です。

AIは学習データの中からより具体的な事例やパターンを掘り起こす必要があり、結果として「一般的ではない回答」が返ってきやすくなります。

これ、プログラミングに置き換えるとすごく分かりやすいです。

# How型(一般的な回答が返る)

「Railsアプリのパフォーマンスを改善する方法は?」

# Who型(具体的な事例が返る)

「Railsアプリで1万RPSを処理している事例はあるか?

そのエンジニアはどんなアーキテクチャを採用しているか?」前者は「N+1クエリを解消しましょう」「キャッシュを使いましょう」という教科書的な回答になります。

後者は「ShopifyがRailsで大規模トラフィックを処理するために採用したアプローチ」のような、具体的で実践的な情報が返ってきます。

Railsエンジニアなら「あ、分かる」ってなりますよね。

How型で聞くとStackOverflowの上位回答みたいなものが返ってくる。

Who型で聞くと、社内の一番詳しいシニアエンジニアが「あー、それならShopifyの事例が参考になるよ」と教えてくれる感じです。

「Who型質問」が有効な3つのシーン

Who型の質問設計が特に効果を発揮する場面を整理します。

1. ビジネスモデルの探索

# Before(How型)

「副業で月10万円稼ぐ方法は?」

# After(Who型)

「本業の年収を超える副業収入を得ているエンジニアは誰か?

彼らの収入源と、そこに到達するまでの軌跡は?」2. 技術的な問題解決

# Before(How型)

「マイクロサービスの設計パターンは?」

# After(Who型)

「マイクロサービスに移行して失敗した企業と、

そこからリカバリーした企業の事例は?

何が分岐点だったか?」3. 投資・市場分析

# Before(How型)

「2026年に成長が期待されるAI分野は?」

# After(Who型)

「2025年にAI分野で最も大きなリターンを得た

投資家やファンドは誰か?

彼らが2026年に注目しているセクターは?」どのケースも、How型は「教科書的な回答」、Who型は「実世界のデータに基づいた回答」を引き出しています。

「変換コスト」がほぼゼロなのに、回答の深さが変わるんですよ。

試さない手はないですよね。

Claudeが予測市場のアービトラージを答えた背景

元ネタに戻ります。

Claudeが予測市場のタイムゾーンアービトラージという具体的な事例を返した背景には、Who型の質問が「実際に存在する事例の検索」をAIに指示したことがあります。

予測市場(Polymarket、Kalshiなど)は、ここ数年で急成長している分野です。

アジアのブックメーカーとアメリカの予測市場プラットフォームの間にオッズの時間差が生じるという指摘があります。

ただし、「2〜3時間前」という具体的な数値は元ネタの広告投稿由来の情報で、一次ソースで検証できていません。

Who型で聞いたことで、Claudeはこのニッチだが実在する概念の周辺情報を引き出すことができた、というわけです。

繰り返しますが、このツイートはfireplace.ggのプロモーション投稿と見られます。

450万ドルの利益という数字の検証は難しく、そのまま鵜呑みにすべきではありません。

ただ、「質問の角度を変えることで、AIがニッチな事例を掘り出す」という現象自体は、自分の日常的な開発でも何度も体験しています。

では、ChatGPT・Gemini・Claudeそれぞれの特性を踏まえると、どう使い分けるのか。次で整理します。

AI別・プロンプトの質問設計と使い分け

ChatGPTの強みと「一般解」を返しやすい理由

ChatGPTは、最も広い学習データと最大のユーザーベースを持つモデルです。

強みは「バランスの良さ」と「汎用性」。

幅広いトピックに対して、正確で分かりやすい回答を返します。

逆に言えば、最大公約数的な回答になりやすい傾向があります。

ChatGPTが最も力を発揮する場面は以下です。

- 初めて触れるトピックの概要把握

- 文章の校正・リライト

- コードの説明やデバッグ(一般的なパターン)

- 多言語対応が必要なタスク

Geminiの特性とGoogle検索との連携

GeminiはGoogleの検索インフラとの統合が最大の特徴です。

リアルタイムの情報にアクセスできるため、「今日の最新ニュース」や「現在の市場データ」を含む質問には強い。

また、Google Workspaceとの連携により、自分のドキュメントやメールを参照した回答も可能です。

Geminiが力を発揮する場面はこちら。

- 最新の情報を含むリサーチ

- 自分のGoogle Workspace内のデータ分析

- 複数のソースを横断した情報収集

- 画像・動画を含むマルチモーダルな質問

Claudeが「エッジな回答」を返しやすいプロンプトの条件

Claudeの特徴は「深い推論」と「長文コンテキストの処理能力」です。

大量のコンテキストを与えた上での分析タスクや、複雑な推論が必要な質問で、他のモデルとは異質な回答を返すことがあります。

自分がClaude Codeで毎日開発していて感じるのは、「文脈を深く理解した上での提案」が得意だということです。

単に聞かれたことに答えるのではなく、質問の背景にある意図を汲み取って回答する傾向があります。

Claudeでエッジの効いた回答を引き出すコツは以下です。

- コンテキスト(背景情報)を十分に与える

- 「なぜその質問をしているのか」を明示する

- 具体的な制約条件を設定する

- Who型・Where型・When型で質問する

ただし、これはClaude固有の話ではありません。

どのAIでも、質問の精度を上げれば回答の質は上がります。

Claude、ChatGPT、Geminiそれぞれの特性を理解した上で、質問を設計することが大事です。

各モデルの特性が分かったところで、いよいよ実践的なフレームワークに入ります。

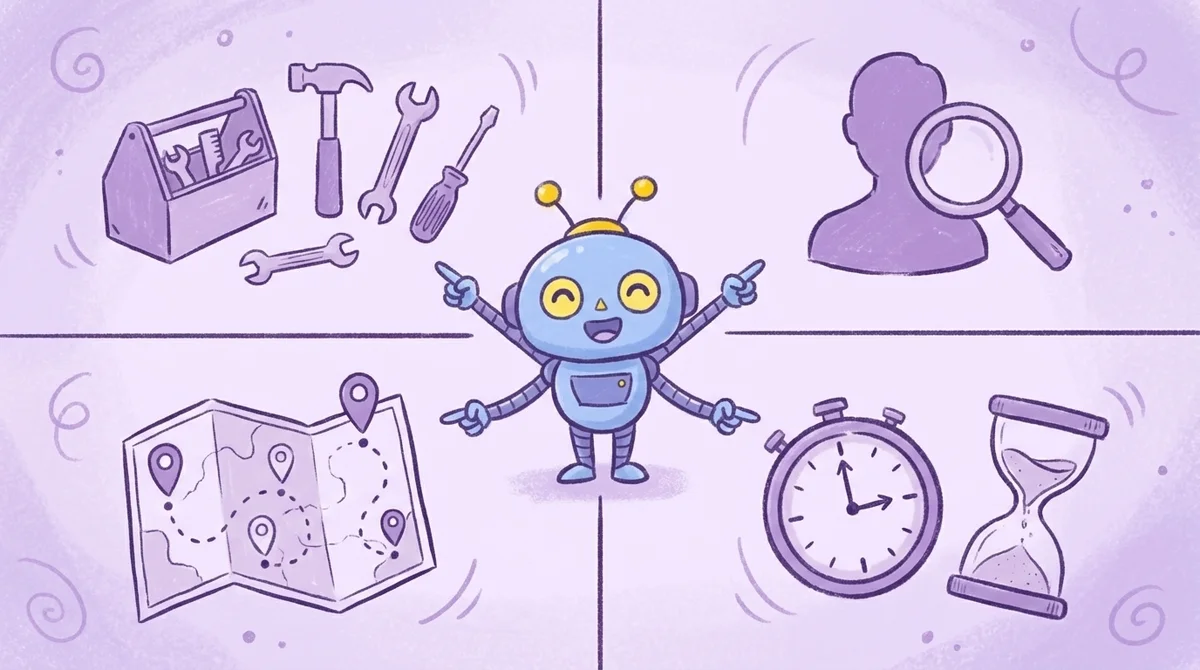

今日から使えるプロンプト設計の実践フレームワーク

「How / Who / Where / When」4軸で質問を再設計する

自分が普段使っている質問設計のフレームワークを紹介します。

同じテーマについて、4つの軸で質問を再構成する方法です。

How型だけで質問していると、AIは「教科書」になります。

4つの軸を使い分けることで、AIを「リサーチアナリスト」として活用できます。

これ、最初は「質問を考えるのが面倒くさい」と思うかもしれないんですけど、慣れると30秒もかかりません。

むしろ、How型で聞いて一般的な回答に時間を使う方がもったいないと感じるようになります。

実際に試すべきプロンプトの質問パターン5選(コピペ可)

すぐに使えるプロンプトパターンを5つ用意しました。

自分のテーマに置き換えてコピペしてください。

パターン1: Who型 - 実践者を探す

「[テーマ]」について、方法論ではなく実際の実践者を教えてください。

- その分野で成果を出している個人・企業・プロジェクトは?

- 彼らが採用している具体的なアプローチは?

- 公開されているデータや事例はありますか?パターン2: Where型 - 市場を探す

「[テーマ]」に関して、まだ競争が少ないニッチな市場や

プラットフォームを探しています。

- 大手が参入していないが需要がある領域は?

- その市場で実際に活動しているプレイヤーの規模感は?

- 参入障壁は何か?パターン3: When型 - タイミングを探す

「[テーマ]」の領域で、タイミングによって

結果が大きく変わる要因を分析してください。

- 時間帯、季節、イベントサイクルなどの時間的要素は?

- 早期参入者が得ている優位性は?

- 今がチャンスと言える根拠は?パターン4: Why型 - 失敗パターンを探す

「[テーマ]」で失敗した事例を教えてください。

- 失敗の主な原因パターンは?

- 成功者と失敗者の分岐点は何だったか?

- 失敗から回復した事例はあるか?パターン5: 複合型 - Who + When で最大化

「[テーマ]」について、以下の2軸で分析してください。

1. この分野で過去1年間に最も成果を出した人物・組織は誰か?

2. 彼らが成果を出した時期と、市場環境の関係は?

3. 同じ条件が再現される可能性があるタイミングはいつか?よくあるAIへの質問の失敗パターンと改善例

最後に、よくある失敗パターンと改善例をまとめます。

失敗1: 漠然としたHow型

# NG

「AIを使って業務効率化する方法は?」

# OK

「従業員50人規模のSaaS企業で、AIを導入して

カスタマーサポートの応答時間を50%削減した事例は?

どんなツールを、どの業務プロセスに適用したか?」失敗2: 答えが一つしかない質問

# NG

「Pythonのリスト内包表記の書き方は?」

# OK

「Python上級者がリスト内包表記の代わりに

あえてfor文を使う判断基準は?

可読性・パフォーマンス・保守性の観点から

実際のコードレビューで指摘される事例は?」失敗3: AIの回答を鵜呑みにする質問

# NG

「一番儲かる副業は何?」

# OK

「副業で年間100万円以上の収入を公開しているブログや

確定申告の事例を5つ探してください。

それぞれの初期投資額と損益分岐点までの期間も。」共通するポイントは、具体性と検証可能性です。

AIに「答え」を求めるのではなく、「調査」を依頼する感覚ですね。

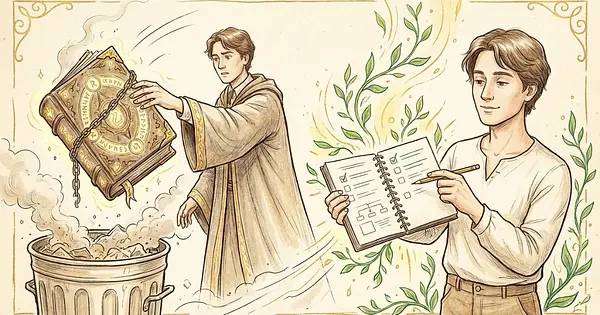

まとめ:AIの優劣より、問いの設計力を磨け

今回の話をまとめます。

MIT留学生のバズツイートから見えたのは、「ChatGPTよりClaudeの方が優れている」という話ではありませんでした。

質問を「How」から「Who」に変えるだけで、AIの回答品質が劇的に変わるという事実です。

AIは道具です。

ハンマーの性能を比較するより、釘をどこに打つかを考えた方が生産的です。

今日から試してほしいのは、たった一つのことです。

AIに質問するとき、「どうやって〇〇するか」と聞く前に、一度立ち止まってこう考えてみてください。

「この問いを、Who / Where / When に置き換えたらどうなるだろう?」

それだけで、AIから返ってくる回答の景色が変わるはずです。

自分もClaude Codeでの開発で、毎日この「質問設計」を意識しています。

コードを書く時間は減りましたが、質問を設計する時間は増えました。

そしてそれが、開発の質を確実に上げています。

AIの性能競争はこれからも続きます。

でも、どのモデルを使うにしても「問いの設計力」は普遍的なスキルです。

まずは次にAIに質問するとき、1秒だけ立ち止まって「Who型にできないか?」と考えてみてください。

それだけで、今日からAIの使い方が変わります。

💬 コメント

ログイン か 会員登録 するとコメントできます