正直、最初は「コマンドラインからComfyUIを操作する意味あるのかな」と半信半疑でした。

でも実際にやってみたら、カスタムノードの依存関係エラー、JSONワークフローの手動編集、画像→動画の手動引き渡し、VRAM管理——これ全部、Claude Codeに丸投げできたんですよ。

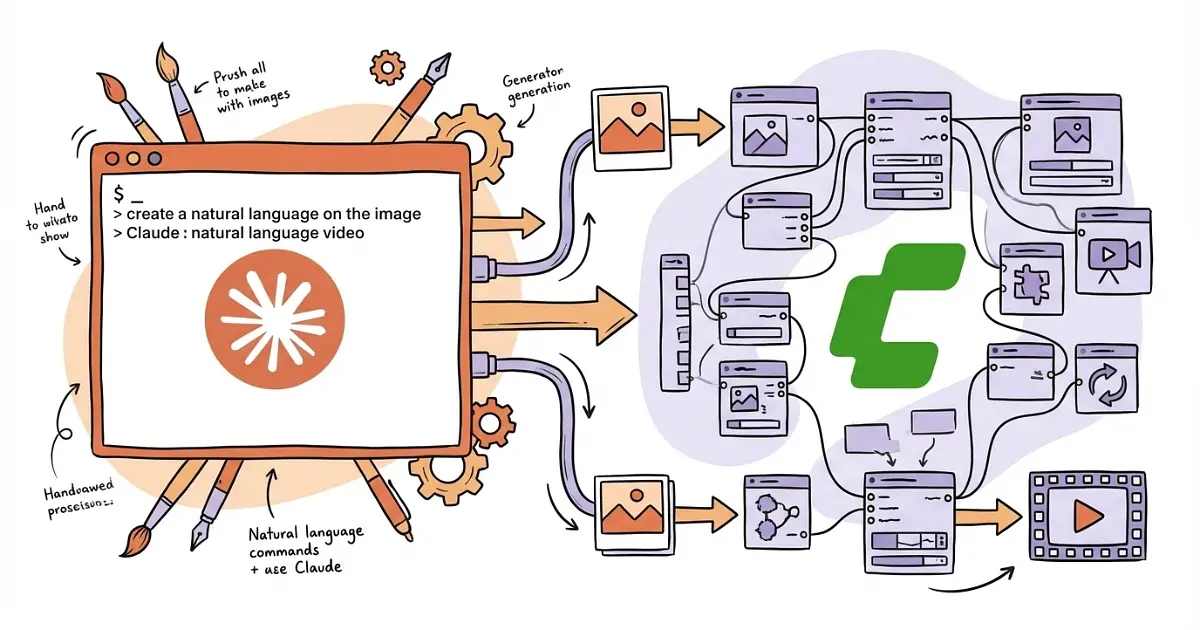

今回はClaude Code × ComfyUI自動化の仕組みからセットアップ、画像→動画パイプラインの自動引き渡しまで、エンジニア向けに実践的に解説していきます。

ComfyUIのワークフロー管理、こんな悩みありませんか

ComfyUIを使い始めたときのワクワク感、覚えてますか?

ノードをつないで自由にパイプラインが組める。

Stable Diffusion WebUIでは不可能だった柔軟さに感動した人も多いはずです。

でも、半年も使い込むと話が変わってくるんですよね。

カスタムノード依存で管理コストが増大する問題

ComfyUIの醍醐味はカスタムノードです。

コミュニティが開発した便利なノードを入れれば入れるほど、できることは増える。

でも同時に、こういう問題が積み上がっていきます。

- カスタムノードのバージョン違いでワークフローが動かない

missing nodesエラーが出たとき、どのリポジトリからインストールすればいいか分からない- アップデートしたら別のノードが壊れた

- ワークフローを人に共有したら「動かない」と言われた

1つ2つなら対処できますが、カスタムノードが20個、30個と増えてくると管理コストが爆発的に増えます。

自分も最初は「便利だから入れよう」と気軽にインストールしていたんですが、ある日ワークフローが動かなくなって半日デバッグした経験があります。

Pythonスクリプトを自前で書く方法の限界

「じゃあPythonでComfyUI APIを叩いて自動化すればいいじゃないか」と考えるのは自然な発想です。

実際、ComfyUIはローカルでREST APIを提供しているので、Pythonから/promptエンドポイントにJSONを投げれば画像生成はできます。

import json

import requests

# ComfyUI APIに直接JSONワークフローを投げる例

workflow = json.load(open("workflow.json"))

response = requests.post(

"http://127.0.0.1:8188/prompt",

json={"prompt": workflow}

)ただし、これを実用レベルにしようとすると壁にぶつかります。

- ワークフローのパラメータを変更するたびにJSONを手動で編集する必要がある

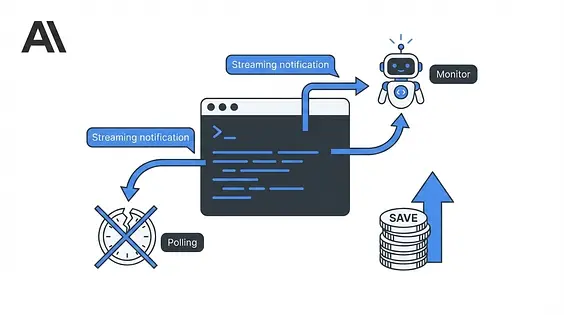

- WebSocketで生成完了を待ち受けるコードを書く必要がある

- エラーハンドリング、リトライ処理を自前で実装する必要がある

- ワークフローが変わるたびにスクリプトを書き直す必要がある

つまり「自動化するためのコード」自体のメンテナンスが新しい仕事になるわけです。

ここで登場するのがClaude Codeです。

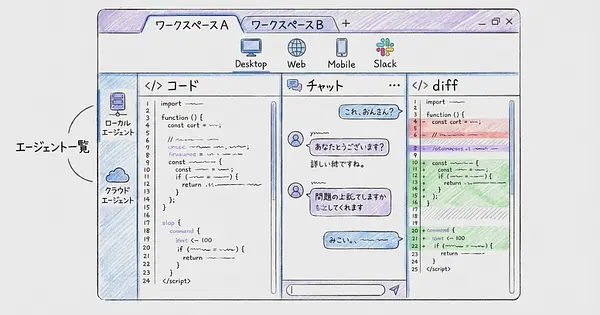

Claude CodeはComfyUIのJSON形式ワークフローを直接読み解き、パラメータの変更も、エラーハンドリングも、ワークフローの切り替えも、自然言語の指示だけで処理してくれます。

「それってどういう仕組みで動くの?」——次のセクションで仕組みを整理します。

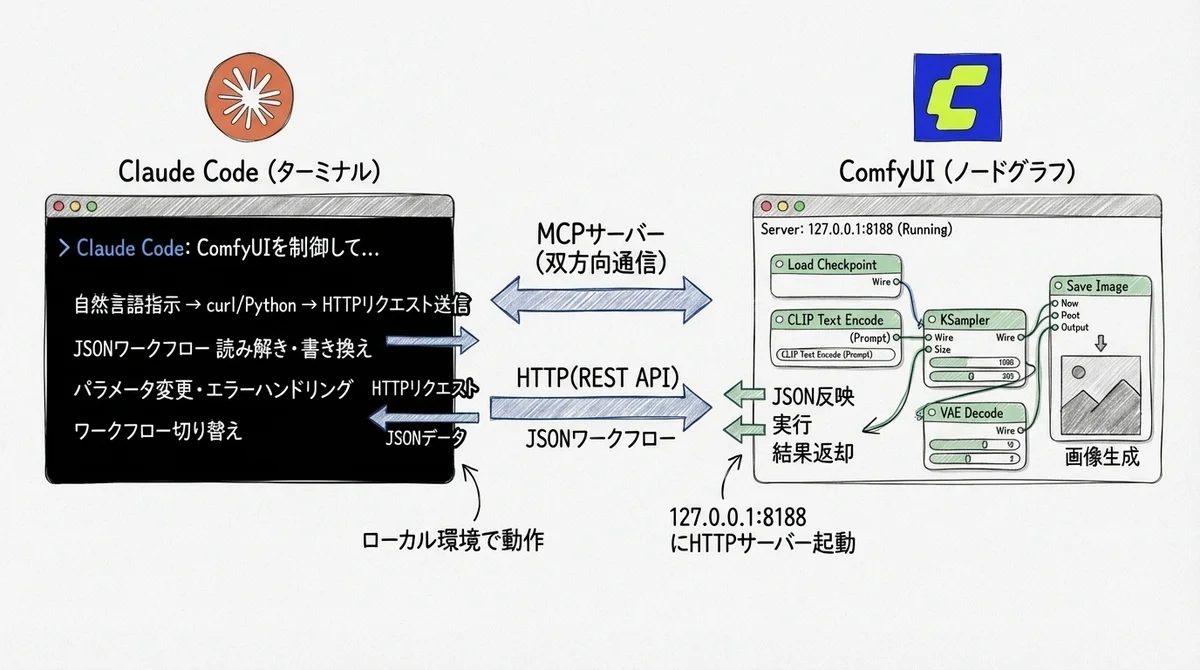

Claude CodeとComfyUI連携の仕組み

ここからが本題です。

Claude Codeがどうやってローカルで動いているComfyUIを制御するのか、仕組みを整理しましょう。

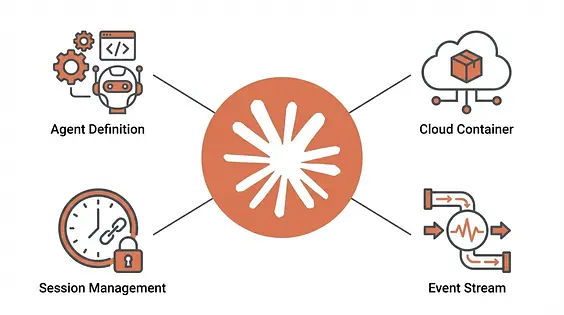

ローカルのComfyUIサーバーに直接アクセスする仕組み

ComfyUIは起動すると、デフォルトで127.0.0.1:8188(設定によっては8000番ポート)でHTTPサーバーを立ち上げます。

Claude Codeはターミナル上で動作するため、curlやPythonスクリプトを使ってこのローカルサーバーに直接HTTPリクエストを送れます。

つまり、こういう流れです。

- あなたがClaude Codeに「おしゃれな喫茶店でコーヒーを飲む日本の女性の画像を生成して」と指示する

- Claude Codeが適切な英語プロンプトを生成する

- ComfyUIのワークフローJSON内のプロンプトノードを書き換える

http://127.0.0.1:8188/promptにPOSTリクエストを送信する- WebSocketで生成完了を待ち受ける

- 出力画像のパスを取得して結果を報告する

ポイントは、Claude Codeがこの一連の処理を自分で考えて実行するということです。

事前にスクリプトを書いておく必要はありません。

JSON形式ワークフローをClaudeが読み解くメカニズム

ComfyUIのワークフローはJSON形式で保存されます。

ノード間のつながり、各ノードのパラメータ、使用するモデル名——すべてがJSON構造に記述されています。

{

"3": {

"class_type": "KSampler",

"inputs": {

"seed": 42,

"steps": 20,

"cfg": 7.0,

"sampler_name": "euler",

"scheduler": "normal",

"denoise": 1.0,

"model": ["4", 0],

"positive": ["6", 0],

"negative": ["7", 0],

"latent_image": ["5", 0]

}

}

}LLMにとってJSONの解析は得意分野です。

Claude Codeはこのワークフローを読み込んで、「どのノードがプロンプト入力か」「どのノードがモデル読み込みか」「出力はどこに保存されるか」を自動的に把握します。

実際にやると分かるんですが、ComfyUIで画像生成した後にClaude Codeに「直前に使ったWorkflowを把握してくれる?」と聞くだけで、ログデータからワークフロー構造を読み取ってくれます。

これが地味にすごいんですよ。

MCPサーバー経由 vs 直接API制御の違い

Claude CodeとComfyUIの連携方法は大きく2つあります。

方法1: 直接API制御(この記事で紹介する方法)

Claude Codeがcurlやpythonコマンドを使って、ComfyUIのREST APIに直接リクエストを送る方式です。

追加のセットアップが不要で、ComfyUIさえ起動していればすぐに使えます。

方法2: MCPサーバー経由

comfyui-mcpなどのMCPサーバーを立てて、Claude CodeからMCPプロトコル経由でComfyUIを操作する方式です。

MCPサーバーがComfyUI APIをラップしてくれるので、より構造化されたインターフェースが使えます。

ただし、MCPサーバーのインストールと設定が別途必要です。

個人的には、まず直接API制御で試してみて、運用が安定してきたらMCPサーバーの導入を検討する、というステップがおすすめです。

仕組みが分かったところで、次は「で、実際何がどう変わるのか」を先に見てもらいたいと思います。

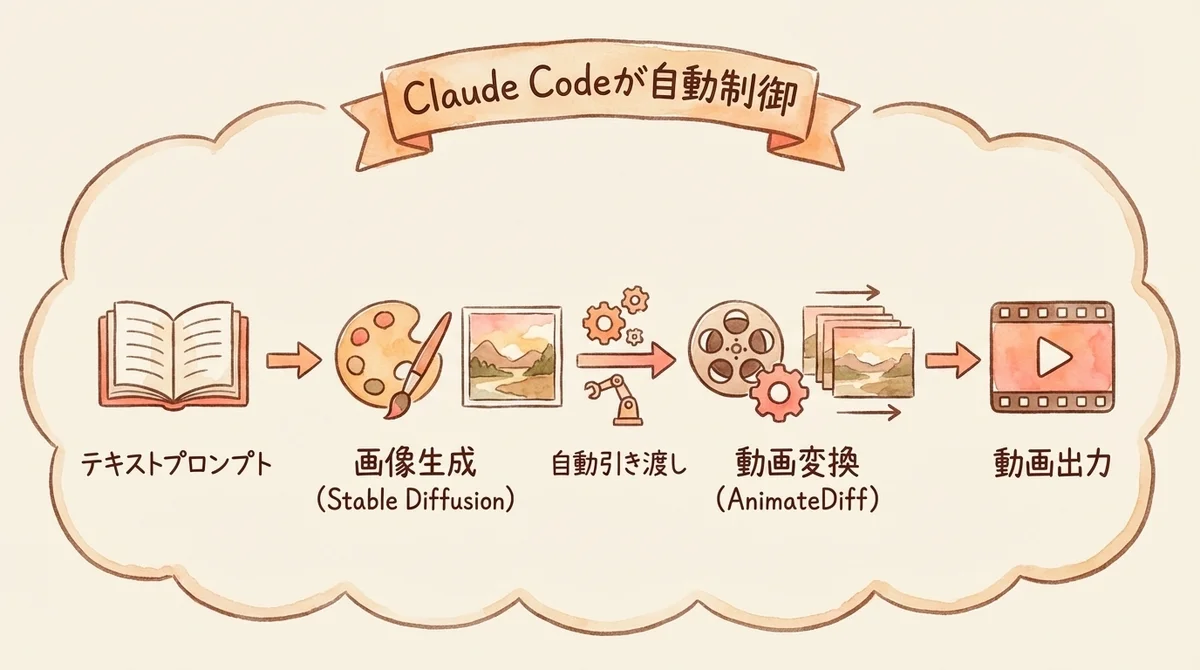

画像→動画パイプラインの自動引き渡し

ここが今回の記事の最大の差別化ポイントです。

ComfyUIの画像生成記事は山ほどあります。

でも「画像生成AIで作った画像を、そのまま別のワークフローの動画生成AIに引き渡して動画化する」——このパイプラインを自動で回す方法を解説した記事はほとんどありません。

画像生成後に動画ワークフローへ自動連携する仕組み

Claude Code × ComfyUIの真骨頂はここです。

通常、ComfyUIで画像→動画パイプラインを組むには以下の手順が必要です。

- 画像生成ワークフローで画像を生成する

- 出力ファイルパスを手動で確認する

- 動画生成ワークフローを開く

- 画像入力ノードに出力ファイルパスを手動で設定する

- 動画生成を実行する

手動で5ステップ。

ファイルパスを確認してコピペして、ワークフローを切り替えて、入力ノードを設定して……地味にめんどうですよね。

これをClaude Codeに任せると、こうなります。

先ほど生成した喫茶店の画像を使って、

カメラがゆっくりパンする3秒の動画を生成して。

LTX-2.3のワークフローを使って。一言です。

Claude Codeがやってくれること:

- 直前の画像生成結果のファイルパスを把握

- LTX-2.3(WhatDreamsCostのComfyUIカスタムノードを使用)のワークフローJSONを読み込み

- 画像入力ノードにファイルパスを設定

- motion_promptにカメラワーク指示を英語で記述

- 必要に応じてVRAMを確保するためにモデルをアンロード

- 動画生成を実行

- 出力パスを報告

手動なら15〜20分かかる作業が、1つの自然言語指示で完結します。

つまり「何を作るか」だけ考えればいい。「どうやって引き渡すか」の手間がまるごとなくなるんです。

LTX-2.3を使った動画生成例

具体的な動画生成の例を紹介します。

LTX-2.3は軽量ながら高品質な動画を生成できるモデルで、WhatDreamsCostが公開しているComfyUIカスタムノードを使うとワークフローとして利用できます。

Claude Codeへの指示例:

以下の条件で動画を生成して:

- 入力画像: 直前に生成した東京の夜景画像

- カメラワーク: ゆっくりとしたドリーイン(前進)

- 長さ: 3秒(24fps)

- スタイル: シネマティック、フィルムグレイン軽めClaude Codeはこれを受けて、ワークフロー内の各ノードパラメータを自動調整します。

フレーム数の計算(3秒 × 24fps = 72フレーム)、モーションプロンプトの英語化、品質パラメータの設定——全部自動です。

もう1つ面白い例として、Multiple Angles LoRAを使った複数アングル生成があります。

Qwen-Image-Edit-2511 + Multiple Angles LoRAを組み合わせると、1枚の画像から複数のカメラアングルを生成できます。

Claude Codeに「この画像を使って、正面・斜め45度・俯瞰の3アングルを生成して、それぞれで動画化して」と指示すれば、3つの画像生成→3つの動画生成まで一気通貫で実行してくれます。

「え、それだけで3パターンの動画が揃うの?」って最初は半信半疑でしたが、本当に一発で通るんですよ。

VRAM制約の自動管理——モデルのロード/アンロード戦略

画像→動画パイプラインで最大のボトルネックはVRAMです。

画像生成モデル(例: Z-Image Turbo)と動画生成モデル(例: LTX-2.3)を同時にVRAMに載せるのは、12GBのGPUでは厳しい場合が多い。

手動で対処する場合、ComfyUIの設定で--lowvramフラグを使ったり、ワークフロー内でモデルを明示的にアンロードするノードを配置したりする必要があります。

Claude Codeはこのあたりを自動で判断してくれます。

具体的には以下のような制御を行います。

- 画像生成ワークフロー実行前に、ComfyUIの

/freeエンドポイントでVRAMを解放 - 画像生成を実行

- 画像生成完了後、再度VRAMを解放

- 動画生成ワークフローを投入

# Claude Codeが実行するVRAM解放コマンド例

curl -X POST http://127.0.0.1:8188/free \

-H "Content-Type: application/json" \

-d '{"unload_models": true, "free_memory": true}'ComfyUI v0.16以降のDynamic VRAM管理と組み合わせることで、12GBのGPUでも画像→動画パイプラインを安定して回せます。

なお、Dynamic VRAM管理はWSL2環境では利用できないため、Windowsで使う場合はネイティブ環境での実行を推奨します。

自分の環境(RTX 4070 Ti、12GB VRAM)では、画像生成→VRAM解放→動画生成のサイクルを問題なく回せています。

実際に動くイメージが掴めたところで、次はセットアップ手順を見ていきましょう。

セットアップ手順——Claude CodeとComfyUIを接続する

ここからは実際に手を動かすパートです。

必要な環境と前提条件

Claude Code × ComfyUI自動化に必要な環境は以下の通りです。

ハードウェア

- GPU: NVIDIA RTX 3060(VRAM 12GB)以上を推奨

- 画像生成だけなら8GBでも動くが、画像→動画パイプラインを回すなら12GB以上が必要

- RAM: 16GB以上

ソフトウェア

- ComfyUI: 最新版(v0.16以降を推奨、Dynamic VRAM管理対応)

- Claude Code: Anthropic CLIからインストール

- Python 3.10以上(ComfyUIの動作要件)

- Node.js(Claude Codeの動作要件。公式の推奨バージョンを確認してください)

OS

- Windows、macOS、Linuxいずれも対応

- WindowsはWSL2環境での利用を推奨(ただしDynamic VRAM管理はWSL2では利用不可)

Anthropic Maxプランが必要な理由と料金比較

ここは正直に書きます。

Claude Code × ComfyUI自動化を本格的にやるなら、Anthropic Maxプラン($100/月) が事実上必要です。

Proプラン($20/月)でもClaude Codeは使えます。

ただし、ComfyUIのワークフロー解析やAPI制御には長いコンテキストが必要で、Proプランのレートリミットだと途中で止まることが多いんですよ。

自分の体感では、Max 5x($100/月)で画像→動画パイプラインを1日10〜20回程度回す分には問題ないレベルです。

接続確認の手順

まず、ComfyUIが正常に起動しているか確認します。

# ComfyUIの起動(ポート8188で起動するのがデフォルト)

cd /path/to/ComfyUI

python main.py --listen 127.0.0.1 --port 8188起動したら、Claude Codeから接続確認します。

Claude Codeのターミナルで以下のように指示するだけです。

ComfyUIがhttp://127.0.0.1:8188で起動しています。

接続確認して、利用可能なモデル一覧を取得してください。Claude Codeは内部で以下のようなコマンドを実行して確認してくれます。

# Claude Codeが実行するコマンド例

curl -s http://127.0.0.1:8188/system_stats | python3 -m json.tool

curl -s http://127.0.0.1:8188/object_info | python3 -c "

import sys, json

data = json.load(sys.stdin)

print(f'利用可能なノード数: {len(data)}')

"system_statsが返ってきて、ノード一覧が取得できれば接続成功です。

ここまでくれば、あとは自然言語で指示するだけで画像生成が始まります。

接続ができたら、次はプロンプト最適化の自動化に進みましょう。

プロンプト自動最適化——Claudeにプロンプトガイドを調べさせる

ComfyUIで画像生成するとき、地味に面倒なのがプロンプトの書き方です。

使うモデル(チェックポイント)によってプロンプトの書き方が全然違う。

SDXL系、FLUX系、SD3系——それぞれに最適なプロンプト構造があって、全部覚えるのは非現実的です。

ここでClaude Codeの「調べて学習する」能力が活きてきます。

最適なプロンプトをClaudeが自動生成するフロー

やり方はシンプルです。

ComfyUIで一度画像を生成したあと、Claude Codeにこう指示します。

直前に使ったWorkflowを把握してくれる?

そのモデルに最適なプロンプトの書き方をWeb検索で調べて、

ガイドラインをMarkdownファイルにまとめてほしい。Claude Codeは以下の流れで動きます。

- ComfyUIのログからワークフロー情報を取得

- 使用モデル名を特定(例: Z-Image Turbo)

- WebSearchでそのモデルのプロンプトガイドやGitHub上のコミュニティ資料を検索

- 最適なプロンプト構造をMarkdownにまとめて保存

新清士氏の記事で紹介されていた推奨プロンプト構造は以下の形式です。

[構図・被写体] + [年齢・外見] + [服装] + [背景] + [照明] + [雰囲気] + [スタイル] + [技術指定] + [制約]Claude Codeにこの構造を伝えておけば、日本語で「おしゃれな喫茶店でコーヒーを飲む若い女性」と指示するだけで、以下のような英語プロンプトに変換してくれます。

A young Japanese woman in her mid-20s drinking coffee at a stylish retro

cafe, wearing a cream knit sweater, warm ambient lighting from pendant lamps,

cozy atmosphere with wooden furniture and potted plants, shot on 35mm film,

shallow depth of field, soft bokeh in background, natural skin texture,

no watermarkさらに「昼から夜に変えて」と言えば、照明パラメータとプロンプトを自動で書き換えて再生成してくれます。

これ、手動でやると「照明キーワードを変えて、雰囲気キーワードも変えて、CFGスケール調整して...」と10分くらいかかる作業が、一言で終わるんです。

実例: Z-Image TurboとQwen-Image-Edit-2511での結果比較

Claude Codeが面白いのは、「このプロンプトをZ-Image TurboとQwen-Image-Edit-2511の両方で生成して比較して」という指示もそのまま通るところです。

Claude Codeは以下を自動で処理します。

- Z-Image Turbo用のワークフローJSONを読み込み

- プロンプトを適用して画像生成

- Qwen-Image-Edit-2511用のワークフローJSONに切り替え

- 同じプロンプトを適用して画像生成

- 両方の出力パスを報告

ワークフローの切り替え、モデルの読み込み先の変更、パラメータの調整——全部Claude Codeが勝手にやってくれます。

人間がやることは「どういう画像が欲しいか」を伝えるだけです。

「人間が設計するよりも、AIに設計させたほうが優れた結果を生み出す」——この言葉、大げさに聞こえるかもしれませんが、プロンプト最適化に関しては本当にそうだと実感しています。

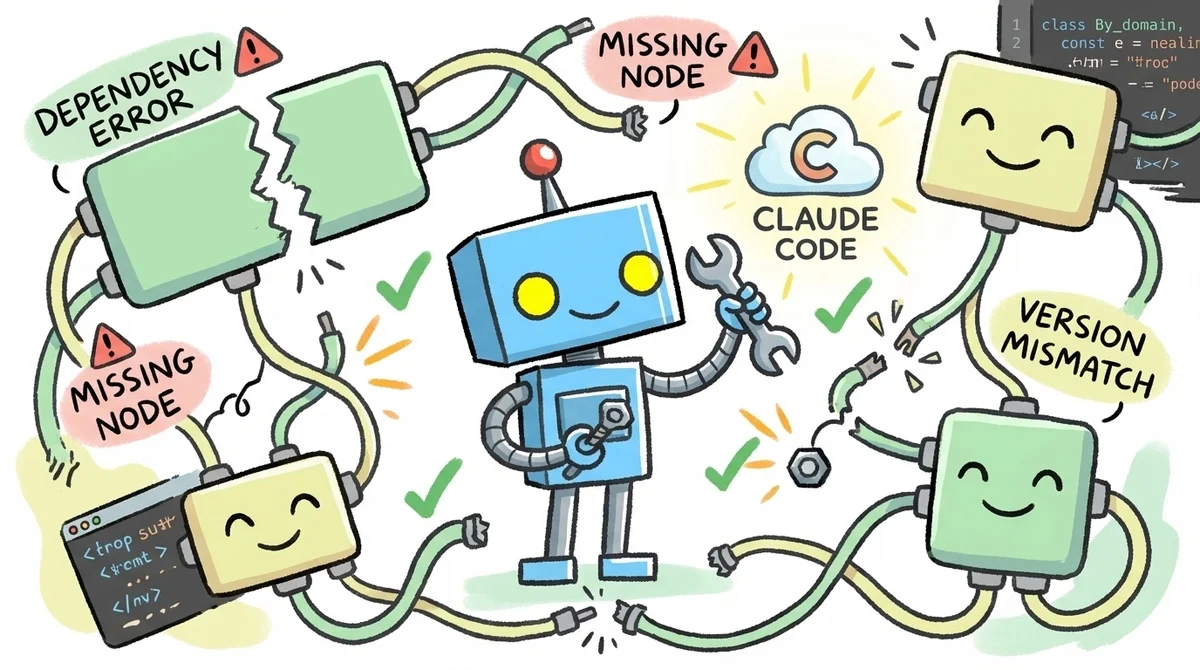

カスタムノードのエラーもClaudeに全部やらせる

ComfyUIユーザーのペインポイントで一番大きいのは、間違いなくカスタムノードの依存関係問題です。

GitHubで見つけたワークフローをインポートしたらmissing nodesエラーが出る——これ、ComfyUIあるあるですよね。

「どのリポジトリからインストールすればいいか分からない、調べてる間に30分溶けた」という経験、自分もありますし、共感してくれる人は多いと思います。

missing nodesエラーの自動検出・インストール

Claude Codeへの指示はこれだけです。

このワークフローを読み込んだらmissing nodesエラーが出ました。

必要なカスタムノードを特定して、インストールして、

ワークフローが動くようにしてください。Claude Codeは以下のステップを自動で実行します。

- ComfyUIのログからエラーメッセージを解析

- 不足しているノード名を特定

- Web検索でそのノードのGitHubリポジトリを特定

ComfyUI/custom_nodes/ディレクトリにgit clone- 必要に応じて

pip install -r requirements.txtを実行 - ComfyUIを再起動

- ワークフローが正常に読み込まれるか確認

手動でやると1つのカスタムノードにつき5〜10分かかる作業です。

5つ足りなかったら30分〜1時間。

Claude Codeなら「全部やっといて」の一言で完了します。

複雑な依存関係をClaude Codeが吸収する実例

もっと厄介なのは、カスタムノード同士の依存関係です。

「ノードAをインストールしたら、ノードBのバージョンと競合した」「ノードCが依存しているPythonパッケージのバージョンが合わない」——この手のトラブル、手動で解決しようとすると本当に時間を溶かします。

Claude Codeはエラーメッセージを逐一読んで、バージョン競合の原因を特定し、互換性のあるバージョンを探して解決策を提示してくれます。

実際に体験した例を紹介すると、あるワークフローでComfyUI-Impact-PackとComfyUI-Inspire-Packの両方が必要で、片方をアップデートしたらもう片方が壊れるという状況がありました。

Claude Codeに任せたら、両方のリポジトリのリリースノートを確認して、互換性のあるバージョンの組み合わせを特定し、両方を適切なバージョンに固定してくれました。

所要時間、約3分。

手動でやっていたら「もういいや、このワークフロー使うのやめよう」と諦めていたと思います。

いわば「詰んだ」と思った瞬間にパズルを解いてくれる頭脳を常駐させているような感覚ですね。

Antigravity(Google)との比較——どちらを選ぶか

Claude Code × ComfyUIの話をすると、必ず聞かれるのが「GoogleのAntigravityはどうなの?」という質問です。

Antigravityは2025年11月にGoogleがGemini 3と同時に公開したエージェント型AI IDEです。

VS Codeをベースにした開発環境で、Claude CodeやCursorと同じカテゴリのツールですね。

AIエージェントがコードの実行やターミナル操作を自律的に行えるので、Claude Codeと同様にComfyUIのAPIをコマンド経由で叩くことも理論上は可能です。

ただし、ComfyUI専用の連携機能があるわけではなく、あくまで汎用的なAI IDE機能の一環としての制御になります。

機能・コスト・セットアップ難易度の比較表

Claude Codeを選ぶべき人:

- ComfyUI制御の実績・事例の豊富さを重視する人

- CLIベースの操作に慣れていて、開発全般でClaude Codeを使っている人

- 既にAnthropicのMaxプランに加入している人

Antigravityを選ぶべき人:

- コストを抑えたい人(パブリックプレビュー中は無料)

- GUIベースの開発環境を好む人

- Geminiエコシステムに馴染みがある人

個人的には、自分はClaude Codeを開発業務全般で使っているので、ComfyUI制御もClaude Codeに統一しています。

1つのツールで全部できるのは、ツールスイッチングのコストがなくなるので楽なんですよ。

ただ、コストを抑えたい場合はAntigravityを試してみるのも合理的な選択です。

ツール選びに正解はないので、自分のワークフローに合う方を選ぶのが一番です。

さて、最後に避けて通れないのがお金の話です。

月$100のAnthropic Maxプランは元が取れるか

「$100/月って高くない?」——これは正直な疑問だと思います。

日本円で月額約15,500円前後(2026年4月時点、1ドル≒155円換算)。

趣味で使うにはためらう金額ですが、仕事で使うなら話は別です。

ProプランとMaxプランの具体的な違い

Proプラン($20/月)でもClaude Codeは使えます。

ただし、ComfyUI制御で実際に使ってみると、以下の違いが体感できます。

Proプラン($20/月)の場合:

- 単発の画像生成指示は問題なく動く

- ワークフロー解析中にレートリミットに引っかかりやすい

- 画像→動画パイプラインのような複雑な連続処理で途中停止しがち

- 1日5〜10回程度の利用なら何とか使える

Max 5xプラン($100/月)の場合:

- ワークフロー解析、パラメータ変更、画像生成を連続実行しても止まらない

- 画像→動画パイプラインを1日10〜20回回しても余裕

- カスタムノードのデバッグ(Web検索→インストール→確認の連続処理)も快適

どのくらい使うと費用対効果が合うか

費用対効果の考え方は人それぞれですが、自分なりの基準を共有します。

ComfyUI制御だけで元を取ろうとする場合:

- 手動でワークフロー管理していた時間が月10時間以上なら、$100の価値は十分ある

- カスタムノードのトラブルシューティングに月5時間以上使っていたなら、それだけで元が取れる

Claude Codeを開発全般で使っている場合:

- ComfyUI制御は「おまけ」のような位置づけ

- 開発業務(コーディング、デバッグ、ドキュメント作成)で既に元が取れている上に、画像・動画生成の自動化までできる

自分の場合は後者です。

Claude Codeの月額$100は開発環境の投資として支払っていて、ComfyUI制御はその延長線上で使っています。

ComfyUI制御のためだけに$100払うかと聞かれたら、正直悩むと思います。

でも「開発全般 + ComfyUI制御」のパッケージとして考えると、十分すぎるリターンがあります。

まとめ——「AIに全部やらせる」時代のクリエイティブワークフロー

ここまで、Claude Code × ComfyUI自動化の仕組みからセットアップ、画像→動画パイプラインの自動引き渡し、カスタムノードのデバッグ自動化まで解説してきました。

Claude Code × ComfyUI自動化の可能性と今後

この記事で紹介した内容をまとめると以下の通りです。

- ComfyUIのJSON形式ワークフローは、Claude Codeが直接読み解いて制御できる

- プロンプト最適化はClaude Codeに調査・生成を任せられる

- 画像→動画パイプラインの自動引き渡しで、複数ワークフローをまたいだ連続処理が可能

- VRAM管理やカスタムノードのトラブルシューティングもClaude Codeが吸収する

- Anthropic Max 5xプラン($100/月)が実用上の推奨ライン

今後は「人間がクリエイティブな意図を指定→AIが実装→人間がレビュー・調整」というワークフローが標準になっていくと感じています。

ComfyUIの複雑さ——カスタムノードの依存関係、ワークフローのバージョン管理、VRAM制約——これらはすべてAIエージェントが吸収していく方向です。

人間は「何を作りたいか」に集中して、「どうやって作るか」はAIに任せる。

Claude Code × ComfyUIの組み合わせは、その未来の一端を今すぐ体験できるツールです。

まずは手元のComfyUI環境にClaude Codeをつないで、「この画像を元に動画を作って」と話しかけてみてください。

コマンド1本つなぐだけで始められます。

きっと「こんなに簡単だったのか」と驚くはずです。

💬 コメント

ログイン か 会員登録 するとコメントできます